Mapa do Modelo Fronteira 2026: GPT-5.5, Claude 4.7, Gemini 3 e o que cada um faz de melhor

Um mapa funcional do cenário de modelos de vanguarda para 2026. GPT-5.5, Claude 4.7 Opus e Sonnet, Gemini 3 Pro, Llama 5, Grok 4, DeepSeek V4 e Qwen 3 avaliados com base em suas vantagens reais, onde perdem dinheiro, preço aproximado por milhão de tokens e uma matriz de decisão para designers e desenvolvedores que escolhem modelos para conjuntos de produtos reais.

Não existe um modelo dominante em 2026. A classificação se fragmentou em especialistas. O GPT-5.5 vence em tarefas gerais. O Claude 4.7 Opus vence em raciocínio e confiabilidade do agente. O Sonnet vence em prosa e no equilíbrio ideal entre velocidade e custo. O Gemini 3 Pro vence em contexto longo. O Llama 5 vence em modelos de uso geral. O Grok 4 domina um nicho em tempo real. O DeepSeek quebrou o preço mínimo. O Qwen 3 domina em multilinguismo.

Este é um mapa funcional dos oito modelos relevantes, preços aproximados por milhão de tokens, os quatro casos de uso e o que vence em cada um deles, e as quatro armadilhas em que as equipes caem ao escolherem com base na classificação.

A fronteira se dividiu em especialistas em 2026

O cenário de 2024 era um modelo que se tornava mais inteligente a cada seis meses. O cenário de 2026 é um conjunto de especialistas, e as equipes de produto que estão vencendo agora executam dois ou três modelos por trás de uma camada de roteamento.

Escolher um único modelo para tudo é o erro mais comum em 2026. O custo aumenta nas cargas de trabalho erradas e a qualidade cai nas cargas de trabalho em que o modelo escolhido é fraco. A fronteira é um problema de roteamento, não de seleção.

GPT-5.5, o modelo de trabalho geral

O GPT-5.5 é o carro-chefe da OpenAI e a escolha padrão para o trabalho geral de produto, o modelo mais robusto quando você precisa de uma API que faça quase tudo com competência. Código robusto, uso robusto de ferramentas, visão sólida, baixa latência e o ecossistema mais maduro de qualquer modelo de fronteira.

Onde ele deixa dinheiro. Raciocínio de formato longo: Claude 4,7 Opus. Recuperação de contexto longo: Gemini 3 Pro. Voz da marca e estilo de prosa ficam abaixo do Sonnet. Preço: cerca de 5 dólares por milhão de entradas e 15 dólares por milhão de saídas. O modelo intermediário do mercado fechado.

Claude 4.7 Opus, o ápice em raciocínio e confiabilidade de agentes

Claude 4.7 Opus é o modelo de ponta do Anthropic e a melhor superfície de raciocínio e confiabilidade de agentes disponível em 2026. O modelo ideal quando a tarefa precisa ser concluída com sucesso na primeira tentativa. O seguimento de instruções é o mais preciso do mercado. A conformidade com o formato é extremamente sólida. A estabilidade no uso da ferramenta em longas execuções de agentes é o motivo pelo qual o Claude Code, o modo de agente Cursor e a maioria das estruturas de agentes mais robustas o utilizam por padrão.

Onde isso custa caro. O mais lento dos principais modelos fechados e o mais caro. Preço: cerca de 15 dólares por milhão de entradas e 75 dólares por milhão de saídas. A escolha certa para as chamadas mais críticas. A escolha errada para trabalhos de alto volume.

⟦MARCA8⟧ 4.7 Sonnet, o ponto ideal entre velocidade e custo

⟦MARCA9⟧ 4.7 Sonnet é o modelo que a maioria das equipes de produção deve adotar por padrão em 2026. Ele oferece cerca de 90% da qualidade do Opus a uma fração do custo e com o dobro da velocidade. Melhor qualidade de prosa do mercado. Melhor retenção da voz da marca. Menor desvio em conversas longas. O modelo escolhido pelos designers quando o resultado será lido por um humano.

Onde isso impacta o custo. Ligeiramente inferior ao Opus em raciocínios mais complexos e em execuções de agentes mais longas. Preço: cerca de 3 dólares de entrada e 15 dólares de saída por milhão. A melhor relação custo-benefício de qualquer modelo fechado.

Claude 4.7 Haiku, o modelo de alto desempenho

Claude 4.7 Haiku é o modelo rápido e econômico da pilha Anthropic, a escolha certa quando o volume é alto e a exigência de qualidade por chamada é moderada. Classificação, extração, marcação estruturada, decisões de roteamento rápidas e chat leve. Forte capacidade de seguir instruções no nível mais econômico.

Onde isso impacta negativamente. Não é indicado para raciocínio complexo, escrita de textos longos ou execução de agentes complexos. Preço: cerca de US$ 1 de entrada e US$ 5 de saída por milhão.

Gemini 3 Pro, o campeão em contexto longo e multimodalidade

Gemini 3 Pro é o modelo principal do Google e o mais robusto em 2026 para recuperação de contexto longo, ancoragem de documentos e multimodalidade nativa. A janela de contexto efetiva de dois milhões de tokens, com sua alta confiabilidade de busca por uma agulha em um palheiro, é incomparável. O processamento nativo de entrada de vídeo, áudio e imagem é o mais limpo do mercado fechado.

Onde isso impacta financeiramente: a voz escrita é o ponto fraco entre os modelos principais. A prosa é competente, mas monótona. O trabalho com a voz da marca exige bastante estímulo para ultrapassar o registro padrão. Preço: cerca de US$ 2,50 por entrada e US$ 10 por saída por milhão. Excelente relação custo-benefício para a vantagem do contexto longo.

Llama 5, o modelo padrão de código aberto

Llama 5 é a principal família de modelos de código aberto da Meta e o melhor modelo que você pode hospedar por conta própria em 2026. A escolha certa quando residência de dados, controle de custos ou ajustes finos são mais importantes do que qualidade absoluta. A variante com 405 bilhões de parâmetros fica muito próxima do GPT-5.5 na maioria dos benchmarks gerais.

Onde isso impacta financeiramente: o custo de infraestrutura para hospedar a variante grande por conta própria é considerável. O Llama 5 hospedado pelo provedor se enquadra na mesma faixa de preço do Sonnet, sem a vantagem da prosa. Preço: aproximadamente de 1 a 2 dólares por milhão, considerando provedores de hospedagem.

Grok 4, a escolha de nicho em tempo real

O Grok 4 é o carro-chefe da xAI, com acesso nativo em tempo real ao fluxo de dados X e uma voz padrão irreverente. Útil para cargas de trabalho específicas. Monitoramento de notícias, rastreamento de sentimentos, análise de eventos em tempo real e qualquer produto em que a IA precise dos últimos sessenta segundos de discurso público, e não dos dados de treinamento de ontem.

Onde deixa a desejar. O raciocínio fica atrás do Opus. O código fica atrás do GPT-5.5. A voz pode ser um problema em qualquer produto em que a personalidade deva vir da marca. Preço: cerca de 5 dólares de entrada e 15 dólares de saída por milhão. Na mesma faixa de preço do GPT-5.5, com uma aplicação muito mais específica.

DeepSeek V4 e R2, os destruidores de custos

DeepSeek V4 e R2 são o par de modelos de raciocínio de código aberto que rompeu o preço mínimo em 2026. O V4 é o modelo geral. O R2 é o especialista em raciocínio. Qualidade de raciocínio de alto nível a aproximadamente um décimo do custo de um modelo fechado. Hospedado pelo DeepSeek ou auto-hospedado a partir dos modelos de código aberto.

Onde isso impacta o custo. Estabilidade de uso da ferramenta ligeiramente inferior à do Claude 4.7. A recuperação de contextos longos fica atrás do Gemini 3. O desempenho em prosa é inferior ao do Sonnet. Preço: cerca de US$ 0,30 de entrada e US$ 1 de saída por milhão. As equipes de produção agora roteiam o raciocínio de alto volume pelo DeepSeek e reservam o Opus para as chamadas que precisam ser perfeitas.

Qwen 3, o padrão multilíngue aberto

O Qwen 3 é a família open-weight da Alibaba e o modelo open mais robusto para cargas de trabalho multilíngues. A escolha certa quando o produto é lançado em mais idiomas além de inglês e mandarim. Forte em idiomas asiáticos, árabe e na longa lista de idiomas regionais onde o Llama 5 começa a apresentar dificuldades.

Onde deixa a desejar. Os benchmarks somente em inglês ficam ligeiramente atrás do Llama 5. A experiência com provedores de hospedagem é menos consolidada fora da Alibaba Cloud. Preços semelhantes aos do Llama 5 em provedores compartilhados, muito baratos em hospedagem própria.

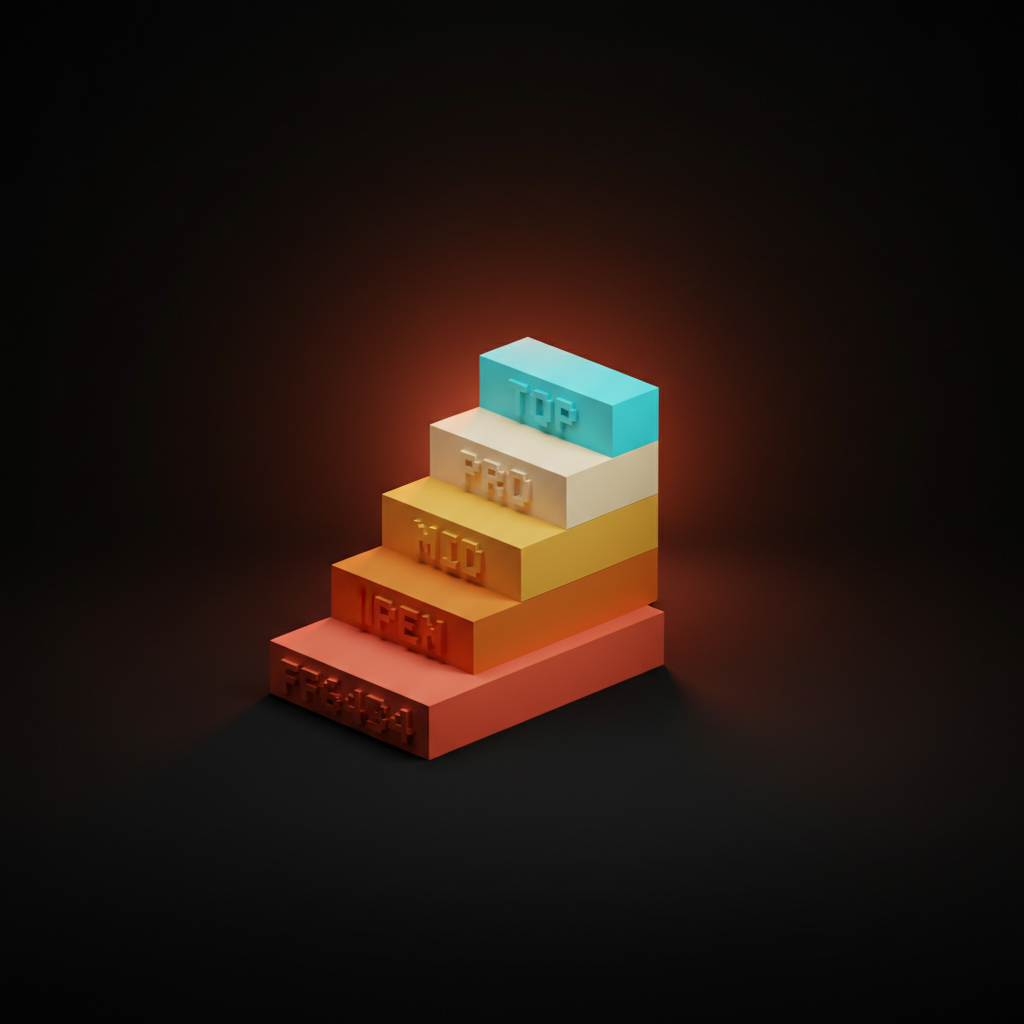

Preços em 2026: o custo real de cada milhão de tokens

Os preços foram estratificados em quatro níveis. Os modelos com baixo custo por token nem sempre são os modelos com baixo custo por tarefa quando se considera a profundidade de raciocínio e as taxas de retrabalho.

| Modelo | Entrada ($/1M) | Saída ($/1M) | Nível |

|---|---|---|---| | Claude 4.7 Opus | 15 | 75 | Top | | GPT-5.5 | 5 | 15 | Pro | | Grok 4 | 5 | 15 | Pro | | Claude 4.7 Sonnet | 3 | 15 | Pro |

| Gemini 3 Pro | 2.50 | 10 | Mid | | Llama 5 (hospedado) | 1 a 2 | 1 a 2 | Mid | | Qwen 3 (hospedado) | 1 a 2 | 1 a 2 | Mid | | Claude 4.7 Haiku | 1 | 5 | Mid | | DeepSeek V4 | 0.30 | 1 | Open | DeepSeek R2 | 0.30 | 1 | Aberto |

O custo por tarefa é o que importa. Um modelo barato que precisa de três tentativas em uma tarefa complexa é mais caro do que uma chamada Opus que funciona apenas uma vez. Faça os cálculos com tráfego real antes de bloquear a camada de roteamento.

Os quatro casos de uso do lado do design

Síntese de pesquisa, controle de qualidade de textos, pipelines de geração de imagens e prompt como componente são as quatro cargas de trabalho que decidem qual modelo ganha sua chave de API. Cada uma tem um vencedor diferente.

Síntese de pesquisa, onde o Gemini 3 Pro vence

A síntese de pesquisa é a carga de trabalho de contexto longo, que consiste em inserir dez relatórios em um prompt e obter um resumo claro e conciso. O Gemini 3 Pro vence em confiabilidade de recuperação, qualidade de citação e janela efetiva além de um milhão de tokens. O Sonnet fica em segundo lugar em horizontes mais curtos. Os cálculos favorecem o Gemini quando as entradas ultrapassam duzentos mil tokens. Para fluxos de trabalho em que a eficiência da janela é mais importante do que o tamanho bruto, consulte eficiência de contexto.

Controle de qualidade de textos, onde o Claude 4.7 Sonnet vence

O controle de qualidade de textos consiste na revisão da voz da marca, na análise crítica de microtextos e na consistência do tom em grande escala. O Sonnet tem o melhor bom gosto, a prosa mais clara e a menor variação em sessões longas. Combine-o com uma rubrica estruturada e um pacote de voz da marca ⟦MARCA0⟧ Habilidades e o pipeline de avaliação funciona sem supervisão.

Pipelines de geração de imagens, onde o roteamento é crucial

Os pipelines de geração de imagens não são vencidos por um único modelo, mas sim pelo roteamento. O modelo vencedor em modelagem de prompts em 2026 é o GPT-5.5 combinado com um modelo de imagem dedicado no back-end. O Sonnet é uma forte segunda opção quando a voz da marca precisa estar presente no prompt. O próprio modelo de imagem é uma decisão separada e muda mais rapidamente do que a camada de linguagem.

Prompt como componente, onde Claude 4.7 Opus vence

Prompt como componente é a carga de trabalho onde um prompt se torna uma primitiva de produção reutilizável, com estrita conformidade de formato, saída estruturada e uso de ferramentas em longas execuções do agente. Opus vence em seguimento de instruções, conformidade de formato e estabilidade de uso de ferramentas. Para trabalho com IDEs de agentes, consulte o comparação de editores de código de IA. Para padrões de interface do usuário do agente, o modelo subjacente é quase sempre Opus nas chamadas que precisam ser executadas.

A matriz de decisão de quatro casos de uso

| Caso de uso | Escolha | Por quê |

|---|---|---|

| Síntese da pesquisa | Gemini 3 Prós | Contexto extenso, qualidade de citação, fundamentação confiável além de 200 mil tokens. | | Controle de Qualidade de Texto | ⟦MARCA18⟧ 4.7 Sonnet | Melhor estilo de prosa, menor desvio, maior retenção da voz da marca. | | Pipelines de geração de imagens | GPT-5.5 (prompt) + modelo de imagem dedicado | Melhor formatação de prompt com a mais ampla integração de provedores. | | Prompt como componente | ⟦MARCA19⟧ 4.7 Opus | Melhor seguimento de instruções, conformidade de formato, estabilidade de uso da ferramenta. |

As combinações importam. Poucas equipes de produção usarão um único modelo em 2026. A maioria optará por dois ou três, com uma camada de roteamento que seleciona o modelo por chamada.

Precisa de ajuda para escolher o modelo ideal para o seu produto e configurar o roteamento para que o custo e a qualidade sejam equilibrados? Contrate ⟦MARCA0⟧. A ClaudeBrainy oferece pacotes de habilidades e bibliotecas de prompts que otimizam a camada de modelo. A AppBrainy entrega versões completas de produtos para equipes que desejam que sua IA realmente entregue funcionalidades, e não apenas demonstrações.

Onde cada modelo se encaixa em stacks de produtos reais

O ranking é uma coisa, a stack é outra. Os oito modelos se estabeleceram em categorias reconhecíveis.

O GPT-5.5 está na linha de frente do chat com o consumidor e é a categoria padrão em qualquer nova versão que utilize uma única API. O Opus está por trás das chamadas de agentes de maior impacto e das primitivas de prompt como componente. O Sonnet está em superfícies de marca e escrita de longa duração. O Haiku está em tarefas de alto volume em segundo plano. O Gemini 3 Pro está em categorias com grande volume de documentos e multimodais. O Llama 5 está em stacks regulamentadas, com restrições de residência de dados e controle de custos. O Grok 4 está em nichos de notícias em tempo real. O DeepSeek está na categoria de raciocínio de alto volume, onde o custo teria inviabilizado o projeto. O Qwen 3 está presente em stacks multilíngues e na região Ásia-Pacífico.

Quatro armadilhas quando as equipes escolhem com base em benchmarks

Primeira. A armadilha do ranking. Uma equipe escolhe o modelo que lidera um benchmark em março e, em julho, ele já não é a escolha certa. Solução: escolha com base na adequação ao caso de uso e reavalie a camada de roteamento a cada trimestre.

Segunda. A armadilha do modelo único. Uma equipe fixa um modelo em toda a stack e se depara com um obstáculo na carga de trabalho que ele não consegue atender. Solução: rotear por tarefa, não por contrato.

Terceira. A armadilha do token barato. Uma equipe otimiza para preço de entrada e paga com novas tentativas, retrabalho e queda na qualidade. Solução: modele o custo por tarefa antes da implementação.

Quarta. A armadilha da incompatibilidade de tom de voz. Uma equipe usa um modelo de tom de voz neutro para textos voltados para a marca e o trabalho fica sem vida. Solução: rotear o texto da marca pelo Sonnet e o restante pelo que for mais econômico.

Perguntas Frequentes

Qual é o melhor modelo de IA em 2026?

Não existe um único melhor. O GPT-5.5 se destaca em tarefas gerais, o Claude 4.7 Opus se destaca em raciocínio e agentes, o Sonnet se destaca em prosa e voz da marca, o Gemini 3 Pro se destaca em contexto longo, o Llama 5 se destaca em pesos abertos e o DeepSeek se destaca em custo. Escolha o modelo mais adequado ao seu caso de uso.

O Claude 4.7 é melhor que o GPT-5.5?

Existem diferentes nuances de "melhor". O GPT-5.5 é a melhor opção padrão para tarefas gerais de produto e para o ecossistema mais amplo. O Opus se destaca em raciocínio, confiabilidade de agentes e seguimento de instruções. O Sonnet se destaca em prosa. A maioria das arquiteturas de produção atualmente utiliza ambos os modelos por trás de um roteador.

Qual é o modelo de vanguarda mais barato em 2026?

DeepSeek V4 e R2. Cerca de US$ 0,30 de entrada e US$ 1 de saída por milhão. Aproximadamente um décimo do custo dos modelos proprietários de ponta com a melhor qualidade de raciocínio.

Qual modelo tem a janela de contexto mais longa?

Gemini 3 Pro. A janela efetiva de dois milhões de tokens com alta confiabilidade de recuperação é líder de mercado.

Qual é o melhor modelo open-weight em 2026?

Llama 5 para trabalho geral com foco em inglês. Qwen 3 para multilíngue. DeepSeek V4 e R2 para raciocínio em escala.

A mudança que o mapa de fronteira realmente desbloqueia

A fronteira em 2026 não é um único modelo ficando mais inteligente. É um conjunto de especialistas que permite que uma pequena equipe execute o trabalho de uma equipe muito maior quando roteiam por tarefa. As equipes vencedoras não são aquelas com o melhor contrato de modelo, mas sim aquelas com a melhor lógica de roteamento.

Não existe um modelo perfeito em 2026, apenas o melhor para esta tarefa, e as equipes vencedoras são aquelas que priorizam o roteamento por caso de uso em vez de seguir uma classificação por desempenho.

Se sua equipe está comparando modelos e a discussão trava em qual deles supera o último benchmark, o problema está na própria discussão. Mapeie as cargas de trabalho, escolha o modelo que se destaca em cada uma, execute um teste de duas semanas com tráfego real e deixe que a relação custo-benefício determine o resultado final.

Se você precisa de ajuda para escolher o modelo ideal e configurar a camada de roteamento, acesse contratar ⟦MARCA0⟧. A ClaudeBrainy oferece pacotes de habilidades e bibliotecas de prompts que facilitam a configuração da camada de modelo. A AppBrainy oferece versões completas do produto para equipes que desejam que sua IA entregue funcionalidades, e não apenas demonstrações.

Want help picking the right frontier model for your product and routing the stack so the cost and quality math both work? Brainy ships ClaudeBrainy as a Skill pack and prompt library that gets the model layer right, and AppBrainy ships full product builds for teams that want their AI to actually ship features, not demos.

Get Started