2026年のフロンティアモデルマップ:GPT-5.5、Claude 4.7、Gemini 3、そしてそれぞれの得意分野

2026年のフロンティアモデルランドスケープの作業マップ。GPT-5.5、Claude 4.7 OpusとSonnet、Gemini 3 Pro、Llama 5、Grok 4、DeepSeek V4、およびQwen 3を、実際に勝てる分野、利益が出ない分野、100万トークンあたりの概算価格、および実際の製品スタック用のモデルを選択するデザイナーとビルダーのための意思決定マトリックスに基づいて評価します。

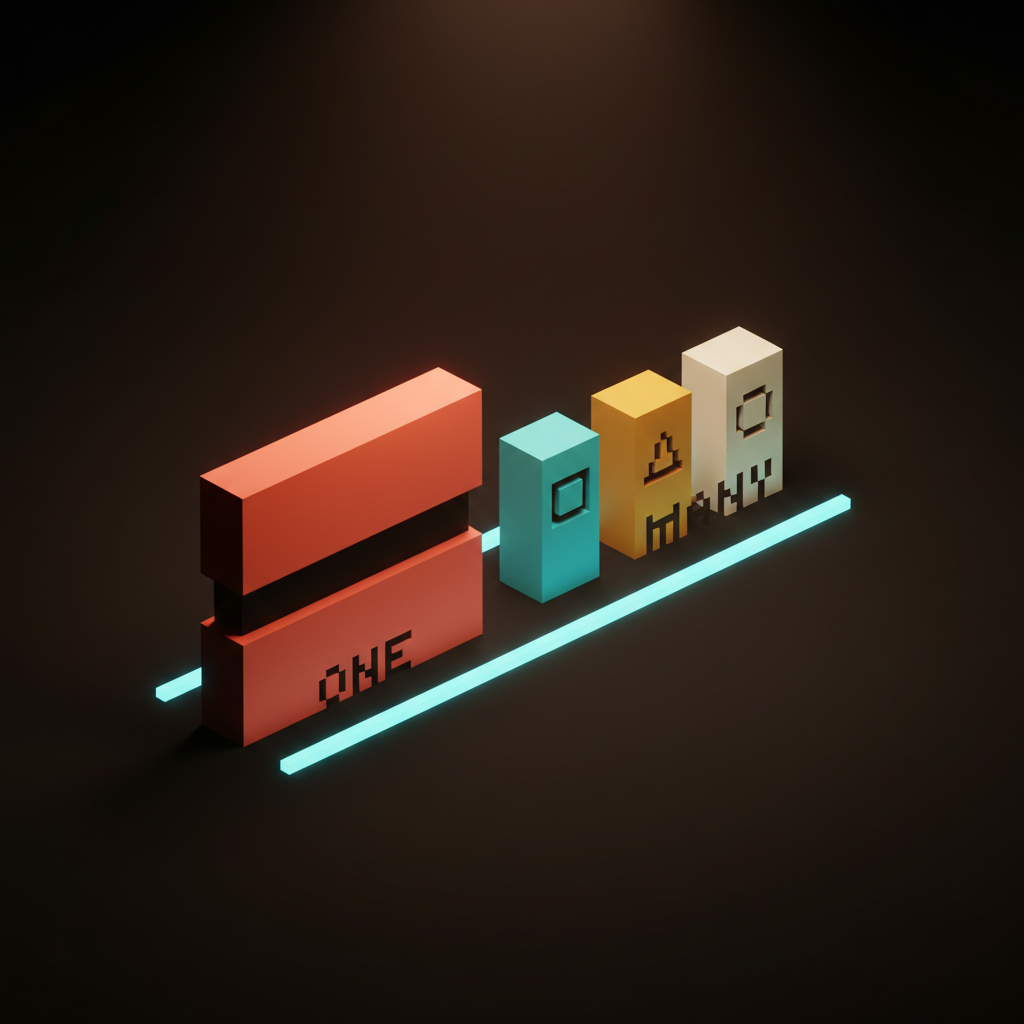

2026年には、最先端モデルは存在しません。リーダーボードはスペシャリストに分裂しました。GPT-5.5は汎用的な処理で勝利を収めました。Claude 4.7 Opusは推論とエージェントの信頼性で勝利しました。Sonnetは散文と速度とコストの最適なバランスで勝利しました。Gemini 3 Proは長文コンテキストで勝利しました。Llama 5はオープンウェイトで勝利しました。Grok 4はリアルタイムのニッチ市場を独占しました。DeepSeekは価格の下限を突破しました。Qwen 3は多言語処理で優位に立ちました。

これは、重要な8つのモデル、100万トークンあたりの概算価格、4つのユースケースとそのそれぞれの勝者、そしてリーダーボードに基づいてモデルを選択する際にチームが陥る4つの落とし穴を示す作業マップです。

2026年、最先端はスペシャリストに分裂しました

2024年の枠組みは、6ヶ月ごとに1つのモデルが賢くなるというものでした。 2026フレームワークはスペシャリストのスタックであり、現在成功を収めているプロダクトチームはルーティングレイヤーの背後で2つか3つのモデルを運用しています。

あらゆる用途に1つのモデルを選択することは、2026フレームワークにおける最もよくある間違いです。間違ったワークロードではコストが急上昇し、選択したモデルが弱いワークロードでは品質が低下します。最先端技術は選択の問題ではなく、ルーティングの問題なのです。

GPT-5.5、汎用ワークホース

GPT-5.5はOpenAIのフラッグシップであり、汎用プロダクト開発におけるデフォルトの選択肢です。ほぼすべてのことを高いレベルでこなせる単一のAPIが必要な場合、最も強力なオールラウンドモデルとなります。強力なコード、強力なツール活用、強力なビジョン、高速なレイテンシー、そしてあらゆる最先端モデルの中で最も成熟したエコシステムを備えています。

しかし、GPT-5.5は収益を生みません。長文推論の軌跡 Claude 4.7 Opus。長文コンテキスト検索トレイル Gemini 3 Pro。ブランドボイスと文章表現はSonnetよりやや劣ります。価格:入力100万件あたり約5ドル、出力100万件あたり約15ドル。クローズド市場の中位モデルです。

Claude 4.7 Opus、推論とエージェントの限界

Claude 4.7 OpusはAnthropicの最上位モデルであり、2026年に出荷される推論とエージェント信頼性において最高峰のモデルです。タスクを初回で確実に完了させる必要がある場合に選択すべきモデルです。指示追従性能は業界最高レベルです。フォーマット準拠性は極めて高いです。長時間のエージェント実行におけるツール使用の安定性から、Claude Code、カーソルエージェントモード、そしてほとんどの本格的なエージェントフレームワークがデフォルトで採用しています。

コスト面での課題:クローズド市場のフラッグシップモデルの中で最も処理速度が遅く、最も高価です。価格:入力約15ドル、出力約75ドル/100万件。最も重要な通話に最適な選択肢。大量の通話には不向き。

Claude 4.7 Sonnet:スピードとコストの最適なバランス

Claude 4.7 Sonnetは、2026年にはほとんどの制作チームが標準として採用すべきモデルです。Opusの約90%の品質を、はるかに低いコストで、2倍のスピードで実現します。業界最高レベルの文章品質。最高のブランドボイス保持率。長時間の会話でも、声のずれが最小限に抑えられます。出力が人間によって読まれる場合に、デザイナーが真っ先に選ぶモデルです。

コスト面での課題:最も高度な推論や長時間のエージェント処理では、Opusよりも若干劣ります。価格:入力約3ドル、出力約15ドル/100万件。あらゆるクローズドモデルの中で、最高のコストパフォーマンスを誇ります。

Claude 4.7 Haiku、高スループットの主力モデル

Claude 4.7 Haikuは、Anthropicスタックの中で低価格かつ高速なモデルであり、処理量が多く、通話ごとの品質基準が中程度の場合に最適な選択肢です。分類、抽出、構造化タグ付け、高速ルーティング決定、軽量チャットに対応しています。低価格帯ながら、強力な指示追従機能を備えています。

ただし、コストパフォーマンスの面では、微妙な推論、長文の記述、高度なエージェント処理には適していません。価格:入力1ドル、出力100万件あたり約5ドル。

Gemini 3 Pro、長文コンテキストとマルチモーダルの王者

Gemini 3 Proは、Googleのフラッグシップモデルであり、長文コンテキスト検索、ドキュメントグラウンディング、ネイティブマルチモーダルにおいて、2026年時点で最も強力なモデルです。 200万トークンの有効コンテキストウィンドウと、膨大な情報の中から必要な情報を見つけ出す高い信頼性は他に類を見ません。ネイティブのビデオ、オーディオ、画像入力処理は、クローズドフィールドの中で最も洗練されています。

コスト面での課題:ライティング音声は、フラッグシップモデルの中で最も弱い部分です。文章は適切に読めますが、平板です。ブランドボイスの作成では、デフォルトの文体から抜け出すために、かなりの指示が必要です。価格:入力は約2.50ドル、出力は100万トークンあたり10ドルです。長いコンテキストでの優位性を考えると、コストパフォーマンスは非常に優れています。

Llama 5、オープンウェイトのデフォルトモデル

Llama 5は、Metaのフラッグシップオープンウェイトファミリーであり、2026年にセルフホストできる最高のモデルです。絶対的な品質よりも、データの所在、コスト管理、または微調整が重要な場合に最適な選択肢です。4050億パラメータのバリアントは、ほとんどの一般的なベンチマークでGPT-5.5に匹敵する性能を発揮します。

コスト面での課題:大規模バリアントをセルフホストするためのインフラコストは無視できません。プロバイダーホスティング型のLlama 5は、Sonnetと同価格帯ですが、文章表現の優位性はありません。価格は、ホスティングプロバイダーで100万件あたり約1~2ドルです。

Grok 4:リアルタイムニッチ向けソリューション

Grok 4は、xAIのフラッグシップ製品で、X Firehoseへのネイティブなリアルタイムアクセスと、型破りなデフォルト音声を備えています。特定のワークロードに適しています。ニュースモニタリング、センチメントトラッキング、リアルタイムイベント分析、そしてAIが昨日のトレーニングデータではなく、直近60秒間の世論を必要とするあらゆる製品に最適です。

Grok 4の弱点。推論能力はOpusに劣ります。コードレベルはGPT-5.5に劣ります。ブランドイメージが重要な製品では、音声が問題となる可能性があります。価格は、入力100万件あたり約5ドル、出力15ドルです。GPT-5.5と同価格帯ですが、用途ははるかに限定的です。

DeepSeek V4とR2:コスト破壊の切り札

DeepSeek V4とR2は、2026年に価格の底値を突破したオープンウェイト推論ペアです。V4は汎用モデル、R2は推論専門モデルです。クローズドモデルの約10分の1のコストで、最高レベルの推論品質を実現します。DeepSeekによるホスティング、またはオープンウェイトからのセルフホスティングが可能です。

コスト削減のポイント:ツール利用の安定性はClaude 4.7よりやや劣ります。長文コンテキスト検索の遅延はGemini 3です。文章表現はSonnetより劣ります。価格:入力は約0.30ドル、出力は約100万件あたり1ドルです。現在、プロダクションチームは大量の推論処理をDeepSeek経由で行い、Opusは完璧な処理が求められる呼び出しにのみ使用しています。

Qwen 3:オープンな多言語対応のデフォルトモデル

Qwen 3は、Alibabaのオープンウェイトファミリーであり、多言語ワークロードにおいて最も強力なオープンモデルです。英語と中国語以外の言語で製品が提供される場合に最適な選択肢となります。アジア言語、アラビア語、そしてLlama 5がやや苦戦する地域言語のロングテールにおいて優れた性能を発揮します。

しかし、Qwen 3には課題もあります。英語のみのベンチマークでは、Llama 5にわずかに劣ります。Alibaba Cloud以外でのホスティングプロバイダーの展開はまだ成熟していません。共有プロバイダーではLlama 5と同程度の価格設定ですが、セルフホスティングでは非常に安価です。

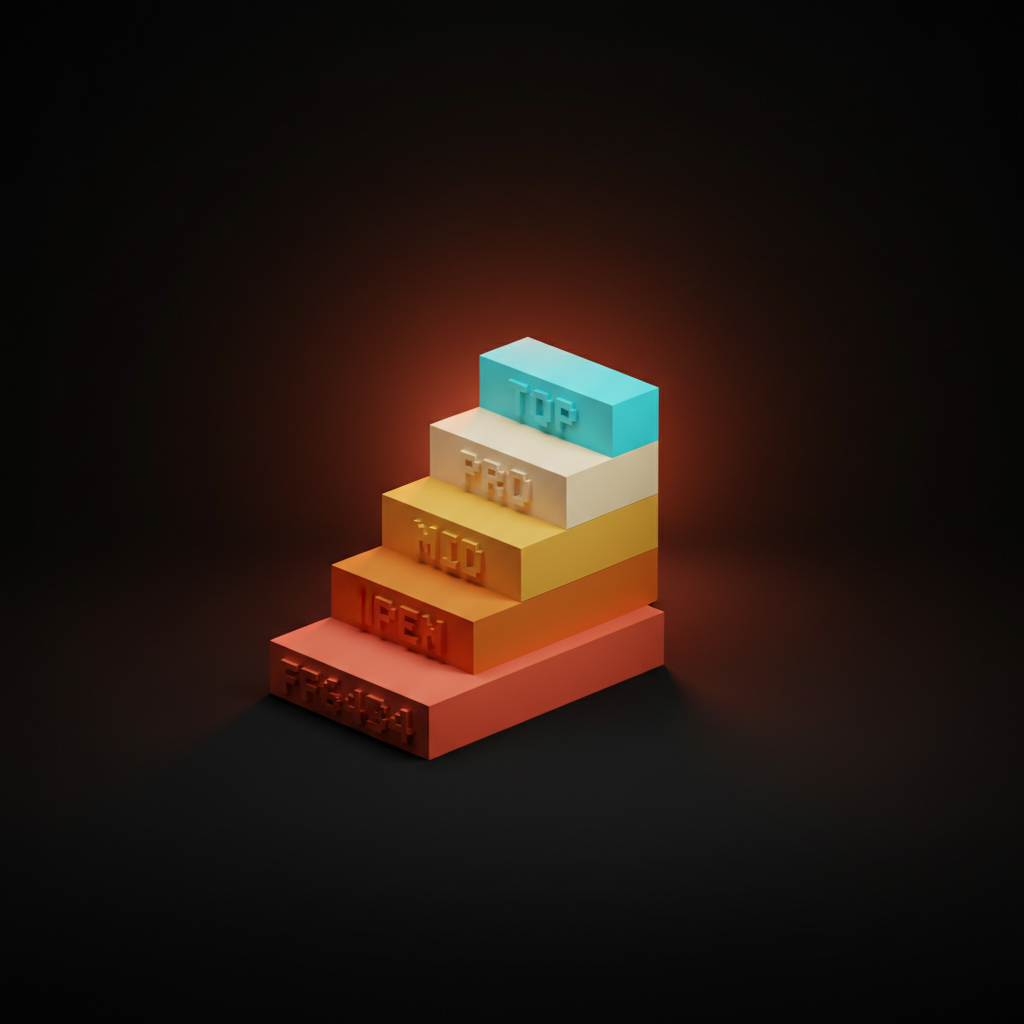

2026年の価格設定:100万トークンあたりの実際のコスト

価格設定は4つのティアに分かれています。推論の深度や再処理率が考慮されると、トークンあたりのコストが低いモデルが必ずしもジョブあたりのコストが低いモデルになるとは限りません。

| モデル | 入力 ($/100万) | 出力 ($/100万) | ティア |

|---|---|---|---|

| Claude 4.7 Opus | 15 | 75 | トップ |

| GPT-5.5 | 5 | 15 | プロ |

| Grok 4 | 5 | 15 | プロ |

| Claude 4.7 Sonnet | 3 | 15 | プロ |

| Gemini 3 Pro | 2.50 | 10 | ミッド |

| Llama 5 (ホスト型) | 1~2 | 1~2 | ミッド |

| Qwen 3 (ホスト型) | 1~2 | 1~2 | ミッド |

| Claude 4.7 Haiku | 1 | 5 | ミッド |

| DeepSeek V4 | 0.30 | 1 | オープン | | DeepSeek R2 | 0.30 | 1 | オープン |

重要なのはジョブごとのコストです。難しいタスクで3回リトライが必要な安価なモデルは、1回で完了するOpus呼び出しよりもコストが高くなります。ルーティングレイヤーをロックする前に、実際のトラフィックで計算を実行してください。

設計側の4つのユースケース

リサーチ合成、コピー品質保証、画像生成パイプライン、プロンプト・アズ・コンポーネントの4つのワークロードが、どのモデルがAPIキーを獲得するかを決定します。それぞれに異なる勝者がいます。

リサーチ合成:Gemini 3 Proが勝利

リサーチ合成は、10件のレポートをプロンプトに入力して、明確で根拠のある要約を取得する、長文コンテキストのワークロードです。Gemini 3 Proは、検索の信頼性、引用の質、100万トークンを超える有効ウィンドウにおいて優れています。Sonnetは、より短い期間では強力な2位となります。入力トークン数が20万トークンを超えると、数学的にはGeminiが有利になります。ウィンドウ効率がデータサイズよりも重要なワークフローについては、コンテキスト効率を参照してください。

コピー品質保証(Claude 4.7 Sonnetが勝利)

コピー品質保証とは、ブランドボイスのレビュー、マイクロコピーの批評、そして大規模なトーンの一貫性を確保することです。Sonnetは、最も優れたセンス、最も洗練された文章、そして長時間のセッションでも最も低いドリフトを実現します。構造化されたルーブリックとブランドボイスClaude スキルパックと組み合わせることで、評価パイプラインは無人で実行されます。

画像生成パイプライン(ルーティングが重要)

画像生成パイプラインは、単一のモデルではなく、ルーティングによって勝敗が決まります。2026年のプロンプト生成における勝者は、バックエンドに専用の画像モデルを組み合わせたGPT-5.5です。ブランドボイスをプロンプトに反映させる必要がある場合、Sonnetは有力な次点となります。画像モデル自体は独立した決定事項であり、言語レイヤーよりも頻繁に変更されます。

プロンプトをコンポーネントとして扱う場合、Claude 4.7 Opusが優位に立つ

プロンプトをコンポーネントとして扱うワークロードでは、プロンプトが再利用可能なプロダクションプリミティブとなり、厳密なフォーマット準拠、構造化された出力、そして長時間のエージェント実行におけるツール利用が求められます。Opusは、命令追従性、フォーマット準拠性、ツール利用の安定性において優れています。エージェントIDEの作業については、AIコードエディタの比較を参照してください。エージェントUIパターンの場合、内部的に実行される呼び出しでは、ほぼ常にOpusがモデルとして使用されます。

4つのユースケースの決定マトリックス

| ユースケース | 選択 | 理由 |

|---|---|---|

| 調査結果のまとめ | Gemini 3 Pro |長いコンテキスト、引用の質、20万トークンを超える信頼性の高い基盤。|

| コピーQA | Claude 4.7 Sonnet | 最高の文章センス、最も低いドリフト、最も強力なブランドボイス保持。|

| 画像生成パイプライン | GPT-5.5(プロンプト)+専用画像モデル | 最も幅広いプロバイダー統合による最高のプロンプトシェーピング。|

| コンポーネントとしてのプロンプト | Claude 4.7 Opus | 最高の指示追従性、フォーマット準拠性、ツール使用の安定性。|

組み合わせは重要です。2026年には、単一のモデルで運用しているプロダクションチームはほとんどありません。ほとんどのチームは、呼び出しごとに選択するルーティングレイヤーの背後に2つか3つのモデルを配置しています。

製品に最適な最先端モデルを選択し、コストと品質の両方が成り立つルーティングを構築するお手伝いが必要ですか?Brainy を雇用する。ClaudeBrainyは、モデルレイヤーを適切に構築するためのスキルパックとプロンプトライブラリを提供しています。 AppBrainyは、デモではなく実際に機能を搭載したAIをリリースしたいチーム向けに、完全な製品ビルドを提供しています。

各モデルが実際の製品スタックでどのように活用されているか

ランキングとスタックは別物です。8つのモデルはそれぞれ明確な役割を担っています。

GPT-5.5は、コンシューマー向けチャットの最前線、そして単一のAPIを必要とする新規ビルドのデフォルトレーンに配置されています。Opusは、最も重要なエージェント呼び出しと、プロンプトをコンポーネントとして利用するプリミティブの背後に配置されています。Sonnetは、長期間稼働するブランドやライティング環境で使用されています。Haikuは、大量のバックグラウンドジョブで使用されています。Gemini 3 Proは、ドキュメント処理量の多いマルチモーダルなレーンで使用されています。Llama 5は、規制が厳しく、データ所在地が制約され、コスト管理が重要なスタックで使用されています。Grok 4は、リアルタイムニュースのニッチな分野で使用されています。DeepSeekは、コストがプロジェクトを頓挫させるような、大量の推論処理レーンで使用されています。 Qwen 3は、多言語対応スタックとアジア太平洋スタックに統合されています。

ベンチマークに基づいて選択する際の4つの落とし穴

-

リーダーボードの落とし穴。チームが3月にベンチマークでトップのモデルを選んだとしても、7月にはもはや最適な選択ではなくなっている可能性があります。解決策:ユースケースへの適合性に基づいて選択し、ルーティングレイヤーを四半期ごとに再評価する。

-

単一モデルの落とし穴。チームがスタック全体に1つのモデルを固定してしまうと、そのモデルでは対応できないワークロードで壁にぶつかる。解決策:契約ではなく、ジョブ単位でルーティングする。

-

安価なトークンの落とし穴。チームが入力価格を最適化しようとすると、リトライ、手戻り、品質低下という代償を払うことになる。解決策:ロールアウト前にジョブごとのモデルコストを算出する。

-

音声の不一致の落とし穴。チームがブランド向けコピーにフラットボイスモデルを使用すると、文章が不自然に聞こえる。解決策:ブランド向けコピーはSonnetでルーティングし、それ以外のコピーはコスト効率の良いモデルでルーティングする。

よくある質問

2026年における最高のAIモデルはどれですか?

単一の最高のモデルはありません。GPT-5.5は汎用的な処理に優れ、Claude 4.7 Opusは推論とエージェント処理に優れ、Sonnetは文章処理とブランドボイス処理に優れています。Gemini 3 Proは長文コンテキスト処理に優れ、Llama 5はオープンウェイト処理に優れ、DeepSeekはコストパフォーマンスに優れています。ユースケースに合わせてモデルを選択してください。

Claude 4.7はGPT-5.5より優れていますか?

「優れている」の定義は様々です。GPT-5.5は汎用的な製品開発や幅広いエコシステムにおいて、より優れたデフォルトモデルです。Opusは推論、エージェントの信頼性、指示追従に優れています。Sonnetは文章処理に優れています。現在、ほとんどのプロダクション環境では、ルーターの背後で両方のモデルが稼働しています。

2026年における最も安価な最先端モデルはどれですか?

DeepSeek V4とR2。100万件あたり約0.30ドルのインプットと1ドルのアウトプット。最高レベルの推論品質を持つクローズドエンドのフラッグシップモデルの約10分の1のコストです。

最も長いコンテキストウィンドウを持つモデルはどれですか?

Gemini 3 Pro。200万トークンの有効ウィンドウと高い検索信頼性を誇り、この分野のリーダーです。

2026年における最高のオープンウェイトモデルはどれですか?

英語を第一言語とする汎用的な作業にはLlama 5。多言語対応にはQwen 3。大規模な推論にはDeepSeek V4とR2。

フロンティアマップが実際に解き放つ変化

2026年のフロンティアは、単一のモデルがより賢くなることではありません。ジョブごとにルーティングを行うことで、小規模チームがはるかに大規模なチームの作業を処理できるようにする、専門家のスタックです。勝利を収めるのは、最高のモデル契約を持つチームではなく、最高のルーティングロジックを持つチームです。

2026年には「最高のモデル」は存在せず、「このタスクに最適なモデル」のみが存在する。そして、勝利を収めるのは、ランキングではなくユースケースに基づいてルーティングを行うチームだ。

もしあなたのチームがモデルを比較検討していて、どのモデルが最新のベンチマークでトップなのかという議論に終始しているなら、その議論自体に問題がある。ワークロードをマッピングし、それぞれのワークロードで最適なモデルを選び、実際のトラフィックで2週間のトライアルを実施し、コストと品質のバランスに基づいて判断を下すべきだ。

適切な最先端モデルの選定とルーティングレイヤーの構築についてサポートが必要な場合は、Brainy を雇用するを参照。ClaudeBrainyは、モデルレイヤーを適切に構築するためのスキルパックとプロンプトライブラリを提供している。AppBrainyは、デモではなく機能を搭載したAIをリリースしたいチーム向けに、完全な製品ビルドを提供している。

Want help picking the right frontier model for your product and routing the stack so the cost and quality math both work? Brainy ships ClaudeBrainy as a Skill pack and prompt library that gets the model layer right, and AppBrainy ships full product builds for teams that want their AI to actually ship features, not demos.

Get Started