Carte des modèles de frontière 2026 : GPT-5.5, Claude 4.7, Gemini 3 et leurs points forts

Une carte interactive des modèles de pointe en 2026. Les modèles GPT-5.5, Claude 4.7 Opus et Sonnet, Gemini 3 Pro, Llama 5, Grok 4, DeepSeek V4 et Qwen 3 sont évalués selon leurs performances réelles, les pertes qu'ils génèrent, une estimation du prix par million de jetons et une matrice de décision pour les concepteurs et les développeurs choisissant des modèles pour des produits concrets.

Il n'existe pas de modèle dominant en 2026. Le classement s'est fragmenté en une segmentation par spécialistes. GPT-5.5 excelle dans les tâches générales. Claude 4.7 Opus domine le raisonnement et la fiabilité des agents. Sonnet est performant en prose et offre le meilleur rapport vitesse/coût. Gemini 3 Pro est dominant pour les contextes longs. Llama 5 est performant pour les tâches à poids libre. Grok 4 occupe une niche en temps réel. DeepSeek a fait exploser le prix plancher. Qwen 3 est leader en multilinguisme.

Voici une cartographie des huit modèles importants, une estimation du prix par million de jetons, les quatre cas d'utilisation et leurs principaux atouts, ainsi que les quatre pièges à éviter lorsque les équipes choisissent en fonction du classement.

La frontière entre les modèles dominants et les spécialistes en 2026

En 2024, un seul modèle s'améliorait tous les six mois. En 2026, plusieurs modèles spécialisés ont émergé, et les équipes produit qui dominent actuellement utilisent deux ou trois modèles derrière une couche de routage.

Choisir un seul modèle pour tout est l'erreur la plus courante en 2026. Le coût explose sur les charges de travail inadaptées, et la qualité se dégrade sur celles où le modèle choisi est faible. L'avenir réside dans le routage, non dans la sélection.

GPT-5.5, le modèle polyvalent par excellence

GPT-5.5 est le modèle phare de OpenAI et le choix par défaut pour le développement produit général. C'est le modèle le plus performant lorsqu'on souhaite une API unique capable de tout faire avec compétence. Code robuste, utilisation optimale des outils, vision claire, faible latence et l'écosystème le plus mature de tous les modèles émergents.

Ses performances en termes de coûts sont inférieures à celles de Claude 4.7 Opus et de récupération de contexte long. En termes de qualité du style et de l'image de marque, il reste en deçà de Sonnet. Tarification : environ 5 dollars par million d’entrées et 15 dollars par million de sorties. Le milieu de gamme du marché.

Claude 4.7 Opus : le summum du raisonnement et de la fiabilité des agents

Claude 4.7 Opus est le modèle haut de gamme de Anthropic et offre la meilleure qualité de raisonnement et de fiabilité des agents disponible en 2026. Le modèle à privilégier lorsque la tâche doit réussir du premier coup. Le suivi des instructions est le plus fluide du marché. La conformité au format est irréprochable. La stabilité d’utilisation de l’outil lors de longues exécutions d’agents explique pourquoi Claude Code, le mode agent Cursor et la plupart des frameworks d’agents sérieux l’utilisent par défaut.

Son principal inconvénient est son coût. C’est le modèle phare le plus lent et le plus cher parmi les solutions propriétaires. Tarification : environ 15 dollars par million d’entrées et 75 dollars par million de sorties. Le choix idéal pour les appels critiques. À éviter pour les volumes importants de données.

Claude 4.7 Sonnet : le compromis idéal vitesse-coût

Claude 4.7 Sonnet est le modèle de référence pour la plupart des équipes de production en 2026. Il offre environ 90 % de la qualité d’Opus pour un coût bien moindre et une vitesse deux fois supérieure. Meilleure qualité de prose du marché. Meilleure préservation de la voix de marque. Dérive minimale lors des conversations longues. Le modèle privilégié par les concepteurs lorsque le texte est destiné à être lu par un humain.

Ses points faibles : légèrement moins performant qu’Opus pour les raisonnements les plus complexes et les longs trajets d’agents. Tarification : environ 3 dollars d’entrée et 15 dollars de sortie par million. Le meilleur rapport qualité-prix de tous les modèles fermés.

Claude 4.7 Haiku, la bête de somme à haut débit

Claude 4.7 Haiku est le modèle rapide et économique de la suite Anthropic, idéal lorsque le volume est élevé et que le niveau d'exigence par appel est modéré. Classification, extraction, balisage structuré, décisions de routage rapides, messagerie instantanée légère. Excellente gestion des instructions à ce niveau économique.

Cependant, il n'est pas adapté au raisonnement nuancé, à la rédaction de textes longs ni aux interventions intensives d'agents. Tarification : environ 1 dollar en entrée et 5 dollars en sortie par million.

Gemini 3 Pro, champion du contexte long et du multimodal

Gemini 3 Pro est le fleuron de Google et le modèle le plus performant en 2026 pour la recherche de contexte long, l'ancrage de documents et le multimodal natif. La fenêtre de contexte effective de deux millions de jetons, associée à une fiabilité exceptionnelle (comme chercher une aiguille dans une botte de foin), est sans égale. La gestion native des entrées vidéo, audio et image est la plus fluide du marché.

Points faibles : la voix écrite est le point faible des modèles phares. La prose est correcte, mais manque de relief. La voix de marque nécessite un accompagnement important pour dépasser le registre par défaut. Tarification : environ 2,50 dollars par million d’entrées et 10 dollars par million de sorties. Un excellent rapport qualité-prix pour un modèle à contexte étendu.

Llama 5, le modèle par défaut à poids ouvert

Llama 5 est le modèle phare de la famille à poids ouvert de Meta et le meilleur modèle auto-hébergé en 2026. Le choix idéal lorsque la résidence des données, la maîtrise des coûts ou le réglage fin priment sur la qualité absolue. La variante à 405 milliards de paramètres se rapproche de GPT-5.5 sur la plupart des benchmarks généraux.

Points faibles : le coût d’infrastructure pour auto-héberger la variante étendue est non négligeable. Llama 5 hébergé par un fournisseur se situe dans la même gamme de prix que Sonnet, sans l'avantage de la prose. Tarification : environ 1 à 2 dollars par million, selon les fournisseurs d'hébergement.

Grok 4, le choix de niche pour le temps réel

Grok 4 est le produit phare de xAI. Il offre un accès natif et en temps réel au flux de données X et une voix par défaut décalée. Idéal pour des charges de travail spécifiques : veille médiatique, analyse des sentiments, analyse d'événements en temps réel et tout produit nécessitant l'analyse des dernières 60 secondes de discours public, et non les données d'entraînement de la veille.

Ses points faibles : le raisonnement est moins performant qu'Opus, le code moins performant que GPT-5.5. La voix peut poser problème pour tout produit où la personnalité doit refléter l'image de marque. Tarification : environ 5 dollars d'entrée et 15 dollars de sortie par million. Dans la même gamme de prix que GPT-5.5, mais pour des applications beaucoup plus ciblées.

DeepSeek V4 et R2, les solutions qui font exploser les coûts

DeepSeek V4 et R2 sont les deux moteurs de raisonnement open source qui ont révolutionné le marché en 2026. V4 est le modèle général, tandis que R2 est le spécialiste du raisonnement. Ils offrent une qualité de raisonnement optimale pour environ un dixième du prix des modèles propriétaires. Hébergés par DeepSeek ou auto-hébergés à partir des poids open source, ils peuvent également être utilisés.

Points faibles : stabilité d'utilisation légèrement inférieure à celle de Claude 4.7 ; la récupération de contextes longs est plus lente que celle de Gemini 3 ; qualité de la prose inférieure à celle de Sonnet. Tarification : environ 0,30 dollar en entrée et 1 dollar en sortie par million. Les équipes de production utilisent désormais DeepSeek pour le raisonnement à haut volume et réservent Opus aux décisions qui exigent une précision absolue.

Qwen 3, le modèle multilingue par défaut

Qwen 3 est la famille de modèles open-weight d'Alibaba et le modèle open le plus performant pour les charges de travail multilingues. C'est le choix idéal lorsque le produit est disponible dans plus que l'anglais et le mandarin. Il excelle dans les langues asiatiques, l'arabe et les nombreuses langues régionales où Llama 5 commence à montrer ses limites.

Ses points faibles en termes de coûts : les benchmarks en anglais uniquement sont légèrement inférieurs à ceux de Llama 5. L'offre d'hébergement est moins aboutie en dehors d'Alibaba Cloud. Les prix sont similaires à ceux de Llama 5 chez les fournisseurs mutualisés, et très avantageux en auto-hébergement.

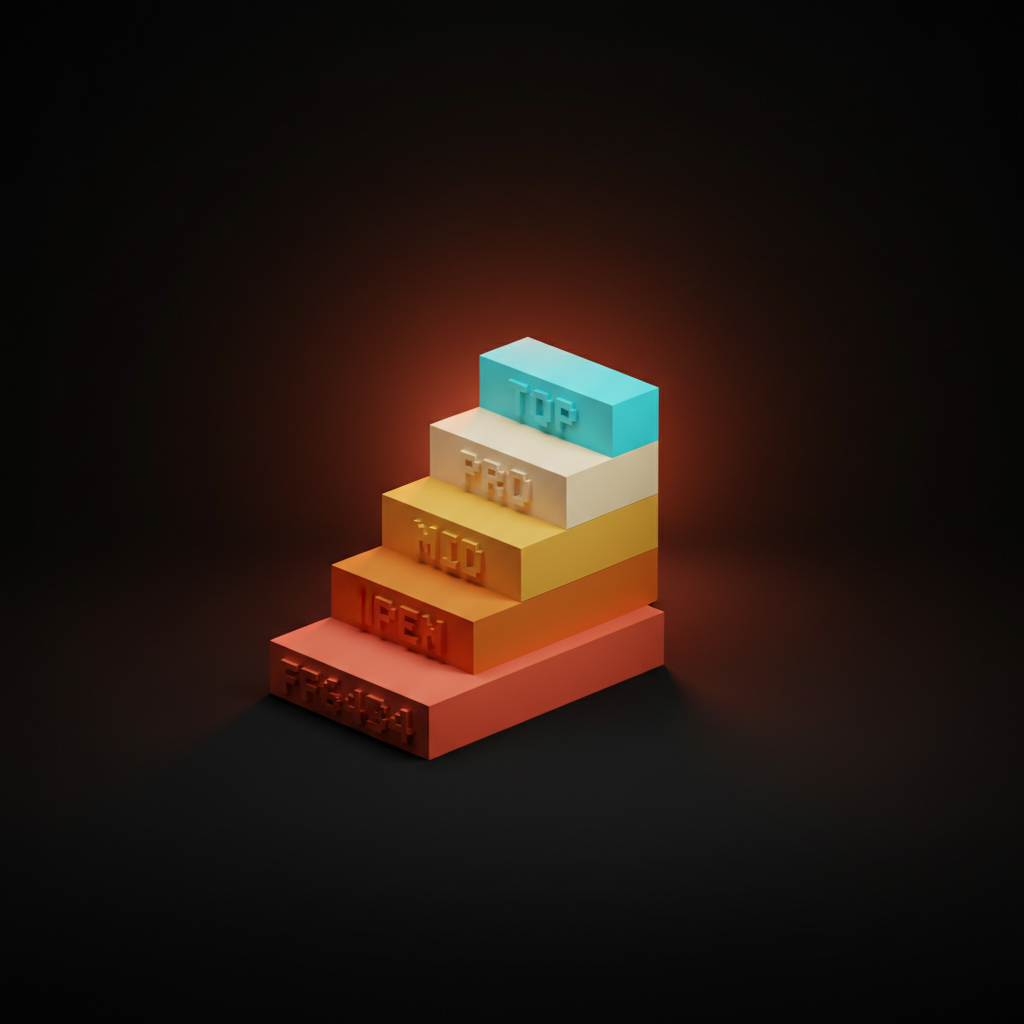

Tarification en 2026 : le coût réel par million de tokens

La tarification est structurée en quatre niveaux. Les modèles économiques par token ne sont pas toujours économiques par tâche lorsque la profondeur de raisonnement et les taux de reprise entrent en ligne de compte.

| Modèle | Entrée ($/1M) | Sortie ($/1M) | Niveau |

|---|---|---|---|

| Claude 4.7 Opus | 15 | 75 | Top |

| GPT-5.5 | 5 | 15 | Pro |

| Grok 4 | 5 | 15 | Pro |

| Claude 4.7 Sonnet | 3 | 15 | Pro |

| Gemini 3 Pro | 2.50 | 10 | Mid |

| Llama 5 (hébergé) | 1 à 2 | 1 à 2 | Mid |

| Qwen 3 (hébergé) | 1 à 2 | 1 à 2 | Mid |

| Claude 4.7 Haiku | 1 | 5 | Mid |

| DeepSeek V4 | 0.30 | 1 | Open |

| DeepSeek R2 | 0,30 | 1 | Ouvert |

Le coût par tâche est primordial. Un modèle bon marché nécessitant trois tentatives pour une tâche complexe est plus coûteux qu'un appel Opus aboutissant du premier coup. Effectuez les calculs sur un trafic réel avant de verrouiller la couche de routage.

Les quatre cas d'utilisation côté conception

La synthèse de recherche, l'assurance qualité des copies, les pipelines de génération d'images et l'utilisation de l'invite comme composant sont les quatre charges de travail qui déterminent quel modèle mérite sa clé API. Chacune a son propre modèle gagnant.

Synthèse de recherche : le modèle Gemini 3 Pro l'emporte

La synthèse de recherche est la charge de travail à contexte long, consistant à intégrer dix rapports dans une invite et à obtenir un résumé clair et précis. Gemini 3 Pro se distingue par sa fiabilité de récupération, la qualité des citations et sa fenêtre d'exécution efficace au-delà d'un million de jetons. Sonnet est une excellente alternative pour les échéances plus courtes. Les calculs mathématiques privilégient Gemini dès que le nombre de jetons d'entrée dépasse 200 000. Pour les flux de travail où l'efficacité de la fenêtre prime sur la taille brute, voir efficacité contextuelle.

Assurance qualité des textes : Sonnet Claude 4.7 l'emporte

L'assurance qualité des textes englobe la vérification de la voix de marque, l'analyse critique des micro-textes et la cohérence du ton à grande échelle. Sonnet offre le meilleur choix en termes de goût, la prose la plus claire et la plus faible dérive lors de longues sessions. Associé à une grille d'évaluation structurée et à un pack de voix de marque Claude Compétences, le pipeline d'évaluation s'exécute automatiquement.

Pipelines de génération d'images : l'importance du routage

Les pipelines de génération d'images ne se distinguent pas par un modèle unique, mais par le routage. En 2026, le modèle de mise en forme des invites sera GPT-5.5, associé à un modèle d'image dédié en arrière-plan. Sonnet se positionne en deuxième position lorsque la voix de marque doit être intégrée à l'invite. Le modèle d'image lui-même fait l'objet d'une décision distincte et évolue plus rapidement que la couche linguistique.

Invite en tant que composant : Opus Claude 4.7 l'emporte

L'invite en tant que composant correspond à la charge de travail où une invite devient une primitive de production réutilisable, avec une conformité stricte au format, une sortie structurée et une utilisation optimale des outils lors d'exécutions prolongées de l'agent. Opus excelle en matière de suivi des instructions, de conformité au format et de stabilité d'utilisation des outils. Pour le développement d'IDE avec agents, voir Comparaison des éditeurs de code IA. Pour Modèles d'interface utilisateur d'agent, le modèle sous-jacent est presque toujours Opus pour les appels qui doivent aboutir.

La matrice de décision à quatre cas d'utilisation

| Cas d'utilisation | Choix | Justification |

|---|---|---|

| Synthèse de la recherche | Gemini 3 Pro | Contexte étendu, qualité des citations, fiabilité éprouvée sur plus de 200 000 jetons. |

| Assurance qualité du contenu | Claude 4.7 Sonnet | Style d'écriture impeccable, dérive minimale, excellente fidélité à la voix de marque. |

| Génération d'images | GPT-5.5 (invite) + modèle d'image dédié | Optimisation des invites et intégration avec un large éventail de fournisseurs. |

| Invite en tant que composant | Claude 4.7 Opus | Respect optimal des instructions, conformité des formats, stabilité d'utilisation des outils. |

Le choix du modèle est crucial. En 2026, rares sont les équipes de production qui utilisent un seul modèle. La plupart optent pour deux ou trois, derrière une couche de routage qui sélectionne le modèle à chaque appel.

Besoin d'aide pour choisir le modèle de pointe adapté à votre produit et configurer le routage de manière à optimiser le rapport coût/qualité ? Embaucher Brainy. ClaudeBrainy propose des packs de compétences et des bibliothèques d'invites pour une configuration optimale de la couche de modélisation. AppBrainy fournit des versions complètes de ses produits aux équipes qui souhaitent que leur IA déploie des fonctionnalités, et non se contente de démonstrations.

Place de chaque modèle dans les architectures de produits réelles

Le classement est une chose, l'architecture en est une autre. Les huit modèles occupent des rôles bien définis.

GPT-5.5 est utilisé pour les conversations avec les clients et constitue le modèle par défaut pour toute nouvelle version nécessitant une API unique. Opus est utilisé pour les appels aux agents les plus critiques et les primitives de génération de messages. Sonnet est utilisé pour les interfaces de marque et d'écriture à long terme. Haiku est utilisé pour les tâches d'arrière-plan à fort volume. Gemini 3 Pro est utilisé pour les applications multimodales et le traitement de documents. Llama 5 est utilisé pour les architectures réglementées, avec des données stockées en interne et un contrôle des coûts. Grok 4 est utilisé pour les niches de l'actualité en temps réel. DeepSeek est utilisé pour le raisonnement à haut volume, un domaine où le coût aurait compromis le projet. Qwen 3 est intégré aux environnements multilingues et Asie-Pacifique.

Quatre pièges liés au choix du modèle par benchmark

Premier piège : le modèle en tête d’un benchmark en mars, mais obsolète en juillet. Solution : choisir en fonction du cas d’usage et réévaluer la couche de routage chaque trimestre.

Deuxième piège : le modèle unique. Une équipe fige un modèle pour l’ensemble de la pile et se heurte à un blocage sur les charges de travail qu’il ne remporte pas. Solution : router par tâche, et non par contrat.

Troisième piège : le coût minimal. Une équipe optimise le coût des entrées et le paie cher en termes de tentatives supplémentaires, de retouches et de baisse de qualité. Solution : modéliser le coût par tâche avant le déploiement.

Quatrième piège : l’inadéquation du ton. Une équipe utilise un modèle au ton neutre pour les textes destinés à la marque, ce qui donne un résultat peu engageant. Solution : router les textes de marque via Sonnet, et le reste via le modèle le plus économique.

FAQ

Quel est le meilleur modèle d'IA en 2026 ?

Il n'y a pas de modèle unique idéal. GPT-5.5 est performant pour les tâches générales, Claude 4.7 Opus excelle dans le raisonnement et les agents, Sonnet dans la prose et la voix de marque, Gemini 3 Pro dans les contextes longs, Llama 5 dans les poids ouverts et DeepSeek est le plus économique. Choisissez le modèle le plus adapté à votre cas d'utilisation.

Claude 4.7 est-il meilleur que GPT-5.5 ?

La notion de « meilleur » varie. GPT-5.5 est le modèle par défaut idéal pour les tâches générales liées aux produits et son écosystème est le plus vaste. Opus est plus performant en matière de raisonnement, de fiabilité des agents et de suivi des instructions. Sonnet est meilleur pour la prose. La plupart des environnements de production utilisent désormais les deux, derrière un routeur.

Quel est le modèle de pointe le plus économique en 2026 ?

DeepSeek V4 et R2. Environ 0,30 dollar en entrée et 1 dollar en sortie par million. Soit environ un dixième du coût des solutions phares propriétaires offrant une qualité de raisonnement optimale.

Quel modèle possède la fenêtre de contexte la plus longue ?

Gemini 3 Pro. Sa fenêtre effective de deux millions de jetons et sa grande fiabilité de récupération en font le leader du marché.

Quel est le meilleur modèle open-weight en 2026 ?

Llama 5 pour les tâches générales en anglais. Qwen 3 pour le multilinguisme. DeepSeek V4 et R2 pour le raisonnement à grande échelle.

Le véritable tournant que révèle la carte des frontières

En 2026, la frontière ne réside pas dans l’amélioration d’un seul modèle. Il s’agit d’une combinaison de spécialistes permettant à une petite équipe de réaliser le travail d’une équipe beaucoup plus importante grâce à un routage par tâche. Les équipes gagnantes ne sont pas celles qui possèdent le meilleur contrat de modèle, mais celles qui maîtrisent la meilleure logique de routage.

Il n'existe pas de modèle idéal en 2026, seulement des modèles adaptés à chaque tâche. Les équipes qui réussissent sont celles qui privilégient le routage basé sur les cas d'usage plutôt que sur les classements.

Si votre équipe compare des modèles et que la discussion s'enlise dans la question de savoir lequel surpasse le dernier benchmark, c'est que la discussion est le problème. Cartographiez les charges de travail, choisissez le modèle le plus performant pour chacune, effectuez un test de deux semaines sur du trafic réel et laissez le calcul du rapport coût-qualité trancher.

Si vous souhaitez de l'aide pour choisir le modèle de pointe le plus adapté et mettre en place la couche de routage, embauche Brainy. ClaudeBrainy propose des packs de compétences et des bibliothèques d'invites qui optimisent la couche de modélisation. AppBrainy fournit des solutions complètes pour les équipes qui souhaitent que leur IA déploie des fonctionnalités, et non de simples démonstrations.

Want help picking the right frontier model for your product and routing the stack so the cost and quality math both work? Brainy ships ClaudeBrainy as a Skill pack and prompt library that gets the model layer right, and AppBrainy ships full product builds for teams that want their AI to actually ship features, not demos.

Get Started