Mapa del modelo Frontier 2026: GPT-5.5, Claude 4.7, Gemini 3 y qué hace mejor cada uno.

Un mapa de trabajo del panorama de modelos frontera de 2026. GPT-5.5, Claude 4.7 Opus y Sonnet, Gemini 3 Pro, Llama 5, Grok 4, DeepSeek V4 y Qwen 3 se califican según en qué ganan realmente, dónde pierden dinero, precios aproximados por millón de tokens y una matriz de decisión para diseñadores y constructores que eligen modelos para pilas de productos reales.

No existe un modelo líder en 2026. La clasificación se fragmentó en especialistas. GPT-5.5 se impone en el trabajo general. Claude 4.7 Opus destaca en razonamiento y fiabilidad de agentes. Sonnet se impone en prosa y en el equilibrio óptimo velocidad-coste. Gemini 3 Pro se impone en contexto extenso. Llama 5 se impone en ponderación abierta. Grok 4 domina un nicho en tiempo real. DeepSeek destruyó el precio mínimo. Qwen 3 domina el ámbito multilingüe.

Este es un mapa de trabajo de los ocho modelos relevantes, precios aproximados por millón de tokens, los cuatro casos de uso y qué los hace exitosos, y las cuatro trampas en las que caen los equipos al elegir según la clasificación.

La frontera se divide en especialistas en 2026

En 2024, un modelo mejoraba cada seis meses. En 2026, se observa una pila de especialistas, y los equipos de producto que están ganando actualmente utilizan dos o tres modelos detrás de una capa de enrutamiento.

Elegir un único modelo para todo es el error más común en 2026. El costo se dispara en cargas de trabajo inadecuadas, y la calidad disminuye en aquellas donde el modelo seleccionado es débil. La frontera es un problema de enrutamiento, no de selección.

GPT-5.5, el caballo de batalla general

GPT-5.5 es el producto estrella de OpenAI y la opción predeterminada para el desarrollo general de productos. Es el modelo más completo cuando se busca una API que lo haga casi todo con competencia. Código robusto, uso eficiente de herramientas, visión estratégica, baja latencia y el ecosistema más maduro de cualquier modelo de vanguardia.

Sus limitaciones: Razonamiento de formato largo: Claude 4.7 Opus. Recuperación de contexto largo: Gemini 3 Pro. La calidad de la voz y la prosa de la marca se sitúa por debajo de Sonnet. Precio: alrededor de 5 dólares por millón de entrada y 15 por millón de salida. La gama media del sector cerrado.

Claude 4.7 Opus, el máximo rendimiento en razonamiento y agentes

Claude 4.7 Opus es el modelo de gama alta de Anthropic y la mejor superficie de razonamiento y fiabilidad de agentes disponible en 2026. El modelo ideal cuando la tarea debe completarse al primer intento. El seguimiento de instrucciones es el más preciso del sector. El cumplimiento del formato es impecable. La estabilidad en el uso de herramientas durante largas ejecuciones de agentes es la razón por la que Claude Code, el modo de agente Cursor y la mayoría de los marcos de agentes más exigentes lo utilizan por defecto.

Su coste es elevado. Es el más lento y caro de los buques insignia cerrados. Precio: alrededor de 15 dólares por millón de entrada y 75 por millón de salida. La opción ideal para las llamadas de mayor riesgo. La opción incorrecta para trabajos de alto volumen.

Claude 4.7 Sonnet: la relación velocidad-costo ideal

Claude 4.7 Sonnet es el modelo que la mayoría de los equipos de producción deberían adoptar por defecto en 2026. Ofrece aproximadamente el 90 % de la calidad de Opus a una fracción del costo y con el doble de velocidad. La mejor calidad de prosa del sector. La mejor retención de la voz de la marca. La menor desviación en conversaciones largas. El modelo que los diseñadores eligen cuando el resultado será leído por una persona.

Sus limitaciones económicas. Ligeramente inferior a Opus en los razonamientos más complejos y en las sesiones más largas con agentes. Precio: alrededor de 3 dólares de entrada y 15 dólares de salida por millón. La mejor relación costo-calidad de cualquier modelo cerrado.

Claude 4.7 Haiku, el caballo de batalla de alto rendimiento

Claude 4.7 Haiku es el modelo rápido y económico de la pila Anthropic, la opción ideal cuando el volumen es alto y la calidad por llamada es moderada. Clasificación, extracción, etiquetado estructurado, decisiones de enrutamiento rápidas, chat ligero. Seguimiento de instrucciones sólido en el nivel económico.

Sus limitaciones: No es adecuado para razonamiento matizado, redacción de textos extensos ni para tareas complejas de agentes. Precio: alrededor de 1 dólar de entrada y 5 dólares de salida por millón.

Gemini 3 Pro, el campeón en contexto extenso y multimodal

Gemini 3 Pro es el buque insignia de Google y el modelo más potente en 2026 para la recuperación de contexto extenso, la vinculación de documentos y el procesamiento multimodal nativo. La ventana de contexto efectiva de dos millones de tokens, con una fiabilidad excepcional, es inigualable. El manejo nativo de entrada de vídeo, audio e imagen es el más limpio del sector.

Sus limitaciones económicas: La voz escrita es la más débil entre los modelos insignia. La prosa se lee correctamente, pero sin brillo. El trabajo con la voz de marca requiere mucha ayuda para superar el registro predeterminado. Precio: alrededor de 2,50 dólares de entrada y 10 de salida por millón. Excelente relación coste-beneficio para un contexto extenso.

Llama 5, el modelo abierto predeterminado

Llama 5 es el modelo abierto insignia de Meta y el mejor modelo que se puede autoalojar en 2026. La elección ideal cuando la residencia de datos, el control de costes o el ajuste fino son más importantes que la calidad absoluta. La variante de 405 mil millones de parámetros se acerca bastante a GPT-5.5 en la mayoría de las pruebas de rendimiento generales.

Sus limitaciones económicas: El coste de infraestructura para autoalojar la variante grande es considerable. Llama 5, alojado por un proveedor, se sitúa en el mismo rango de precios que Sonnet, pero sin la ventaja de la prosa. Precio: aproximadamente de 1 a 2 dólares por millón, con una combinación de proveedores de alojamiento.

Grok 4, la opción especializada en tiempo real

Grok 4 es el producto estrella de xAI, con acceso nativo en tiempo real al flujo de datos de X y una voz predeterminada irreverente. Útil para cargas de trabajo específicas: monitorización de noticias, análisis de sentimiento, análisis de eventos en tiempo real y cualquier producto donde la IA necesite los últimos sesenta segundos de discurso público, no los datos de entrenamiento del día anterior.

Sus limitaciones son menores. Su razonamiento es inferior al de Opus. Su código es inferior al de GPT-5.5. La voz puede ser un problema en cualquier producto donde la personalidad deba provenir de la marca. Precio: alrededor de 5 dólares de entrada y 15 dólares de salida por millón. En el mismo rango que GPT-5.5, pero para una tarea mucho más específica.

DeepSeek V4 y R2: la revolución en costos

DeepSeek V4 y R2 son el par de algoritmos de razonamiento de ponderación abierta que rompieron el límite de precio en 2026. V4 es el modelo general. R2 es el especialista en razonamiento. Calidad de razonamiento de primer nivel a aproximadamente una décima parte del costo de un modelo cerrado. Alojado en DeepSeek o autoalojado desde las ponderaciones abiertas.

Sus limitaciones: Estabilidad de uso de herramientas ligeramente inferior a la de Claude 4.7. Recuperación de contexto largo con un retraso respecto a Gemini 3. Calidad de prosa inferior a la de Sonnet. Precio: alrededor de 0,30 dólares de entrada y 1 dólar de salida por millón. Los equipos de producción ahora enrutan el razonamiento de alto volumen a través de DeepSeek y reservan Opus para las llamadas que deben ser perfectas.

Qwen 3, el modelo multilingüe abierto predeterminado

Qwen 3 es la familia de modelos abiertos de Alibaba y el modelo abierto más potente para cargas de trabajo multilingües. La opción ideal cuando el producto se distribuye en más idiomas que inglés y mandarín. Destaca en idiomas asiáticos, árabe y la gran cantidad de idiomas regionales donde Llama 5 empieza a flaquear.

Sus limitaciones. Las pruebas de rendimiento solo en inglés se sitúan ligeramente por debajo de Llama 5. La oferta de proveedores alojados es menos madura fuera de Alibaba Cloud. El precio es similar al de Llama 5 en proveedores compartidos, y muy económico en autoalojamiento.

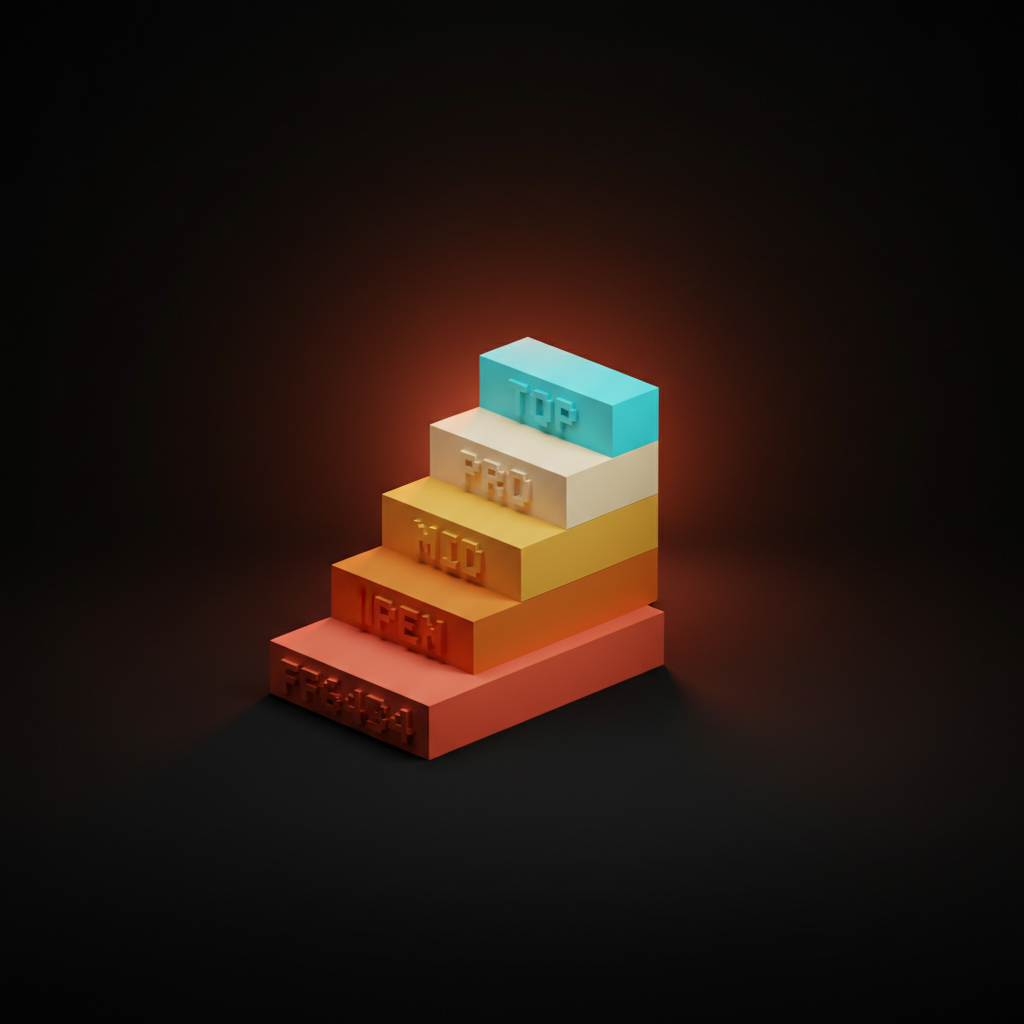

Precios en 2026: ¿Cuánto cuesta realmente cada millón de tokens?

Los precios se han estratificado en cuatro niveles. Los modelos económicos por token no siempre resultan económicos por trabajo cuando se consideran la profundidad del razonamiento y las tasas de retrabajo.

| Modelo | Entrada ($/1M) | Salida ($/1M) | Nivel |

|---|---|---|---|

| Claude 4.7 Opus | 15 | 75 | Top |

| GPT-5.5 | 5 | 15 | Pro |

| Grok 4 | 5 | 15 | Pro |

| Claude 4.7 Sonnet | 3 | 15 | Pro |

| Gemini 3 Pro | 2.50 | 10 | Mid |

| Llama 5 (hosted) | 1 to 2 | 1 to 2 | Mid |

| Qwen 3 (hosted) | 1 to 2 | 1 to 2 | Mid |

| Claude 4.7 Haiku | 1 | 5 | Mid |

| DeepSeek V4 | 0.30 | 1 | Open | DeepSeek R2 | 0.30 | 1 | Abierto |

El costo por tarea es lo que importa. Un modelo económico que requiere tres reintentos en una tarea difícil es más costoso que una llamada a Opus que se ejecuta una sola vez. Realice los cálculos con tráfico real antes de bloquear la capa de enrutamiento.

Los cuatro casos de uso del lado del diseño

Síntesis de investigación, control de calidad de copias, pipelines de generación de imágenes y la función de solicitud como componente son las cuatro cargas de trabajo que determinan qué modelo obtiene su clave API. Cada una tiene un ganador diferente.

Síntesis de investigación, donde Gemini 3 Pro gana

La síntesis de investigación es la carga de trabajo de contexto extenso, que consiste en insertar diez informes en una solicitud y obtener un resumen claro y bien fundamentado. Gemini 3 Pro gana en confiabilidad de recuperación, calidad de citas y ventana efectiva más allá de un millón de tokens. Sonnet es una sólida segunda opción en horizontes más cortos. Las matemáticas favorecen a Gemini una vez que las entradas superan los doscientos mil tokens. Para flujos de trabajo donde la eficiencia de la ventana es más importante que el tamaño bruto, consulte eficiencia del contexto.

Control de calidad de textos, donde Claude 4.7 Sonnet gana

El control de calidad de textos consiste en la revisión de la voz de la marca, la crítica del microtexto y la coherencia del tono a gran escala. Sonnet tiene el mejor gusto, la prosa más limpia y la menor variación en sesiones largas. Combínelo con una rúbrica estructurada y un paquete de voz de marca Claude Habilidades y el proceso de evaluación se ejecuta de forma automatizada.

Procesos de generación de imágenes, donde el enrutamiento es importante

Los procesos de generación de imágenes no se ganan con un solo modelo, sino con el enrutamiento. El ganador en la configuración de indicaciones en 2026 es GPT-5.5 combinado con un modelo de imagen dedicado en el backend. Sonnet es una sólida segunda opción cuando la voz de la marca debe estar presente en la indicación. El modelo de imagen en sí es una decisión independiente y cambia más rápido que la capa de lenguaje.

El indicador como componente, donde Claude 4.7 Opus gana

El indicador como componente es la carga de trabajo donde un indicador se convierte en una primitiva de producción reutilizable, con estricto cumplimiento de formato, salida estructurada y uso de herramientas en ejecuciones prolongadas del agente. Opus gana en seguimiento de instrucciones, cumplimiento de formato y estabilidad en el uso de herramientas. Para el trabajo con IDE de agente, consulte Comparación de editores de código de IA. Para Patrones de interfaz de usuario de agente, el modelo subyacente es casi siempre Opus en las llamadas que deben llegar.

La matriz de decisión de cuatro casos de uso

| Caso de uso | Selección | Por qué |

|---|---|---|

| Síntesis de investigación | Gemini 3 Pro | Contexto extenso, calidad de citas, base sólida más allá de 200.000 tokens. |

| Control de calidad de textos | Claude 4.7 Sonnet | El mejor estilo de prosa, la menor desviación, la mayor retención de la voz de la marca. |

| Pipelines de generación de imágenes | GPT-5.5 (propuesta) + modelo de imagen dedicado | La mejor configuración de la propuesta con la mayor cantidad de integraciones de proveedores. |

| Propuesta como componente | Claude 4.7 Opus | El mejor seguimiento de instrucciones, cumplimiento de formato, estabilidad en el uso de herramientas. |

Las combinaciones importan. Pocos equipos de producción trabajarán con un solo modelo en 2026. La mayoría optará por dos o tres detrás de una capa de enrutamiento que selecciona por llamada.

¿Necesitas ayuda para elegir el modelo de frontera adecuado para tu producto y configurar el enrutamiento para que los cálculos de costo y calidad funcionen correctamente? Contratar Brainy. ClaudeBrainy ofrece paquetes de habilidades y bibliotecas de propuestas que optimizan la capa del modelo. AppBrainy ofrece versiones completas de productos para equipos que desean que su IA implemente funcionalidades reales, no solo demostraciones.

Ubicación de cada modelo en entornos de producto reales

Una cosa es la clasificación, otra muy distinta es el entorno. Los ocho modelos se han consolidado en áreas bien definidas.

GPT-5.5 se sitúa a la vanguardia del chat para consumidores y es la opción predeterminada en cualquier nueva versión que requiera una única API. Opus se ubica detrás de las llamadas de agentes de mayor importancia y las primitivas de mensajes como componentes. Sonnet se ubica en plataformas de marca y escritura de larga trayectoria. Haiku se ubica en tareas en segundo plano de alto volumen. Gemini 3 Pro se ubica en entornos multimodales y con gran cantidad de documentos. Llama 5 se ubica en entornos regulados, con restricciones de residencia de datos y control de costos. Grok 4 se ubica en nichos de noticias en tiempo real. DeepSeek se ubica en el ámbito del razonamiento de alto volumen, donde el costo habría sido un obstáculo insalvable para el proyecto. Qwen 3 se integra en pilas multilingües y para la región Asia-Pacífico.

Cuatro trampas al elegir por referencia

Primero: La trampa de la clasificación. Un equipo elige el modelo que lidera una referencia en marzo y, para julio, ya no es la opción adecuada. Solución: elegir según la adecuación al caso de uso y reevaluar la capa de enrutamiento cada trimestre.

Segundo: La trampa del modelo único. Un equipo se centra en un solo modelo para toda la pila y se topa con un muro en la carga de trabajo que no puede gestionar. Solución: enrutar por tarea, no por contrato.

Tercero: La trampa del token barato. Un equipo optimiza el precio de entrada y paga con reintentos, retrabajo y una disminución de la calidad. Solución: calcular el coste por tarea del modelo antes del lanzamiento.

Cuarto: La trampa de la incongruencia de voz. Un equipo utiliza un modelo de voz plana para el contenido de marca y el resultado es insípido. Solución: enrutar el contenido de marca a través de Sonnet y el resto a través de la opción más rentable.

Preguntas frecuentes

¿Cuál es el mejor modelo de IA en 2026?

No existe un único mejor. GPT-5.5 destaca en tareas generales, Claude 4.7 Opus en razonamiento y agentes, Sonnet en prosa y voz de marca, Gemini 3 Pro en contexto extenso, Llama 5 en ponderación abierta y DeepSeek en coste. Adapta el modelo al caso de uso.

¿Es Claude 4.7 mejor que GPT-5.5?

La mejoría puede variar. GPT-5.5 es la mejor opción predeterminada para tareas generales de producto y el ecosistema más amplio. Opus destaca en razonamiento, fiabilidad de agentes y seguimiento de instrucciones. Sonnet destaca en prosa. La mayoría de las plataformas de producción ahora ejecutan ambos modelos detrás de un enrutador.

¿Cuál es el modelo de vanguardia más económico en 2026?

DeepSeek V4 y R2. Aproximadamente 0,30 dólares de entrada y 1 dólar de salida por millón. Alrededor de una décima parte del costo de los buques insignia cerrados con una calidad de razonamiento de primer nivel.

¿Qué modelo tiene la ventana de contexto más larga?

Gemini 3 Pro. La ventana efectiva de dos millones de tokens con una alta fiabilidad de recuperación es líder en el sector.

¿Cuál es el mejor modelo de ponderación abierta en 2026?

Llama 5 para trabajo general con prioridad en inglés. Qwen 3 para multilingüe. DeepSeek V4 y R2 para razonamiento a gran escala.

El cambio que realmente desbloquea el mapa de la frontera

La frontera en 2026 no es un solo modelo que se vuelve más inteligente. Es un conjunto de especialistas que permite que un equipo pequeño realice el trabajo de uno mucho más grande al enrutar por tarea. Los equipos ganadores no son los que tienen el mejor contrato de modelo, sino los que tienen la mejor lógica de enrutamiento.

En 2026 no existe un modelo óptimo, sino el más adecuado para cada tarea, y los equipos que ganan son aquellos que priorizan el enrutamiento según el caso de uso en lugar de basarse en clasificaciones.

Si tu equipo está comparando modelos y la conversación se estanca en cuál supera la última prueba comparativa, el problema radica en la conversación. Mapea las cargas de trabajo, elige el modelo que mejor se adapte a cada una, realiza una prueba de dos semanas con tráfico real y deja que el análisis de costo-calidad tome la decisión.

Si necesitas ayuda para elegir el modelo de vanguardia adecuado e implementar la capa de enrutamiento, consulta contratar Brainy. ClaudeBrainy ofrece paquetes de habilidades y bibliotecas de indicaciones que optimizan la capa del modelo. AppBrainy ofrece compilaciones completas de productos para equipos que desean que su IA implemente funcionalidades, no solo demostraciones.

Want help picking the right frontier model for your product and routing the stack so the cost and quality math both work? Brainy ships ClaudeBrainy as a Skill pack and prompt library that gets the model layer right, and AppBrainy ships full product builds for teams that want their AI to actually ship features, not demos.

Get Started