Eingabeaufforderungen als Komponenten: Wie Designer im Jahr 2026 wiederverwendbare Eingabeaufforderungsbibliotheken erstellen

Komponenten machten Design in den 2010er-Jahren skalierbar. 2026 sind Prompts die neuen Komponenten. Ein praktischer Leitfaden für Designer, die wiederverwendbare Prompt-Bibliotheken erstellen: Aufbau, Varianten, Versionierung, Verteilung und die neue Rolle des Prompt-Bibliothekars.

Ein Senior Designer im Jahr 2026 öffnet seine Prompt-Bibliothek genauso wie ein Senior Designer im Jahr 2018 seine Komponentenbibliothek. Er wählt den Brand-Audit-Prompt, Version 2.4, und löst ihn auf der neuen Homepage-Variante aus. Das Ergebnis ist in 15 Sekunden da. Die Rubrik bewertet es. Die Warteschlange bewegt sich.

Diese Bewegung ist ohne eine zugrunde liegende Bibliothek unmöglich. Die meisten Teams haben keine. Sie haben eine Seite mit eingefügten Prompts (Notion), einen Thread mit drei Anpassungen (Slack) und einen Designer, der sich die guten merkt. Dieser Stapel verfällt, sobald das zugrunde liegende Modell aktualisiert wird.

Prompts sind die neuen Komponenten. Sie haben Struktur, Varianten, Versionierung, Zusammensetzung, Verteilung und einen Bibliothekar, der dafür zuständig ist. Die Teams, die im Jahr 2026 am schnellsten wachsen, haben aufgehört, Prompts als Wegwerftexte zu schreiben und liefern sie wie einen Link (Designsystem) aus.

Das praktische Handbuch: Fünfteilige Struktur, Variantenmatrix, Versionsregeln, Verteilungsoberflächen, die zuständige Rolle.

Eingabeaufforderungen verhalten sich wie Komponenten, behandeln Sie sie auch so.

Eine Eingabeaufforderung ist eine wiederverwendbare Anweisungseinheit, die ein Modell lädt, um eine Aufgabe auszuführen. Sie hat dieselbe Aufgabenbeschreibung wie eine Komponente. Wiederverwendbar. Abgegrenzt. Konfiguriert am Aufrufort. Zugeordnet. Versioniert. Vertrauenswürdig, da sie tausendfach verwendet wurde.

Ein Team, das Eingabeaufforderungen als einmalige Zeichenketten schreibt, liefert Zeichenketten aus. Ein Team, das Eingabeaufforderungen als Komponenten schreibt, liefert Assets aus. Zeichenketten führen zu Fehlern, wenn ein Modell aktualisiert wird, ein Teammitglied hinzukommt oder dieselbe Aufgabe auf eine andere Oberfläche verschoben wird. Komponenten bleiben erhalten.

Der entscheidende Punkt ist die Umstellung. Behandeln Sie die Eingabeaufforderung nicht länger als etwas, das Sie gestern geschrieben und vergessen haben. Behandeln Sie sie stattdessen als etwas, das das Team installiert, konfiguriert, evaluiert und ausliefert.

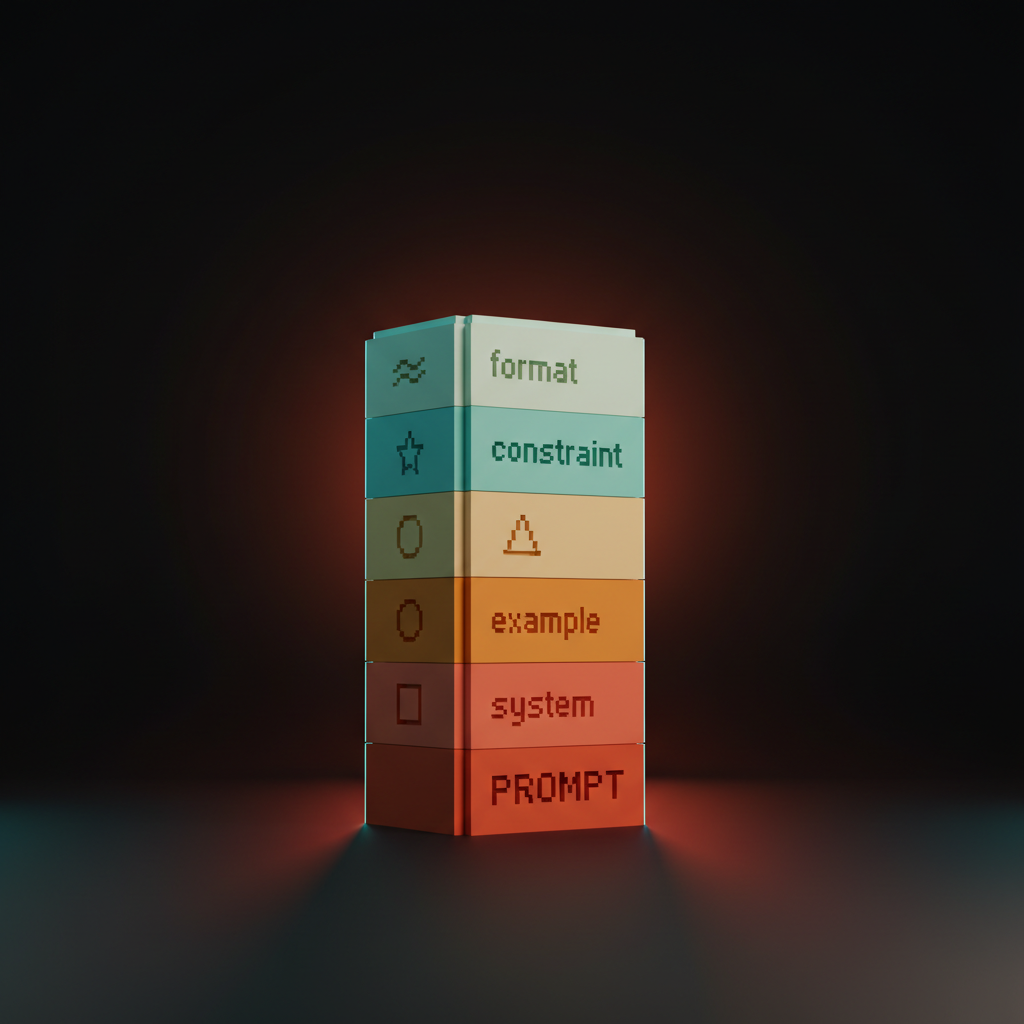

Die fünfteilige Struktur einer Produktionseingabeaufforderung

Jede Eingabeaufforderung, die eine Modellaktualisierung übersteht, besteht aus denselben fünf Teilen. System, Umfang, Beispiele, Einschränkungen, Ausgabeformat. Fehlt einer dieser Punkte, ist die Eingabeaufforderung unbrauchbar.

Ohne Systemrolle driftet die Eingabeaufforderung ab, wenn sich der Standardton des Modells ändert. Ohne Umfang beantwortet die Eingabeaufforderung Fragen, die nie relevant waren. Ohne Beispiele wird die Spezifikation im vierten Fall falsch angewendet. Ohne Einschränkungen erfindet sie etwas, was sie nicht ableiten kann. Ohne Ausgabeformat funktioniert die Eingabeaufforderung bei allen nachgelagerten Nutzern nicht. Fünf Teile, immer in der richtigen Reihenfolge.

System definiert die Rolle, Umfang definiert die Grenzen

Die Systemeingabeaufforderung benennt das Modell. Der Umfang definiert, was die Eingabeaufforderung bearbeiten darf. Fehlt einer dieser Punkte, driftet die Eingabeaufforderung in die falsche Richtung und erledigt die falsche Aufgabe mit Überzeugung.

Ein funktionierender Systemblock besteht aus ein oder zwei Sätzen. „Sie sind ein Senior Brand Designer und überprüfen einen Homepage-Hero anhand der Markenrichtlinien.“ Nicht: „Sie sind ein hilfsbereiter Assistent.“ Spezifische Rolle, spezifische Seniorität, spezifischer Rahmen. Das Modell konzentriert sich auf die Rolle, und der Rest der Eingabeaufforderung wird kürzer.

Der Umfang definiert die Grenzen. „Bewerten Sie nur den Haupttext. Kommentieren Sie weder Layout, Farbe noch Bildmaterial. Schlagen Sie keine Alternativen vor.“ Der definierte Umfang verhindert, dass das Modell vom Thema abweicht. Alle in der Produktion verwendeten Prompts enthalten einen expliziten Umfangsblock. Bei den fehlerhaften Prompts fehlt dieser in der Regel.

Beispiele lehren mehr als Anweisungen

Wenige Beispiele haben pro Token mehr Gewicht als jede Anweisung. Die Prompts, die auch bei Modellwechseln funktionieren, enthalten drei bis fünf reale Beispiele im Text.

Sagen Sie dem Modell: „Schreiben Sie prägnant, mit dem ersten Satz, ohne Füllwörter“, und es versucht es. Zeigen Sie drei Vorher-Nachher-Paare, und es verinnerlicht es. Die Anweisung ist ein Vorschlag. Das Beispiel ist eine Spezifikation.

Verwenden Sie reale, nicht erfundene Beispiele. Nehmen Sie drei Ausgaben, die das Team im letzten Quartal genehmigt hat, und drei, die es abgelehnt hat, und stellen Sie sie einander gegenüber. Das Modell lernt die Marke, indem es sie liest.

Einschränkungen und Ausgabeformat machen Prompts maschinenlesbar

Einschränkungen verhindern Fehler, die das Modell Ihnen sonst mit Sicherheit präsentieren würde. Ein striktes Ausgabeformat verwandelt die Eingabeaufforderung in eine API, der die Pipeline vertrauen kann.

Constraint-Blöcke lesen sich wie eine Checkliste. „Verwende niemals Gedankenstriche. Beginne niemals mit dem Wort ‚Stell dir vor‘. Schlage niemals Texte vor, die länger als neun Wörter sind. Erfinde niemals Produktfunktionen, die nicht im Briefing enthalten sind.“ Jede Zeile ist eine Regel, die das Modell andernfalls verletzen würde – und deren Bereinigung eine Stunde kostet. Die Tokens lohnen sich jedes Mal.

Das Ausgabeformat ist der Unterschied zwischen Fließtext und strukturierten Daten, die eval stack auswerten kann. JSON mit einem festen Schema, Markdown mit einer festen Überschriftenreihenfolge, YAML mit benannten Feldern. Wähle eines aus, dokumentiere es, und nachgelagerte Tools müssen nicht mehr raten.

Versionierung von Eingabeaufforderungen – so wie du Komponenten versionierst

Eine Eingabeaufforderung, die niemand versioniert, ist eine Eingabeaufforderung, die niemandem gehört, und die erste Modellaktualisierung verändert stillschweigend die Mindestqualitätsstandards des Teams.

Jede Eingabeaufforderung in der Bibliothek befindet sich in einem Git-Repository mit einer Commit-Nachricht, die die Änderung benennt. Semver funktioniert. Patch für Korrekturen im Text. Kleinere Änderung für neue Beispiele oder eine verschärfte Einschränkung. Größere Änderung für ein geändertes Ausgabeformat oder eine geänderte Systemrolle. Das Team, das Version 1.4.2 seiner Marken-Audit-Prompts veröffentlicht, weiß, wann und warum die Bewertungskriterien angepasst wurden.

Die strengere Regel lautet: Prompt-Bewertungen bei jeder Änderung. Die neue Version wird mit denselben fünfzig Testfällen wie die alte Version getestet, anhand der Marken-Bewertungskriterien von einem LLM als Juror bewertet und nur dann zusammengeführt, wenn die neue Version eine höhere oder gleiche Punktzahl erreicht. Anthropic Workbench unterstützt dies nativ. OpenAI Prompt-Management ebenfalls. Der benutzerdefinierte Pfad ist ein Claude API-Aufruf, der in ein Skript eingebettet und in der CI ausgeführt wird. Ein Prompt ohne Bewertungen ist ein Prompt, der auf gut Glück läuft.

Über- und untergeordnete Prompts zusammensetzen

Prompts sind wie Komponenten verschachtelt. Ein übergeordneter Prompt legt den Kontext fest. Untergeordnete Prompts bearbeiten eine einzelne Teilaufgabe.

Ein Marken-Audit ist ein übergeordneter Prompt. Innerhalb dieser Struktur sind Hero-Copy-Kritik, CTA-Überprüfung und Navigations-Scan untergeordnete Elemente. Das übergeordnete Element lädt das Markenprofil und die Bewertungskriterien. Die untergeordneten Elemente übernehmen den Kontext und führen ihre spezifische Bewertung durch. Jedes untergeordnete Element ist unabhängig versioniert und auswertbar. Der Benutzer ruft ausschließlich das übergeordnete Element auf.

Eine Seitenvorlage ist ein übergeordnetes Element. Schaltflächen, Karten und Navigationselemente darin sind untergeordnete Elemente. Niemand erstellt die gesamte Seite jedes Mal von Grund auf neu. Die Komposition macht die Bibliothek zu mehr als nur einer Dateiliste. Vermeiden Sie es, ein einziges, riesiges Element zu erstellen, das alles kann. Erstellen Sie stattdessen ein übergeordnetes Element, das den Kontext lädt, und untergeordnete Elemente, die jeweils eine Aufgabe optimal erfüllen.

Varianten für Elemente, wie sie beispielsweise Figma für Schaltflächen verwendet

Schaltflächen haben Varianten hinsichtlich Größe, Status und Rolle. Dieselbe Form gilt für Elemente, sobald ein Team sie auf mehreren Oberflächen bereitstellt.

Größenvarianten sind kurze und lange Versionen desselben Elements. Die Kurzversion wird in der IDE für eine schnelle Überprüfung ausgeführt. Die Langversion durchläuft die Evaluierungspipeline mit vollständiger Rubrik und strukturierter Ausgabe. Gleiche Aufgabenstellung, zwei Längen.

Statusvarianten sind Aufgabenstellungen, die für unterschiedliche Startbedingungen konfiguriert sind. Eine Markenprüfungsaufgabe hat eine weniger strenge „Erstdurchlauf“-Variante und eine strengere „Lieferprüfung“-Variante. Gleiche Logik, unterschiedlicher Schwellenwert.

Rollenvarianten tauschen die Systemstruktur. Eine Textprüfungsaufgabe hat eine „Prüfer“-Rolle für die Qualitätssicherung und eine „Autor“-Rolle für die Texterstellung. Textkörper, Rubrik und Beispiele bleiben gleich. Der Rollentausch verwandelt die Aufgabenstellung in ein anderes Werkzeug mit derselben Funktionalität.

Eine Arbeitsbibliothek stellt eine Variantenmatrix wie Figma bereit. Drei Zeilen, drei Spalten, neun Aufgabenstellungen mit gemeinsamer Struktur. Das Team lernt die Struktur einmalig, wählt die Variante aus und liefert sie aus. Neue Oberfläche, Spalte hinzufügen.

Aufgabenstellungen als Fähigkeiten, Pakete und Teambibliotheken verteilen

Eine Aufgabenstellung, die sich in den Notizen eines Designers befindet, ist ein privates Asset. Um es in ein Team-Asset zu verwandeln, wird eine Verteilungsoberfläche benötigt, die vom restlichen Team installiert werden kann.

Fünf Oberflächen sind ab 2026 verfügbar. Claude Fähigkeiten liefert Ordner, die das Modell bei Bedarf laden – das stärkste Muster für Designteams auf Claude. Anthropic Workbench liefert gehostete Eingabeaufforderungen mit integrierter Versionsverwaltung und Evaluierungsfunktionen. Cursor .cursorrules liefert Eingabeaufforderungen als Datei im Repository, die von der IDE jedes Teammitglieds automatisch erkannt wird. Continue.dev bietet ein ähnliches Muster wie .continuerc.json für Teams im Open-Source-Bereich. OpenAI Prompt-Management liefert gehostete Eingabeaufforderungen für Teams auf GPT.

Wählen Sie die Oberfläche, die zum Stack Ihres Teams passt, und standardisieren Sie. Ein Fehler besteht darin, vier Oberflächen parallel mit unterschiedlichen Versionen derselben Eingabeaufforderung zu betreiben. Die Bibliothek funktioniert nur dann optimal, wenn die Oberfläche einheitlich, benannt und einem Team zugeordnet ist.

Ein Prompt-Paket ist die nächste Ebene: ein Bündel zusammengehöriger Prompts, das zusammen mit einer Versionsrichtlinie und einem Installationspfad ausgeliefert wird. Brainy liefert ClaudeBrainy als Paket mit Design-Skills, einer dokumentierten Variantenmatrix und einer Evaluierungssuite. Das Team, das das Paket installiert, erhält die Rubrik, die Prompts, die Varianten und die Evaluierungen als Einheit.

Wenn Sie Hilfe beim Aufbau einer Prompt-Bibliothek benötigen, klicken Sie auf Brainy einstellen. ClaudeBrainy liefert Skill-Pakete und Vorlagen für Prompt-Bibliotheken mit Versionierung und Evaluierungen. BrandBrainy liefert die Markensysteme für die KI-Generation, anhand derer jeder Prompt bewertet wird.

Die neue Rolle: Prompt-Bibliothekar und Evaluierungsverantwortlicher

Wenn sich Prompts wie Komponenten verhalten, ist jemand für die Bibliothek verantwortlich. Die Rolle, die sich 2026 herausbildet, ähnelt der eines Prompt-Bibliothekars, der auch die Evaluierungssuite verwaltet.

Der Prompt-Bibliothekar kuratiert die Bibliothek. Sie prüfen Pull Requests im Prompt-Repository, führen Evaluierungen durch, mergen oder lehnen sie ab, schreiben das Changelog und entfernen veraltete Prompts. Sie leisten für Prompts das, was Designsystem-Maintainer für Komponenten tun. Weniger glamourös als die Veröffentlichung neuer Funktionen, aber wirkungsvoller als alles andere im Team.

Der Evaluierungsverantwortliche ist dem Bibliothekar zugeordnet oder arbeitet in dessen Rolle. Er definiert Rubriken, optimiert Schwellenwerte, prüft vierteljährlich Abweichungen und speist Konvertierungsdaten gemäß Designer-Evaluierungsstapel in die Rubriken ein. Ohne den Evaluierungsverantwortlichen ist die Bibliothek ein unübersichtliches Sammelsurium an Prompts, denen niemand mehr vertraut.

Die Hierarchie ändert sich. Junior-Designer erstellen Prompts und verwalten die Warteschlange. Designer mit mittlerer Erfahrung veröffentlichen Varianten und optimieren Rubriken. Senior-Designer sind für die Struktur und die Evaluierungsrichtlinien verantwortlich. Lead-Designer gewährleisten den reibungslosen Ablauf zwischen Konvertierungsdaten und Bibliotheksaktualisierungen. Aus „Hast du ein Auge dafür?“ wird „Hast du ein Auge dafür und kannst du es kodieren?“

Die warnende Geschichte: Eingabeaufforderungen als Wegwerftexte

Die meisten Teams behandeln Eingabeaufforderungen wie Wegwerftexte. Sie beobachten, wie sie mit dem ersten Update des zugrundeliegenden Modells an Qualität verlieren. Die Folgen zeigen sich in der Qualität der ausgelieferten Produkte.

Das Muster ist immer dasselbe: Ein Designer verfasst im Februar eine hervorragende Eingabeaufforderung. Die Ergebnisse sind präzise. Das Team kopiert sie in Notion, Slack und private Cursor-Konfigurationen. Bis Juli existieren acht Versionen der Eingabeaufforderung an fünf verschiedenen Stellen, alle leicht unterschiedlich, keine davon ist einem Team zugeordnet. Im August wird das Modell aktualisiert. Vier Versionen verschlechtern sich unbemerkt. Das Team bemerkt einen Qualitätsverlust, kann die Ursache aber nicht finden, da keine Version als kanonisch und keine als Evaluierungsversion festgelegt ist.

Dies ist der häufigste Fehler bei KI-gestütztem Design im Jahr 2026. Nicht schlechte Eingabeaufforderungen. Verlorene Eingabeaufforderungen. Versionslose Eingabeaufforderungen. Die Lösung liegt nicht in besserem Programmieren, sondern in der ordnungsgemäßen Verwaltung der Bibliotheken. Behandeln Sie jede Eingabeaufforderung als Komponente, sobald sie ein zweites Mal verwendet wird, und Sie vermeiden unnötigen Datenverlust.

Teams, die dies 2024 verinnerlicht haben, führen doppelt so viele KI-gestützte Briefings mit halb so viel Aufwand durch. Teams, die dies nicht getan haben, überprüfen jeden Montag dieselben acht Eingabeaufforderungen und fragen sich, warum die Ergebnisse immer schlechter werden.

FAQ

Was ist eine Eingabeaufforderungskomponente?

Eine Eingabeaufforderungskomponente ist eine wiederverwendbare, versionierte und bereichsbezogene Anweisungseinheit, die nach demselben Prinzip wie eine UI-Komponente bereitgestellt wird. Sie verfügt über eine Struktur (System, Bereich, Beispiele, Einschränkungen, Ausgabeformat), Varianten (Größe, Status, Rolle), Versionierung, Evaluierungen und eine dokumentierte Verteilungsschnittstelle. Teams behandeln sie als Ressource, nicht als Zeichenkette.

Worin unterscheidet sich eine Eingabeaufforderungskomponente von einer Claude-Fähigkeit?

Eine Claude-Fähigkeit ist eine der leistungsstärksten Verteilungsschnittstellen für Eingabeaufforderungskomponenten im Anthropic-Stack. Die Komponente ist das Entwurfsmuster. Der Skill ist das Paketformat und das Triggersystem. Ein Team kann dieselbe Prompt-Komponente als Skill auf Claude, als .cursorrules-Block in Cursor, als gehosteten Prompt in der OpenAI-Promptverwaltung oder in allen drei Fällen ausliefern.

Wie versioniert man einen Prompt?

Genauso wie eine Komponente. Git-Repository, Semver, Commit-Nachrichten, die die Änderung erläutern, und eine Prompt-Evaluierungssuite, die jede Änderung anhand der vorherigen Version mit einem festen Testset vergleicht. Patch für Korrekturen am Text, Minor für neue Beispiele oder eine verschärfte Einschränkung, Major für ein geändertes Ausgabeformat oder eine geänderte Rolle.

Was passiert, wenn Prompts als Wegwerftexte behandelt werden?

Sie veralten. Sie verändern sich zwischen Kopien. Sie verschlechtern sich stillschweigend bei Modellaktualisierungen. Das Team bemerkt einen Qualitätsverlust bei der Ausgabe, kann ihn aber nicht nachvollziehen, da keine Version kanonisch ist und keine Version eine Evaluierung hat. Die Lösung liegt in der Bibliothekspflege, nicht im besseren Schreiben.

Wer ist im Designteam für die Prompt-Bibliothek zuständig?

Ein Prompt-Bibliothekar. Diese Rolle ist mit der Evaluierungsverantwortung verknüpft. Er pflegt die Bibliothek, führt die Evaluierungen bei jeder Änderung durch, verfasst das Änderungsprotokoll, entfernt veraltete Prompts und speist die Konversionsdaten in die Bewertungsraster ein. Die Hierarchie wird sich 2026 um diese Rolle herum neu strukturieren.

Prompt-Bibliothek diese Woche einrichten

Drei Schritte. Keine Plattform erforderlich.

Erstens: Benennen Sie die Basis. Wählen Sie die fünf am häufigsten verwendeten Prompts aus. Schreiben Sie jeden Prompt anhand der fünfteiligen Struktur neu. Laden Sie sie mit einer README-Datei und einem Versions-Tag in ein Git-Repository hoch. Freitag.

Zweitens: Stellen Sie die Evaluierungssuite bereit. Laden Sie zwanzig genehmigte und zwanzig abgelehnte Ergebnisse herunter. Fassen Sie diese als Testset zusammen. Erstellen Sie ein Bewertungsraster Claude. Führen Sie es mit der Basis durch. Optimieren Sie anhand der Fehler.

Drittens: Wählen Sie die Verteilungsoberfläche. Claude Skills, Cursor .cursorrules, Anthropic Workbench, Continue.dev oder OpenAI Prompt-Management. Eine Oberfläche. Standardisieren.

Wenn Sie Hilfe beim Einbinden der Prompt-Bibliothek in Ihre Arbeitsabläufe benötigen, Brainy einstellen. ClaudeBrainy liefert Skill-Pakete, Vorlagen für die Prompt-Bibliothek und die Variantenmatrix als Starterbibliothek. BrandBrainy liefert das Marken-Betriebssystem, anhand dessen jeder Prompt bewertet wird. Die nächste Generation der Designqualität ist in die Prompt-Bibliothek integriert und wird nicht jeden Montag neu eingegeben. Die Teams, die die Bibliothek zuerst erstellen, werden die Oberfläche bedienen, die zuvor von drei Teams abgedeckt wurde.

If you want help standing up a prompt library on your design team, ClaudeBrainy ships Skill packs and prompt-library templates with versioning and evals built in, and BrandBrainy ships the brand operating system every prompt in the library scores against.

Get Started