上下文窗口解释:为什么长时间的AI聊天会变差

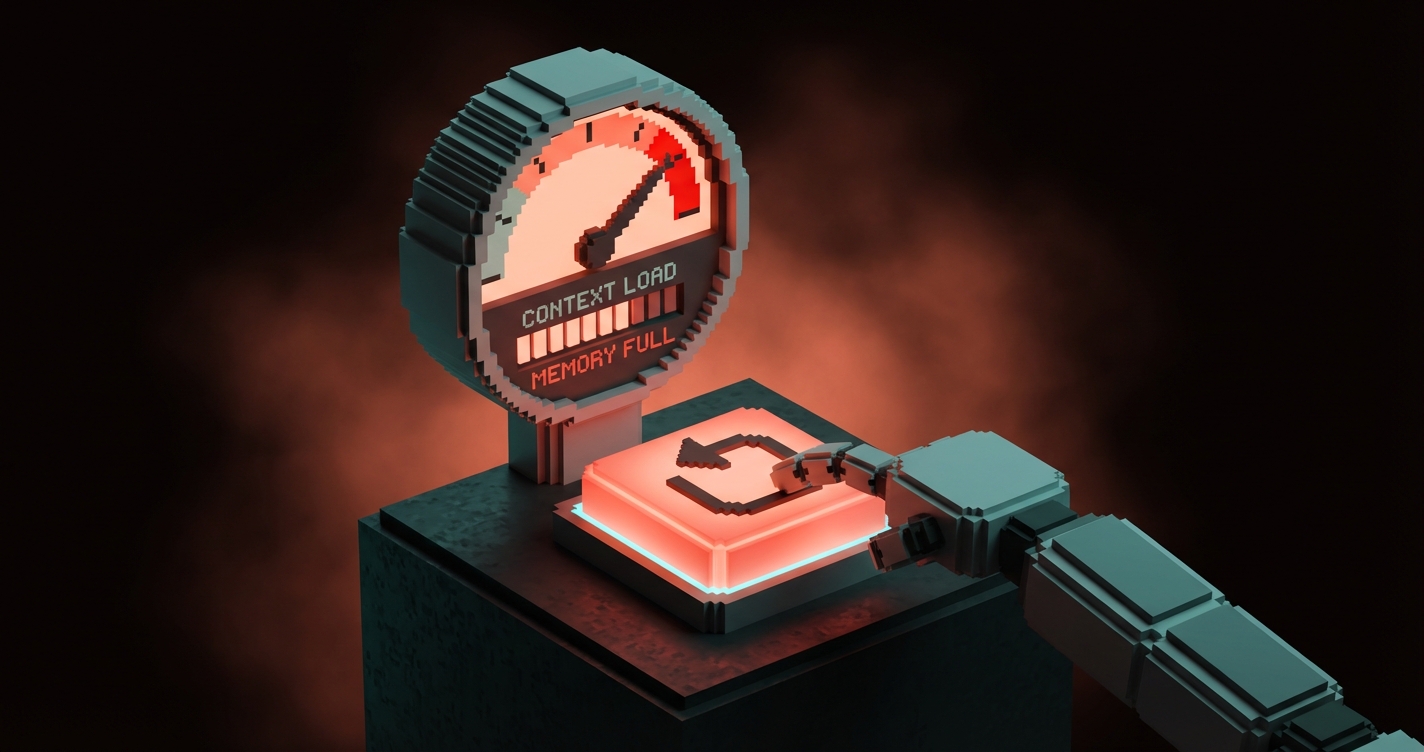

了解什么是上下文窗口,为什么长时间的AI聊天会变得更慢、更不可靠,以及何时在“令牌拖累”毁掉工作之前重置对话。

你的AI并没有突然变笨,而是你的聊天变得臃肿了。

这是大多数人忽略的部分。他们责怪模型、提供商、提示词、月相,任何听起来足够戏剧化,足以解释为什么输出变得更慢、更草率的原因。

很多时候,问题其实更简单。会话中塞满了太多旧包袱、太多无用的分支,以及模型必须不断向前拖拽的过多上下文。

上下文窗口是工作记忆

上下文窗口是模型在生成响应时可以主动使用的对话、指令、文件和其他输入的总量。把它想象成工作记忆,而不是长期记忆。

这种区别很重要。一个大的上下文窗口意味着模型现在可以查看更多的内容。但这并不意味着模型拥有永久记忆、完美回忆或无限耐心。

令牌(Tokens)是这一切背后的真正单位。你的消息、模型之前的回复、粘贴的文档、工具输出和系统指令都会消耗令牌。堆积的越多,模型在再次回答之前需要重新阅读的内容就越多。

一个误解是,更大的上下文窗口能解决所有问题。它显然有帮助。但一个百万令牌的窗口并不能神奇地将一个混乱的会话变成一个整洁的会话。如果你不断往地板上扔垃圾,再大的房间也会变得脏乱。

| 输入类型 | 是否计入上下文? | 重要性 |

|---|---|---|

| 用户消息 | 是 | 每轮新对话都会增加堆积量 |

| 模型回复 | 是 | 长的助手回复会在下一轮中被带回 |

| 文件和粘贴文档 | 是 | 深度好,但过大时很残酷 |

| 工具输出 | 是 | 最快使工作会话臃肿的方式 |

| 隐藏系统指令 | 是 | 模型也会携带这些指令 |

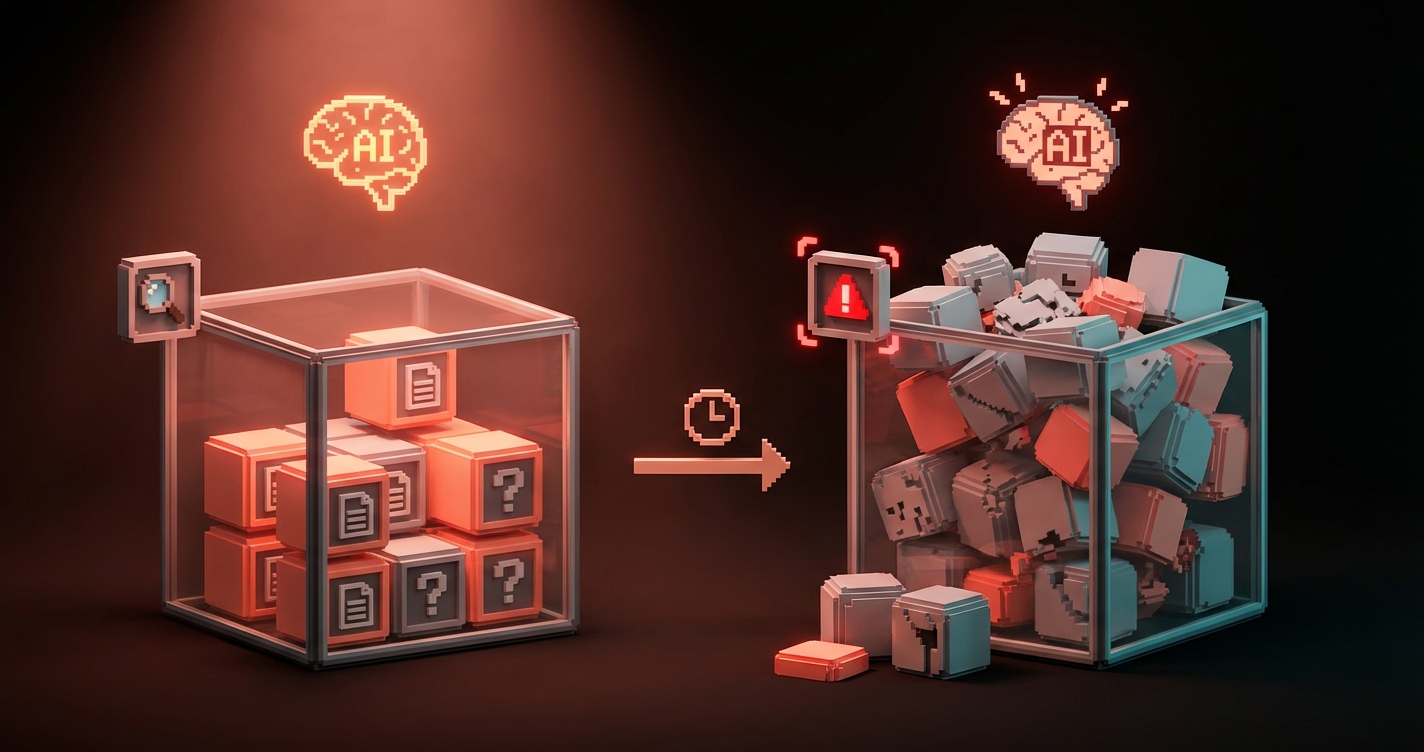

长时间聊天每轮成本更高

随着会话的增长,模型会不断重新处理更多的旧材料。这会增加令牌使用量、延迟和成本,即使你最新的问题很短。

这就是为什么长时间的聊天会随着时间推移而感觉越来越沉重。你问了一个小的后续问题,但模型不仅在阅读这个后续问题。它还在像搬沙发上楼梯一样,拖着整个对话历史。

大量使用工具的会话增长得更快。一些代码差异、日志、JSON数据块、截图和冗长的解释可以迅速膨胀工作集,让正常的聊天感觉像湿水泥一样沉重。

隐蔽之处在于,这种拖累是复合的。每一个长回复都会为下一个回复增加更多材料,而下一个回复又会为再下一个回复增加更多材料。这就是为什么一个一小时前还感觉很干净的会话,现在开始像个老烟枪一样喘息。

| 会话类型 | 发生情况 | 典型结果 |

|---|---|---|

| 短而专注 | 令牌重复使用率低 | 回答快速、精准 |

| 长但有纪律 | 令牌重复使用率适中 | 如果主题保持紧密,仍可用 |

| 长而混乱 | 令牌重复使用率高且噪音多 | 输出缓慢、昂贵、健忘 |

质量在硬性限制之前下降

真正的失败模式通常是软性退化,而不是戏剧性的崩溃。人们想象模型会完美运行,直到撞到一堵硬墙,然后爆炸。可爱的幻想。现实更残酷。

大多数时候,质量在窗口技术上完全填满之前就开始下滑。模型变得更慢。它开始重复自己。它会错过新的约束。它会像一个僵尸产品经理一样复活那些已经废弃的分支,仍然想要三小时前的功能想法。

这种软性退化才是真正伤害工作的地方。硬性失败是显而易见的。软性失败则浪费时间,因为它看起来几乎是正确的。

留意这些警告信号:

- 它不断忘记最新的指令,转而遵循旧的指令

- 它回答的词语更多,但精确度更低

- 它重新开启你已经拒绝的路径

- 即使新提示很简单,它也变得更慢

- 当对话曾经感觉很具体时,它变得泛泛而谈

这不总是模型本身的弱点。有时是上下文腐烂。

混乱的上下文比大的上下文更糟糕

一个专注的60%会话通常比一个混乱的30%会话更健康。大小很重要,但相关性更重要。

如果每一轮仍然围绕着相同的交付物、相同的文件、相同的约束和相同的决策路径,那么长时间的会话仍然可以保持有用。模型正在一个连贯的工作空间中工作。

但是,如果你将三个项目、六个废弃的想法、随机研究、图像提示、战略笔记和一个不相关的存在主义危机混入同一个线程中,那么你就是自己毒害了这口井。恭喜你。你建造了一个杂物抽屉,却期望从中取出手术工具。

话题切换是这里的杀手。即使你精神上已经转移了,模型也必须保持旧分支的可用性。这意味着陈旧的上下文会与活跃的上下文竞争。

每个工作流一个会话之所以有效,是因为它降低了分支债务。模型看到一个活跃的问题、一条路径、一组约束。它能保持敏锐,因为你不再要求它成为一个“通灵的清洁工”。

使用这些上下文百分比阈值

大多数人不需要完美的遥测数据。他们需要一个简单的规则来判断何时继续、何时压缩以及何时重置。

将其用作实用的阈值表:

| 上下文使用率 | 区域 | 通常感受 | 应对措施 |

|---|---|---|---|

| 0% 到 40% | 绿色区域 | 快速、清晰、响应迅速 | 继续 |

| 40% 到 60% | 健康区域 | 依然强劲,但留意跑题 | 专注于一项任务 |

| 60% 到 75% | 警告区域 | 拖累感增加,旧包袱增多 | 总结并精简 |

| 75% 到 85% | 拖拽区域 | 变慢、模糊、重复增多 | 如果质量重要,请重置 |

| 85% 以上 | 红色区域 | 昂贵且不可靠 | 立即压缩或重新开始 |

不要把这些数字当作神圣的经文。不同的模型退化方式不同。不同的任务退化方式也不同。写作会话可能比调试或技术规划更能容忍跑题。

重点是原则:一旦上下文拖累的成本高于重新简报,就重置。

快速经验法则:

- 当任务仍然连贯时,继续进行

- 当线程仍然有用但开始臃肿时,进行压缩

- 当模型花费更多精力承载历史而不是解决下一步问题时,进行重置

更早开始新的聊天

如果你的真实记忆存在于聊天之外,那么开始一个新的聊天并不会失去连续性。这是使用AI的“成人版”方式。

在以下情况下保留当前会话:

- 你仍在处理一个交付物

- 最近的对话都仍然相关

- 模型清晰地遵循最新的约束

- 线程的帮助大于其拖累

在以下情况下立即重置:

- 你切换项目

- 你改变了实际目标

- 线程有多个废弃的分支

- 模型不断错过你已经给出的指令

- 答案感觉比工作应有的更慢、更模糊

一次干净的重置通常比在同一个臃肿的会话中编写第五个纠正性提示更快地提高质量。停止尝试修复一个“死掉”的线程。开启一个新的,只带入仍然重要的内容。

如果你想要更多像这样的系统和工作流分解,请浏览 Brainy Papers 的其他文章。如果你希望为你的团队量身定制完整的解决方案,请 聘请 Brainy。

构建系统,而非不朽的聊天

最佳的AI工作流将持久性知识存储在对话之外。会话应该是战术性的。记忆应该是结构性的。

这意味着计划、笔记、简报、清单、文档和可重用的提示资产。如果你的重要上下文只存在于一个巨大的线程中,那么你并没有构建一个工作流。你制造了一个“人质危机”。

外部记忆让你能够干净地重新开始,而不会丢失实际工作。它还使协作更容易、交接更清晰、错误更容易被发现,因为重要内容在聊天气泡之外是可见的。

这也是大多数团队在使用AI时犯错的地方。他们追求更大的窗口,而不是更好的系统。更大的窗口是有用的。更好的系统是复合增长的。

一句可引用的版本:

一个巨大的上下文窗口只是一个更大的背包,而不是一个更好的文件柜。

常见问题

AI中的上下文窗口是什么?

上下文窗口是AI模型在生成响应时可以主动使用的文本和输入的总量。这包括你最新的提示、之前的对话轮次、文件、工具输出和隐藏的系统指令。

为什么长时间的AI聊天会变差?

长时间的聊天会变差,因为模型会不断重新处理更多的旧材料,包括不相关的材料。这会增加成本和延迟,并且在达到硬性上下文限制之前很久就可能降低精确度。

更大的上下文窗口能解决问题吗?

它有帮助,但不能完全解决问题。更大的窗口提供了更多空间,但混乱的会话仍然会退化,因为相关性和分支质量与原始大小同样重要。

我应该多久开始一次新的AI聊天?

当连续性变得比重新简报更昂贵时,就应该开始一个新的聊天。实际上,这通常意味着在项目切换、主要目标改变之后,或者一旦线程开始出现明显的拖累和混乱时。

开始新会话对连续性有害吗?

只有当你的连续性仅存在于线程内部时,才会如此。如果你的真实记忆存在于文件、笔记、简报和结构化文档中,那么一个新的会话通常可以通过消除陈旧的噪音来改善连续性。

将会话视为工作空间

保持系统持久,而不是聊天。

这就是诀窍。将会话用作一次性工作空间。将持久的真相保存在结构化的位置。只将正确的上下文带入下一个线程。这样,模型就能保持更快、更清晰、更有用。

如果你一直将一个巨大的聊天视为一个不朽的大脑,它最终会变成一锅粥。美味吗?不。高效吗?也不。

构建系统。重置工作空间。继续前进。

Need an AI workflow that stays sharp under real work? Build the system, not the chaos.

Get Started