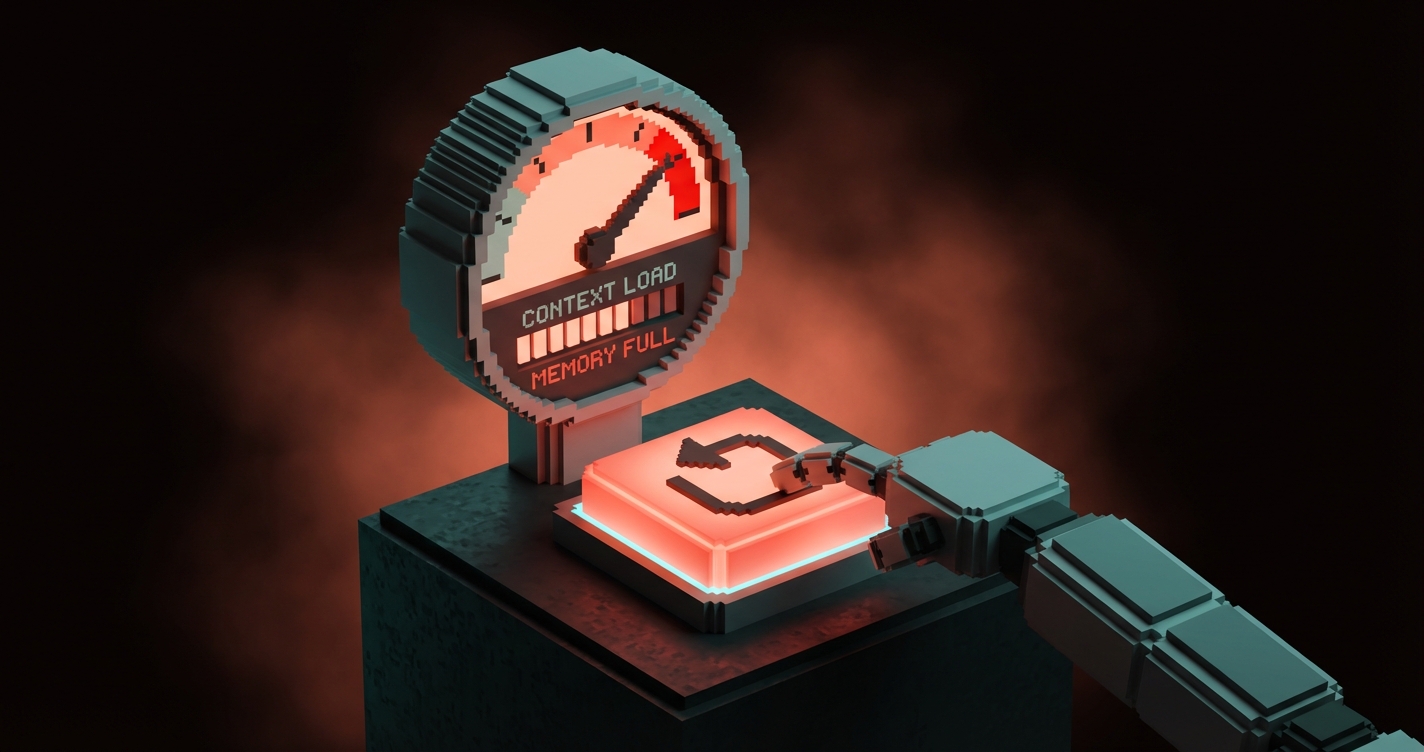

Janela de Contexto Explicada: Por Que Chats Longos com IA Pioram

Entenda o que é uma janela de contexto, por que chats longos com IA ficam mais lentos e menos confiáveis, e quando reiniciar antes que o arrasto de tokens estrague o trabalho.

Sua IA não ficou burra de repente. Seu chat ficou inchado.

Essa é a parte que a maioria das pessoas não percebe. Elas culpam o modelo, o provedor, o prompt, a fase da lua, qualquer coisa que pareça dramática o suficiente para explicar por que a saída ficou mais lenta e desleixada.

Muitas vezes, o problema é mais simples. A sessão ficou cheia de muita bagagem antiga, muitos ramos mortos e muito contexto que o modelo precisa continuar arrastando.

Janela de contexto é memória de trabalho

Uma janela de contexto é a quantidade de conversa, instruções, arquivos e outras entradas que o modelo pode usar ativamente em uma resposta. Pense nela como memória de trabalho, não memória de longo prazo.

Essa distinção importa. Uma janela de contexto grande significa que o modelo pode analisar mais coisas agora. Não significa que o modelo tenha memória permanente, lembrança perfeita ou paciência infinita.

Tokens são a unidade real por trás de tudo isso. Sua mensagem, as respostas anteriores do modelo, documentos colados, saídas de ferramentas e instruções do sistema consomem tokens. Quanto maior a pilha, mais o modelo precisa reler antes de responder novamente.

O mito é que um contexto maior resolve todo o problema. Ajuda, obviamente. Mas uma janela de um milhão de tokens não transforma magicamente uma sessão caótica em uma limpa. Um cômodo maior ainda fica sujo se você continuar jogando lixo no chão.

| Tipo de entrada | Conta para o contexto? | Por que importa |

|---|---|---|

| Mensagens do usuário | Sim | Cada nova interação aumenta a pilha |

| Respostas do modelo | Sim | Respostas longas do assistente retornam para a próxima interação |

| Arquivos e documentos colados | Sim | Ótimo para profundidade, brutal quando superdimensionado |

| Saída de ferramentas | Sim | A maneira mais rápida de inchar uma sessão de trabalho |

| Instruções ocultas do sistema | Sim | O modelo também carrega essas |

Chats longos custam mais a cada interação

À medida que uma sessão cresce, o modelo continua reprocessando mais material antigo. Isso aumenta o uso de tokens, a latência e o custo, mesmo quando sua pergunta mais recente é curta.

É por isso que chats longos geralmente parecem mais pesados com o tempo. Você faz uma pequena pergunta de acompanhamento, mas o modelo não está apenas lendo o acompanhamento. Ele está carregando todo o histórico da conversa como um sofá subindo uma escada.

Sessões com muitas ferramentas crescem ainda mais rápido. Algumas diferenças de código, logs, blobs JSON, capturas de tela e explicações prolixas podem inflar o conjunto de trabalho rápido o suficiente para fazer um chat normal parecer cimento molhado.

A parte traiçoeira é que o arrasto se acumula. Cada resposta longa adiciona mais material para a próxima resposta, que adiciona mais material para a seguinte. É assim que uma sessão que parecia limpa há uma hora começa a respirar como um fumante crônico.

| Tipo de sessão | O que acontece | Resultado típico |

|---|---|---|

| Curta e focada | Baixo reuso de tokens | Respostas rápidas e precisas |

| Longa, mas disciplinada | Reuso moderado de tokens | Ainda utilizável se o tópico permanecer restrito |

| Longa e bagunçada | Alto reuso de tokens mais ruído | Saída lenta, cara e esquecida |

A qualidade cai antes do limite rígido

O modo de falha real é geralmente uma degradação suave, não uma falha dramática. As pessoas imaginam que o modelo funciona perfeitamente até atingir uma parede rígida, e então explode. Fantasia fofa. A realidade é mais cruel.

Na maioria das vezes, a qualidade começa a cair antes que a janela esteja tecnicamente cheia. O modelo fica mais lento. Começa a se repetir. Perde restrições mais recentes. Revive ramos mortos como um gerente de produto zumbi que ainda quer ideias de recursos de três horas atrás.

Essa degradação suave é o que prejudica o trabalho real. A falha grave é óbvia. A falha suave desperdiça tempo porque parece quase certa.

Fique atento a estes sinais de alerta:

- Ele continua esquecendo a instrução mais recente e seguindo uma mais antiga

- Ele responde com mais palavras, mas menos precisão

- Ele reabre caminhos que você já rejeitou

- Ele fica mais lento mesmo quando o novo prompt é simples

- Ele se torna genérico quando a conversa costumava parecer específica

Isso nem sempre é fraqueza do modelo. Às vezes é podridão de contexto.

Contexto bagunçado é pior que contexto grande

Uma sessão focada de 60% é frequentemente mais saudável do que uma sessão caótica de 30%. O tamanho importa, mas a relevância importa mais.

Se cada interação ainda é sobre o mesmo entregável, os mesmos arquivos, as mesmas restrições e o mesmo caminho de decisão, uma sessão longa pode permanecer útil. O modelo está trabalhando com um espaço de trabalho coerente.

Mas se você mistura três projetos, seis ideias abandonadas, pesquisa aleatória, prompts de imagem, notas de estratégia e uma crise existencial não relacionada no mesmo tópico, você envenenou o poço sozinho. Parabéns. Você construiu uma gaveta de lixo e esperava que ferramentas cirúrgicas saíssem dela.

A mudança de tópico é o problema aqui. O modelo precisa manter os ramos antigos disponíveis mesmo quando você mentalmente seguiu em frente. Isso significa que o contexto obsoleto compete com o contexto ativo.

Uma sessão por fluxo de trabalho funciona porque diminui a dívida de ramificação. O modelo vê um problema ativo, um caminho, um conjunto de restrições. Ele pode permanecer afiado porque você parou de pedir para ele ser um zelador psíquico.

Use estes limites percentuais de contexto

A maioria das pessoas não precisa de telemetria perfeita. Elas precisam de uma regra simples para quando continuar, quando comprimir e quando reiniciar.

Use esta como a tabela de limites práticos:

| Uso do contexto | Zona | Como geralmente se sente | O que fazer |

|---|---|---|---|

| 0% a 40% | Zona verde | Rápido, limpo, responsivo | Continue |

| 40% a 60% | Zona saudável | Ainda forte, mas observe o desvio | Mantenha-se em uma tarefa |

| 60% a 75% | Faixa de alerta | Mais arrasto, mais bagagem antiga | Resuma e corte |

| 75% a 85% | Zona de arrasto | Mais lento, mais impreciso, mais repetições | Reinicie se a qualidade for importante |

| Acima de 85% | Zona vermelha | Caro e não confiável | Comprima ou comece do zero agora |

Não trate os números como escritura sagrada. Modelos diferentes degradam de maneiras diferentes. Tarefas diferentes também degradam de maneiras diferentes. Uma sessão de escrita pode tolerar mais desvio do que depuração ou planejamento técnico.

O princípio é o ponto: uma vez que o arrasto de contexto se torna mais caro do que re-briefing, reinicie.

Regra prática rápida:

- Continue quando a tarefa ainda for coerente

- Comprima quando o tópico ainda for útil, mas começar a inchar

- Reinicie quando o modelo estiver gastando mais esforço carregando o histórico do que resolvendo o próximo passo

Comece um novo chat mais cedo

Começar um novo chat não é perder a continuidade se sua memória real vive fora do chat. Essa é a versão adulta de usar IA.

Mantenha a sessão atual quando:

- você ainda está dentro de um entregável

- as interações recentes ainda são todas relevantes

- o modelo está seguindo as restrições mais recentes de forma limpa

- o tópico está ajudando mais do que arrastando

Reinicie imediatamente quando:

- você muda de projeto

- você muda o objetivo real

- o tópico tem múltiplos ramos abandonados

- o modelo continua perdendo instruções que você já deu

- as respostas parecem mais lentas e vagas do que o trabalho merece

Um reinício limpo geralmente melhora a qualidade mais rápido do que escrever um quinto prompt corretivo na mesma sessão inchada. Pare de tentar reabilitar um tópico morto. Abra um novo e traga apenas o que ainda importa.

Se você quiser mais análises de sistemas e fluxos de trabalho como esta, navegue pelo restante dos Brainy Papers. Se você quiser que tudo seja construído corretamente para sua equipe, contrate a Brainy.

Construa sistemas, não chats imortais

Os melhores fluxos de trabalho de IA armazenam conhecimento durável fora da conversa. As sessões devem ser táticas. A memória deve ser estrutural.

Isso significa planos, notas, resumos, listas de verificação, documentos e ativos de prompt reutilizáveis. Se o único lugar onde seu contexto importante existe é dentro de um único tópico gigante, você não construiu um fluxo de trabalho. Você construiu uma situação de refém.

A memória externa oferece reinícios limpos sem perder o fio do trabalho real. Também facilita a colaboração, torna as transferências mais limpas e os erros mais fáceis de detectar porque o material importante é visível fora da bolha do chat.

É também aqui que a maioria das equipes erra com a IA. Elas buscam janelas maiores em vez de sistemas melhores. Janelas maiores são úteis. Sistemas melhores são cumulativos.

Uma versão para citar:

Uma janela de contexto gigante é uma mochila maior. Não é um arquivo melhor.

Perguntas Frequentes

O que é uma janela de contexto em IA?

Uma janela de contexto é a quantidade de texto e entrada que um modelo de IA pode usar ativamente em uma resposta. Isso inclui seu prompt mais recente, interações anteriores, arquivos, saída de ferramentas e instruções ocultas do sistema.

Por que chats longos com IA pioram?

Chats longos pioram porque o modelo continua reprocessando mais material antigo, incluindo material irrelevante. Isso aumenta o custo e a latência, e pode reduzir a precisão muito antes que o limite rígido de contexto seja atingido.

Uma janela de contexto maior resolve o problema?

Ajuda, mas não elimina o problema. Janelas maiores oferecem mais espaço, mas sessões bagunçadas ainda se degradam porque a relevância e a qualidade dos ramos importam tanto quanto o tamanho bruto.

Com que frequência devo iniciar um novo chat de IA?

Inicie um novo chat sempre que a continuidade se tornar mais cara do que re-briefing. Na prática, isso geralmente significa após uma mudança de projeto, uma grande mudança de objetivo, ou quando o tópico começa a mostrar arrasto e confusão óbvios.

Iniciar uma nova sessão é ruim para a continuidade?

Apenas se sua continuidade viver apenas dentro do tópico. Se sua memória real estiver em arquivos, notas, resumos e documentos estruturados, uma nova sessão geralmente melhora a continuidade removendo o ruído obsoleto.

Trate as sessões como espaços de trabalho

Mantenha o sistema persistente, não o chat.

Esse é o jogo. Use as sessões como espaços de trabalho descartáveis. Mantenha a verdade durável em locais estruturados. Traga apenas o contexto certo para o próximo tópico. Assim, o modelo permanece mais rápido, mais limpo e mais útil.

Se você continuar tratando um chat gigante como um cérebro imortal, ele eventualmente se transformará em sopa. Saboroso? Não. Eficiente? Também não.

Construa o sistema. Reinicie o espaço de trabalho. Siga em frente.

Need an AI workflow that stays sharp under real work? Build the system, not the chaos.

Get Started