Fenêtre de contexte expliquée : pourquoi les longues conversations IA se dégradent

Découvrez ce qu'est une fenêtre de contexte, pourquoi les longues conversations IA deviennent plus lentes et moins fiables, et quand réinitialiser avant que l'encombrement des tokens ne ruine votre travail.

Votre IA n'est pas soudainement devenue stupide. Votre conversation est devenue trop lourde.

C'est la partie que la plupart des gens manquent. Ils blâment le modèle, le fournisseur, l'invite, la phase de la lune, tout ce qui semble suffisamment dramatique pour expliquer pourquoi la sortie est devenue plus lente et plus bâclée.

Souvent, le problème est plus simple. La session s'est remplie de trop de vieux bagages, de trop de branches mortes et de trop de contexte que le modèle doit continuer à traîner.

La fenêtre de contexte est une mémoire de travail

Une fenêtre de contexte est la quantité de conversation, d'instructions, de fichiers et d'autres entrées que le modèle peut utiliser activement pour une réponse. Pensez-y comme à une mémoire de travail, pas à une mémoire à long terme.

Cette distinction est importante. Une grande fenêtre de contexte signifie que le modèle peut examiner plus d'éléments "maintenant". Cela ne signifie pas que le modèle a une mémoire permanente, un rappel parfait ou une patience infinie.

Les "tokens" sont la véritable unité sous-jacente à tout cela. Votre message, les réponses précédentes du modèle, les documents collés, les sorties d'outils et les instructions système consomment tous des tokens. Plus la pile est grande, plus le modèle doit relire avant de répondre à nouveau.

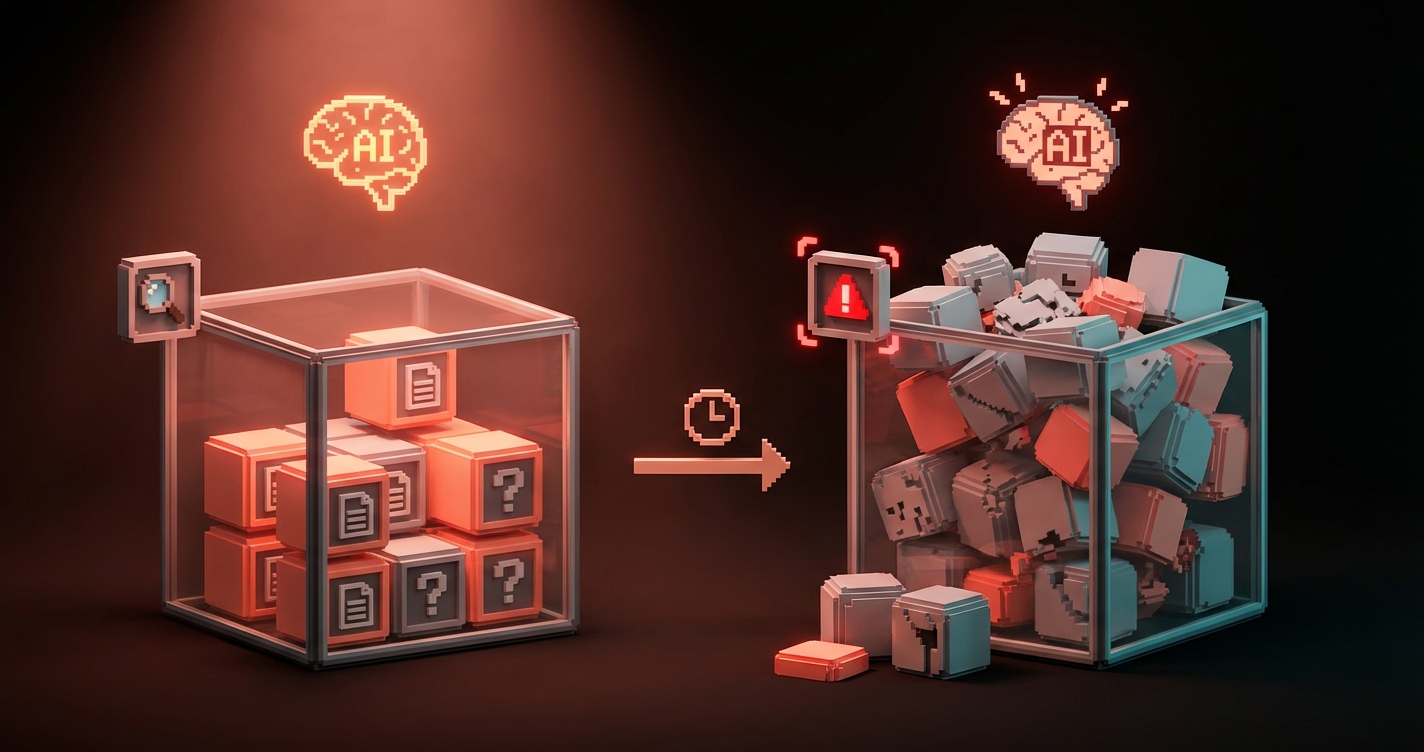

Le mythe est qu'une fenêtre de contexte plus grande résout tout le problème. Cela aide, évidemment. Mais une fenêtre d'un million de tokens ne transforme pas comme par magie une session chaotique en une session propre. Une pièce plus grande devient toujours sale si vous continuez à jeter des déchets par terre.

| Type d'entrée | Compte pour le contexte ? | Pourquoi c'est important | |---| | Messages utilisateur | Oui | Chaque nouvelle intervention augmente la pile | | Réponses du modèle | Oui | Les longues réponses de l'assistant reviennent pour l'intervention suivante | | Fichiers et documents collés | Oui | Idéal pour la profondeur, brutal si surdimensionné | | Sortie d'outil | Oui | Le moyen le plus rapide d'alourdir une session de travail | | Instructions système cachées | Oui | Le modèle les transporte aussi |

Les longues conversations coûtent plus cher à chaque tour

Au fur et à mesure qu'une session se développe, le modèle continue de retraiter plus d'ancien matériel. Cela augmente l'utilisation des tokens, la latence et le coût, même lorsque votre nouvelle question est courte.

C'est pourquoi les longues conversations semblent souvent plus lourdes avec le temps. Vous posez une petite question de suivi, mais le modèle ne lit pas seulement le suivi. Il traîne tout l'historique de la conversation comme un canapé dans un escalier.

Les sessions riches en outils se développent encore plus rapidement. Quelques "diffs" de code, des journaux, des "blobs" JSON, des captures d'écran et des explications verbeuses peuvent gonfler l'ensemble de travail assez rapidement pour qu'une conversation normale ressemble à du ciment mouillé.

La partie insidieuse est que l'encombrement se cumule. Chaque longue réponse ajoute plus de matériel pour la réponse suivante, ce qui ajoute plus de matériel pour celle d'après. C'est ainsi qu'une session qui semblait propre il y a une heure commence à respirer comme un gros fumeur.

| Type de session | Ce qui se passe | Résultat typique | |---| | Courte et ciblée | Faible réutilisation des tokens | Réponses rapides et précises | | Longue mais disciplinée | Réutilisation modérée des tokens | Toujours utilisable si le sujet reste précis | | Longue et désordonnée | Forte réutilisation des tokens et bruit | Sortie lente, coûteuse, oublieuse |

La qualité diminue avant la limite stricte

Le véritable mode de défaillance est généralement une dégradation douce, pas un crash spectaculaire. Les gens imaginent que le modèle fonctionne parfaitement jusqu'à ce qu'il heurte un mur, puis explose. Jolie fantaisie. La réalité est plus dure.

La plupart du temps, la qualité commence à baisser avant que la fenêtre ne soit techniquement pleine. Le modèle ralentit. Il commence à se répéter. Il manque les contraintes plus récentes. Il ravive des branches mortes comme un chef de produit zombie qui veut encore des idées de fonctionnalités d'il y a trois heures.

Cette dégradation douce est ce qui nuit au travail réel. Une défaillance "dure" est évidente. Une défaillance "douce" fait perdre du temps car elle semble presque correcte.

Surveillez ces signes avant-coureurs :

- Il oublie constamment la dernière instruction et suit une ancienne

- Il répond avec plus de mots mais moins de précision

- Il rouvre des chemins que vous avez déjà rejetés

- Il ralentit même lorsque la nouvelle invite est simple

- Il devient générique alors que la conversation était auparavant spécifique

Ce n'est pas toujours une faiblesse du modèle. Parfois, c'est une "pourriture" du contexte.

Un contexte désordonné est pire qu'un grand contexte

Une session ciblée à 60 % est souvent plus saine qu'une session chaotique à 30 %. La taille compte, mais la pertinence compte davantage.

Si chaque tour concerne toujours le même livrable, les mêmes fichiers, les mêmes contraintes et le même chemin de décision, une longue session peut rester utile. Le modèle travaille avec un espace de travail cohérent.

Mais si vous mélangez trois projets, six idées abandonnées, des recherches aléatoires, des invites d'images, des notes de stratégie et une crise existentielle sans rapport dans le même fil, vous avez empoisonné le puits vous-même. Félicitations. Vous avez construit un tiroir-fourre-tout et vous vous attendiez à ce qu'il en sorte des outils chirurgicaux.

Le changement de sujet est le problème ici. Le modèle doit garder les anciennes branches disponibles même lorsque vous êtes mentalement passé à autre chose. Cela signifie que le contexte obsolète est en concurrence avec le contexte "vivant".

Une session par flux de travail fonctionne parce qu'elle réduit la "dette de branche". Le modèle voit un problème actif, un chemin, un ensemble de contraintes. Il peut rester précis parce que vous avez cessé de lui demander d'être un concierge psychique.

Utilisez ces seuils de pourcentage de contexte

La plupart des gens n'ont pas besoin d'une télémétrie parfaite. Ils ont besoin d'une règle simple pour savoir quand continuer, quand compresser et quand réinitialiser.

Utilisez ceci comme tableau de seuils pratiques :

| Utilisation du contexte | Zone | Ce que l'on ressent habituellement | Ce qu'il faut faire | |---| | 0 % à 40 % | Zone verte | Rapide, propre, réactif | Continuez | | 40 % à 60 % | Zone saine | Toujours solide, mais surveillez la dérive | Restez sur une seule tâche | | 60 % à 75 % | Zone d'avertissement | Plus d'encombrement, plus de vieux bagages | Résumez et élaguez | | 75 % à 85 % | Zone de traînée | Plus lent, plus flou, plus de répétitions | Réinitialisez si la qualité est importante | | Au-dessus de 85 % | Zone rouge | Coûteux et peu fiable | Compressez ou recommencez à zéro maintenant |

Ne traitez pas les chiffres comme une sainte écriture. Différents modèles se dégradent différemment. Différentes tâches se dégradent également différemment. Une session d'écriture peut tolérer plus de dérive que le débogage ou la planification technique.

Le principe est le point : une fois que l'encombrement du contexte devient plus coûteux qu'une nouvelle "briefing", réinitialisez.

Règle de base rapide :

- Continuez lorsque la tâche est toujours cohérente

- Compressez lorsque le fil est toujours utile mais commence à s'alourdir

- Réinitialisez lorsque le modèle consacre plus d'efforts à transporter l'historique qu'à résoudre l'étape suivante

Commencez une nouvelle conversation plus tôt

Commencer une nouvelle conversation ne signifie pas perdre la continuité si votre "vraie" mémoire vit en dehors de la conversation. C'est la version adulte de l'utilisation de l'IA.

Gardez la session actuelle lorsque :

- vous êtes toujours dans un seul livrable

- les derniers tours sont toujours pertinents

- le modèle suit proprement les dernières contraintes

- le fil aide plus qu'il ne traîne

Réinitialisez immédiatement lorsque :

- vous changez de projet

- vous changez l'objectif réel

- le fil a plusieurs branches abandonnées

- le modèle manque constamment les instructions que vous avez déjà données

- les réponses semblent plus lentes et plus vagues que le travail ne le mérite

Une réinitialisation propre améliore souvent la qualité plus rapidement que d'écrire une cinquième invite corrective dans la même session alourdie. Arrêtez d'essayer de réhabiliter un fil mort. Ouvrez-en un nouveau et n'apportez que ce qui compte encore.

Si vous souhaitez plus de systèmes et de décompositions de flux de travail comme celui-ci, parcourez le reste des Brainy Papers. Si vous voulez que l'ensemble soit correctement construit pour votre équipe, engagez Brainy.

Construisez des systèmes, pas des conversations immortelles

Les meilleurs flux de travail IA stockent les connaissances durables en dehors de la conversation. Les sessions doivent être tactiques. La mémoire doit être structurelle.

Cela signifie des plans, des notes, des "briefs", des listes de contrôle, des documents et des "assets" d'invite réutilisables. Si le seul endroit où votre contexte important existe est à l'intérieur d'un seul fil géant, vous n'avez pas construit un flux de travail. Vous avez créé une prise d'otages.

La mémoire externe vous permet des redémarrages propres sans perdre le fil du travail réel. Elle facilite également la collaboration, rend les transferts plus clairs et les erreurs plus faciles à détecter car les éléments importants sont visibles en dehors de la bulle de discussion.

C'est aussi là que la plupart des équipes se trompent avec l'IA. Elles courent après de plus grandes fenêtres au lieu de meilleurs systèmes. Les plus grandes fenêtres sont utiles. Les meilleurs systèmes sont cumulatifs.

Une version "citable" :

Une fenêtre de contexte géante est un plus grand sac à dos. Ce n'est pas un meilleur classeur.

FAQ

Qu'est-ce qu'une fenêtre de contexte en IA ?

Une fenêtre de contexte est la quantité de texte et d'entrée qu'un modèle d'IA peut utiliser activement pour une réponse. Cela inclut votre dernière invite, les tours précédents, les fichiers, la sortie d'outil et les instructions système cachées.

Pourquoi les longues conversations IA se dégradent-elles ?

Les longues conversations se dégradent parce que le modèle continue de retraiter plus d'ancien matériel, y compris du matériel non pertinent. Cela augmente les coûts et la latence, et cela peut réduire la précision bien avant que la limite de contexte stricte ne soit atteinte.

Une fenêtre de contexte plus grande résout-elle le problème ?

Cela aide, mais cela ne supprime pas le problème. Les fenêtres plus grandes vous donnent plus d'espace, mais les sessions désordonnées se dégradent toujours car la pertinence et la qualité des branches comptent autant que la taille brute.

À quelle fréquence dois-je commencer une nouvelle conversation IA ?

Commencez une nouvelle conversation chaque fois que la continuité devient plus coûteuse qu'une nouvelle "briefing". En pratique, cela signifie généralement après un changement de projet, un changement d'objectif majeur, ou une fois que le fil commence à montrer un encombrement et une confusion évidents.

Est-ce que commencer une nouvelle session est mauvais pour la continuité ?

Seulement si votre continuité ne vit qu'à l'intérieur du fil. Si votre "vraie" mémoire se trouve dans des fichiers, des notes, des "briefs" et des documents structurés, une nouvelle session améliore souvent la continuité en supprimant le bruit obsolète.

Traitez les sessions comme des espaces de travail

Gardez le système persistant, pas la conversation.

C'est le jeu. Utilisez les sessions comme des espaces de travail jetables. Gardez la vérité durable dans des endroits structurés. N'apportez que le bon contexte dans le fil suivant. Alors le modèle reste plus rapide, plus propre et plus utile.

Si vous continuez à traiter une conversation géante comme un cerveau immortel, elle finira par se transformer en soupe. Savoureuse ? Non. Efficace ? Non plus.

Construisez le système. Réinitialisez l'espace de travail. Passez à autre chose.

Need an AI workflow that stays sharp under real work? Build the system, not the chaos.

Get Started