Ventana de Contexto Explicada: Por qué los Chats Largos de IA Empeoran

Aprende qué es una ventana de contexto, por qué los chats largos de IA se vuelven más lentos y menos fiables, y cuándo reiniciar antes de que el arrastre de tokens arruine tu trabajo.

Tu IA no se volvió estúpida de repente. Tu chat se sobrecargó.

Esa es la parte que la mayoría de la gente pasa por alto. Culpan al modelo, al proveedor, al prompt, a la fase lunar, a cualquier cosa que parezca lo suficientemente dramática para explicar por qué la salida se volvió más lenta y descuidada.

Muchas veces, el problema es más simple. La sesión se llenó de demasiado equipaje viejo, demasiadas ramas muertas y demasiado contexto que el modelo tiene que seguir arrastrando.

La ventana de contexto es la memoria de trabajo

Una ventana de contexto es la cantidad de conversación, instrucciones, archivos y otras entradas que el modelo puede usar activamente para una respuesta. Piensa en ella como memoria de trabajo, no como memoria a largo plazo.

Esa distinción importa. Una ventana de contexto grande significa que el modelo puede ver más cosas en este momento. No significa que el modelo tenga memoria permanente, recuerdo perfecto o paciencia infinita.

Los tokens son la unidad real detrás de todo esto. Tu mensaje, las respuestas anteriores del modelo, los documentos pegados, las salidas de herramientas y las instrucciones del sistema, todo consume tokens. Cuanto mayor sea la pila, más tendrá que volver a leer el modelo antes de responder de nuevo.

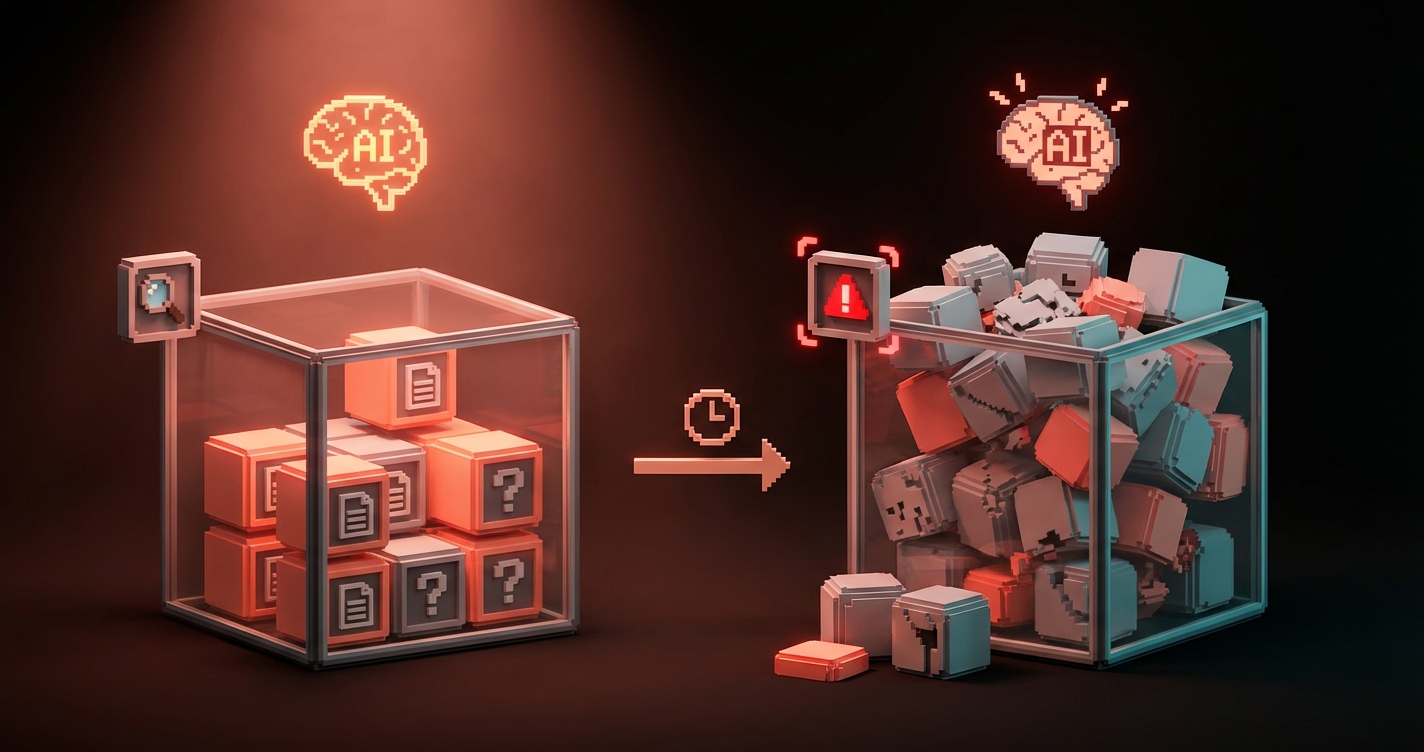

El mito es que un contexto más grande resuelve todo el problema. Ayuda, obviamente. Pero una ventana de un millón de tokens no convierte mágicamente una sesión caótica en una limpia. Una habitación más grande sigue ensuciándose si sigues tirando basura al suelo.

| Tipo de entrada | ¿Cuenta para el contexto? | Por qué importa | |---| | Mensajes del usuario | Sí | Cada nueva interacción aumenta la pila | | Respuestas del modelo | Sí | Las respuestas largas del asistente vuelven para la siguiente interacción | | Archivos y documentos pegados | Sí | Excelente para la profundidad, brutal cuando es demasiado grande | | Salida de herramientas | Sí | La forma más rápida de sobrecargar una sesión de trabajo | | Instrucciones ocultas del sistema | Sí | El modelo también las lleva consigo |

Los chats largos cuestan más en cada interacción

A medida que una sesión crece, el modelo sigue reprocesando más material antiguo. Eso aumenta el uso de tokens, la latencia y el costo, incluso cuando tu pregunta más reciente es corta.

Por eso los chats largos a menudo se sienten más pesados con el tiempo. Haces una pequeña pregunta de seguimiento, pero el modelo no solo está leyendo esa pregunta. Está arrastrando todo el historial de la conversación como un sofá por una escalera.

Las sesiones con muchas herramientas crecen aún más rápido. Algunas diferencias de código, registros, objetos JSON, capturas de pantalla y explicaciones prolijas pueden inflar el conjunto de trabajo lo suficientemente rápido como para hacer que un chat normal se sienta como cemento húmedo.

La parte insidiosa es que el arrastre se acumula. Cada respuesta larga añade más material para la siguiente respuesta, que a su vez añade más material para la que le sigue. Así es como una sesión que se sentía limpia hace una hora empieza a respirar como un fumador empedernido.

| Tipo de sesión | Qué sucede | Resultado típico | |---| | Corta y enfocada | Bajo reuso de tokens | Respuestas rápidas y precisas | | Larga pero disciplinada | Reuso moderado de tokens | Todavía utilizable si el tema se mantiene acotado | | Larga y desordenada | Alto reuso de tokens más ruido | Salida lenta, costosa y olvidadiza |

La calidad disminuye antes del límite estricto

El modo de fallo real suele ser una degradación suave, no un colapso dramático. La gente imagina que el modelo funciona perfectamente hasta que choca contra un muro, y luego explota. Bonita fantasía. La realidad es más cruel.

La mayoría de las veces, la calidad empieza a decaer antes de que la ventana esté técnicamente llena. El modelo se vuelve más lento. Empieza a repetirse. Pasa por alto restricciones más recientes. Revive ramas muertas como un gerente de producto zombi que todavía quiere ideas de características de hace tres horas.

Esa degradación suave es lo que perjudica el trabajo real. Un fallo grave es obvio. Un fallo suave desperdicia tiempo porque parece casi correcto.

Presta atención a estas señales de advertencia:

- Sigue olvidando la última instrucción y siguiendo una más antigua

- Responde con más palabras pero menos precisión

- Reabre caminos que ya habías rechazado

- Se vuelve más lento incluso cuando el nuevo prompt es simple

- Se vuelve genérico cuando la conversación solía sentirse específica

Eso no siempre es debilidad del modelo. A veces es putrefacción del contexto.

Un contexto desordenado es peor que un contexto grande

Una sesión enfocada al 60% suele ser más saludable que una sesión caótica al 30%. El tamaño importa, pero la relevancia importa más.

Si cada interacción sigue siendo sobre el mismo entregable, los mismos archivos, las mismas restricciones y el mismo camino de decisión, una sesión larga puede seguir siendo útil. El modelo está trabajando con un espacio de trabajo coherente.

Pero si mezclas tres proyectos, seis ideas abandonadas, investigación aleatoria, prompts de imágenes, notas de estrategia y una crisis existencial no relacionada en el mismo hilo, envenenaste el pozo tú mismo. Felicidades. Construiste un cajón de trastos y esperabas que salieran herramientas quirúrgicas de él.

El cambio de tema es el asesino aquí. El modelo tiene que mantener las ramas antiguas disponibles incluso cuando tú ya has avanzado mentalmente. Eso significa que el contexto obsoleto compite con el contexto activo.

Una sesión por flujo de trabajo funciona porque reduce la deuda de ramas. El modelo ve un problema activo, un camino, un conjunto de restricciones. Puede mantenerse preciso porque dejaste de pedirle que fuera un conserje psíquico.

Usa estos umbrales de porcentaje de contexto

La mayoría de la gente no necesita telemetría perfecta. Necesitan una regla simple para cuándo continuar, cuándo comprimir y cuándo reiniciar.

Usa esta tabla como umbral práctico:

| Uso del contexto | Zona | Cómo se siente usualmente | Qué hacer | |---| | 0% a 40% | Zona verde | Rápido, limpio, receptivo | Sigue adelante | | 40% a 60% | Zona saludable | Todavía fuerte, pero atento a la desviación | Mantente en una tarea | | 60% a 75% | Banda de advertencia | Más arrastre, más equipaje viejo | Resume y recorta | | 75% a 85% | Zona de arrastre | Más lento, más difuso, más repeticiones | Reinicia si la calidad importa | | Por encima del 85% | Zona roja | Costoso y poco fiable | Comprime o empieza de nuevo ahora |

No trates los números como escritura sagrada. Diferentes modelos se degradan de manera diferente. Diferentes tareas también se degradan de manera diferente. Una sesión de escritura podría tolerar más desviación que la depuración o la planificación técnica.

El principio es el punto clave: una vez que el arrastre del contexto se vuelve más costoso que volver a informar, reinicia.

Regla general rápida:

- Sigue adelante cuando la tarea aún sea coherente

- Comprime cuando el hilo aún sea útil pero empiece a sobrecargarse

- Reinicia cuando el modelo esté dedicando más esfuerzo a arrastrar el historial que a resolver el siguiente paso

Inicia un chat nuevo antes

Iniciar un chat nuevo no es perder la continuidad si tu memoria real reside fuera del chat. Esa es la versión adulta de usar la IA.

Mantén la sesión actual cuando:

- todavía estés dentro de un entregable

- las interacciones recientes sigan siendo todas relevantes

- el modelo esté siguiendo las últimas restricciones de forma limpia

- el hilo esté ayudando más de lo que está arrastrando

Reinicia inmediatamente cuando:

- cambies de proyecto

- cambies el objetivo real

- el hilo tenga múltiples ramas abandonadas

- el modelo siga pasando por alto instrucciones que ya le diste

- las respuestas se sientan más lentas y vagas de lo que el trabajo merece

Un reinicio limpio a menudo mejora la calidad más rápido que escribir un quinto prompt correctivo en la misma sesión sobrecargada. Deja de intentar rehabilitar un hilo muerto. Abre uno nuevo y trae solo lo que aún importa.

Si quieres más desgloses de sistemas y flujos de trabajo como este, explora el resto de Brainy Papers. Si quieres que todo esto se construya correctamente para tu equipo, contrata a Brainy.

Construye sistemas, no chats inmortales

Los mejores flujos de trabajo de IA almacenan conocimiento duradero fuera de la conversación. Las sesiones deben ser tácticas. La memoria debe ser estructural.

Eso significa planes, notas, resúmenes, listas de verificación, documentos y activos de prompts reutilizables. Si el único lugar donde existe tu contexto importante es dentro de un hilo gigante, no construiste un flujo de trabajo. Construiste una situación de rehenes.

La memoria externa te permite reinicios limpios sin perder el hilo del trabajo real. También facilita la colaboración, las transferencias son más limpias y los errores son más fáciles de detectar porque lo importante es visible fuera de la burbuja del chat.

Aquí es también donde la mayoría de los equipos se equivocan con la IA. Persiguen ventanas más grandes en lugar de mejores sistemas. Las ventanas más grandes son útiles. Los mejores sistemas son acumulativos.

Una versión para citar:

Una ventana de contexto gigante es una mochila más grande. No es un mejor archivador.

Preguntas frecuentes

¿Qué es una ventana de contexto en IA?

Una ventana de contexto es la cantidad de texto y entrada que un modelo de IA puede usar activamente para una respuesta. Eso incluye tu último prompt, interacciones anteriores, archivos, salida de herramientas e instrucciones ocultas del sistema.

¿Por qué los chats largos de IA empeoran?

Los chats largos empeoran porque el modelo sigue reprocesando más material antiguo, incluido material irrelevante. Eso aumenta el costo y la latencia, y puede reducir la precisión mucho antes de que se alcance el límite estricto del contexto.

¿Una ventana de contexto más grande soluciona el problema?

Ayuda, pero no elimina el problema. Las ventanas más grandes te dan más espacio, pero las sesiones desordenadas aún se degradan porque la relevancia y la calidad de las ramas importan tanto como el tamaño bruto.

¿Con qué frecuencia debo iniciar un nuevo chat de IA?

Inicia un nuevo chat siempre que la continuidad se vuelva más costosa que volver a informar. En la práctica, eso suele significar después de un cambio de proyecto, un cambio de objetivo importante, o una vez que el hilo empieza a mostrar un arrastre y una confusión obvios.

¿Iniciar una nueva sesión es malo para la continuidad?

Solo si tu continuidad reside únicamente dentro del hilo. Si tu memoria real está en archivos, notas, resúmenes y documentos estructurados, una sesión nueva a menudo mejora la continuidad al eliminar el ruido obsoleto.

Trata las sesiones como espacios de trabajo

Mantén el sistema persistente, no el chat.

Ese es el juego. Usa las sesiones como espacios de trabajo desechables. Mantén la verdad duradera en lugares estructurados. Trae solo el contexto correcto al siguiente hilo. Así el modelo se mantiene más rápido, más limpio y más útil.

Si sigues tratando un chat gigante como un cerebro inmortal, eventualmente se convertirá en sopa. ¿Sabrosa? No. ¿Eficiente? Tampoco.

Construye el sistema. Reinicia el espacio de trabajo. Sigue adelante.

Need an AI workflow that stays sharp under real work? Build the system, not the chaos.

Get Started