Kontextfenster erklärt: Warum lange KI-Chats schlechter werden

Erfahren Sie, was ein Kontextfenster ist, warum lange KI-Chats langsamer und unzuverlässiger werden und wann Sie zurücksetzen sollten, bevor der Token-Ballast die Arbeit ruiniert.

Ihre KI ist nicht plötzlich dumm geworden. Ihr Chat ist aufgebläht.

Das ist der Teil, den die meisten Leute übersehen. Sie geben dem Modell, dem Anbieter, dem Prompt, der Mondphase die Schuld, was auch immer dramatisch genug erscheint, um zu erklären, warum die Ausgabe langsamer und schlampiger wurde.

Oft ist das Problem einfacher. Die Sitzung wurde mit zu viel altem Ballast, zu vielen toten Ästen und zu viel Kontext überladen, den das Modell immer wieder mitschleppen muss.

Kontextfenster ist das Arbeitsgedächtnis

Ein Kontextfenster ist die Menge an Konversation, Anweisungen, Dateien und anderen Eingaben, die das Modell aktiv für eine Antwort nutzen kann. Stellen Sie es sich wie ein Arbeitsgedächtnis vor, nicht wie ein Langzeitgedächtnis.

Diese Unterscheidung ist wichtig. Ein großes Kontextfenster bedeutet, dass das Modell im Moment mehr Informationen berücksichtigen kann. Es bedeutet nicht, dass das Modell ein permanentes Gedächtnis, eine perfekte Erinnerung oder unendliche Geduld hat.

Tokens sind die eigentliche Einheit, die all dem zugrunde liegt. Ihre Nachricht, die früheren Antworten des Modells, eingefügte Dokumente, Tool-Ausgaben und Systemanweisungen verbrauchen alle Tokens. Je größer der Stapel, desto mehr muss das Modell erneut lesen, bevor es wieder antwortet.

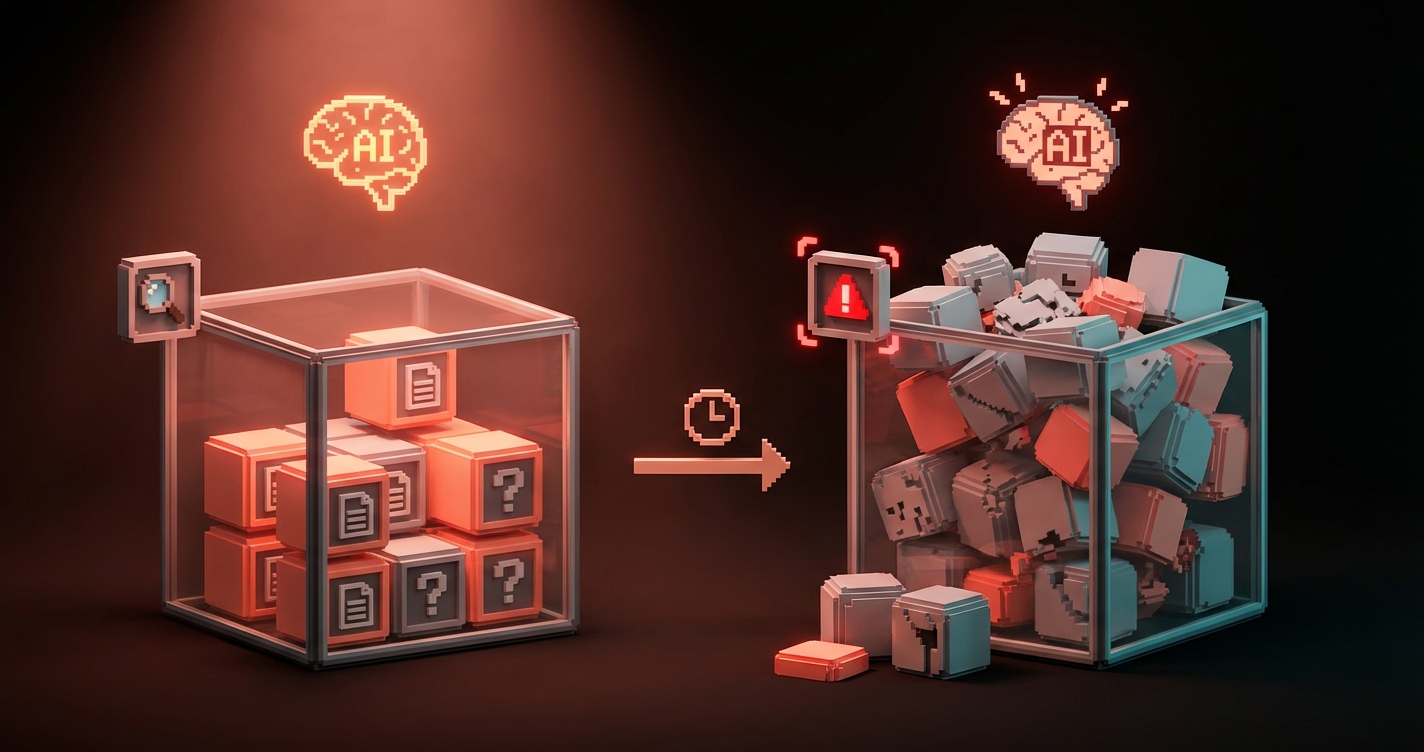

Der Mythos ist, dass ein größerer Kontext das ganze Problem löst. Es hilft natürlich. Aber ein Fenster mit einer Million Tokens verwandelt eine chaotische Sitzung nicht auf magische Weise in eine saubere. Ein größerer Raum wird immer noch unordentlich, wenn man weiterhin Müll auf den Boden wirft.

| Eingabetyp | Zählt zum Kontext? | Warum es wichtig ist |

|---|---|---|

| Benutzernachrichten | Ja | Jede neue Runde vergrößert den Stapel |

| Modellantworten | Ja | Lange Assistentenantworten kommen für die nächste Runde zurück |

| Dateien und eingefügte Dokumente | Ja | Großartig für die Tiefe, brutal, wenn überdimensioniert |

| Tool-Ausgabe | Ja | Schnellster Weg, eine Arbeitssitzung aufzublähen |

| Versteckte Systemanweisungen | Ja | Das Modell trägt diese auch mit sich |

Lange Chats kosten in jeder Runde mehr

Wenn eine Sitzung wächst, verarbeitet das Modell immer mehr altes Material neu. Das erhöht den Token-Verbrauch, die Latenz und die Kosten, selbst wenn Ihre neueste Frage kurz ist.

Deshalb fühlen sich lange Chats mit der Zeit oft schwerfälliger an. Sie stellen eine kleine Nachfrage, aber das Modell liest nicht nur die Nachfrage. Es schleppt die gesamte Konversationshistorie wie ein Sofa eine Treppe hinauf.

Tool-intensive Sitzungen wachsen noch schneller. Ein paar Code-Diffs, Logs, JSON-Blobs, Screenshots und ausführliche Erklärungen können den Arbeitssatz schnell genug aufblähen, um einen normalen Chat wie nassen Zement wirken zu lassen.

Der heimtückische Teil ist, dass sich der Ballast summiert. Jede lange Antwort fügt mehr Material für die nächste Antwort hinzu, was wiederum mehr Material für die darauf folgende hinzufügt. So beginnt eine Sitzung, die sich vor einer Stunde noch sauber anfühlte, wie ein Kettenraucher zu atmen.

| Sitzungstyp | Was passiert | Typisches Ergebnis |

|---|---|---|

| Kurz und fokussiert | Geringe Token-Wiederverwendung | Schnelle, präzise Antworten |

| Lang, aber diszipliniert | Moderate Token-Wiederverwendung | Noch nutzbar, wenn das Thema eng bleibt |

| Lang und unordentlich | Starke Token-Wiederverwendung plus Rauschen | Langsame, teure, vergessliche Ausgabe |

Die Qualität sinkt vor der harten Grenze

Der eigentliche Fehlerfall ist meist eine sanfte Verschlechterung, kein dramatischer Absturz. Die Leute stellen sich vor, das Modell funktioniert perfekt, bis es auf eine harte Wand trifft und dann explodiert. Nette Fantasie. Die Realität ist gemeiner.

Meistens beginnt die Qualität zu sinken, bevor das Fenster technisch voll ist. Das Modell wird langsamer. Es beginnt, sich zu wiederholen. Es übersieht neuere Einschränkungen. Es belebt tote Äste wieder, wie ein Zombie-Produktmanager, der immer noch Feature-Ideen von vor drei Stunden haben möchte.

Diese sanfte Verschlechterung ist es, die der eigentlichen Arbeit schadet. Ein harter Fehler ist offensichtlich. Ein weicher Fehler verschwendet Zeit, weil er fast richtig aussieht.

Achten Sie auf diese Warnzeichen:

- Es vergisst ständig die neueste Anweisung und folgt einer älteren

- Es antwortet mit mehr Worten, aber weniger Präzision

- Es öffnet Pfade wieder, die Sie bereits abgelehnt haben

- Es wird langsamer, selbst wenn der neue Prompt einfach ist

- Es wird generisch, obwohl die Konversation früher spezifisch war

Das ist nicht immer eine Schwäche des Modells. Manchmal ist es Kontextfäule.

Unordentlicher Kontext ist schlimmer als großer Kontext

Eine fokussierte 60%-Sitzung ist oft gesünder als eine chaotische 30%-Sitzung. Größe ist wichtig, aber Relevanz ist wichtiger.

Wenn sich jede Runde immer noch um dasselbe Ergebnis, dieselben Dateien, dieselben Einschränkungen und denselben Entscheidungspfad dreht, kann eine lange Sitzung nützlich bleiben. Das Modell arbeitet mit einem kohärenten Arbeitsbereich.

Aber wenn Sie drei Projekte, sechs aufgegebene Ideen, zufällige Recherchen, Bild-Prompts, Strategienotizen und eine nicht verwandte existenzielle Krise in denselben Thread mischen, haben Sie den Brunnen selbst vergiftet. Herzlichen Glückwunsch. Sie haben eine Kramschublade gebaut und erwartet, dass chirurgische Werkzeuge daraus kommen.

Themenwechsel sind hier der Killer. Das Modell muss alte Zweige verfügbar halten, selbst wenn Sie mental weitergezogen sind. Das bedeutet, dass veralteter Kontext mit aktuellem Kontext konkurriert.

Eine Sitzung pro Arbeitsablauf funktioniert, weil sie die "Branch Debt" reduziert. Das Modell sieht ein aktives Problem, einen Pfad, einen Satz von Einschränkungen. Es kann scharf bleiben, weil Sie aufgehört haben, es zu bitten, ein hellseherischer Hausmeister zu sein.

Verwenden Sie diese Kontext-Prozentschwellenwerte

Die meisten Menschen brauchen keine perfekte Telemetrie. Sie brauchen eine einfache Regel, wann sie fortfahren, wann sie komprimieren und wann sie zurücksetzen sollen.

Verwenden Sie dies als praktische Schwellenwerttabelle:

| Kontextnutzung | Zone | Wie es sich normalerweise anfühlt | Was zu tun ist |

|---|---|---|---|

| 0% bis 40% | Grüne Zone | Schnell, sauber, reaktionsschnell | Weiter machen |

| 40% bis 60% | Gesunde Zone | Immer noch stark, aber auf Abweichungen achten | Bei einer Aufgabe bleiben |

| 60% bis 75% | Warnbereich | Mehr Ballast, mehr altes Gepäck | Zusammenfassen und kürzen |

| 75% bis 85% | Schleppzone | Langsamer, unschärfer, mehr Wiederholungen | Zurücksetzen, wenn Qualität wichtig ist |

| Über 85% | Rote Zone | Teuer und unzuverlässig | Jetzt komprimieren oder neu beginnen |

Behandeln Sie die Zahlen nicht wie heilige Schrift. Verschiedene Modelle verschlechtern sich unterschiedlich. Auch verschiedene Aufgaben verschlechtern sich unterschiedlich. Eine Schreibsitzung könnte mehr Abweichungen tolerieren als Debugging oder technische Planung.

Das Prinzip ist der Punkt: Sobald der Kontext-Ballast teurer wird als ein erneutes Briefing, setzen Sie zurück.

Kurze Faustregel:

- Weiter machen, wenn die Aufgabe noch kohärent ist

- Komprimieren, wenn der Thread noch nützlich ist, aber anfängt, sich aufzublähen

- Zurücksetzen, wenn das Modell mehr Aufwand für das Mitschleppen der Historie aufwendet als für die Lösung des nächsten Schritts

Beginnen Sie früher einen neuen Chat

Einen neuen Chat zu starten bedeutet keinen Kontinuitätsverlust, wenn Ihr echtes Gedächtnis außerhalb des Chats liegt. Das ist die erwachsene Version der KI-Nutzung.

Behalten Sie die aktuelle Sitzung bei, wenn:

- Sie sich noch innerhalb eines Ergebnisses befinden

- die letzten Runden alle noch relevant sind

- das Modell die neuesten Einschränkungen sauber befolgt

- der Thread mehr hilft, als er behindert

Sofort zurücksetzen, wenn:

- Sie Projekte wechseln

- Sie das eigentliche Ziel ändern

- der Thread mehrere aufgegebene Zweige hat

- das Modell Anweisungen, die Sie bereits gegeben haben, immer wieder übersieht

- die Antworten langsamer und vager wirken, als die Arbeit es verdient

Ein sauberer Reset verbessert die Qualität oft schneller, als einen fünften korrigierenden Prompt in derselben aufgeblähten Sitzung zu schreiben. Hören Sie auf, einen toten Thread wiederzubeleben. Öffnen Sie einen neuen und bringen Sie nur das mit, was noch wichtig ist.

Wenn Sie weitere System- und Workflow-Analysen wie diese wünschen, durchsuchen Sie den Rest der Brainy Papers. Wenn Sie das Ganze für Ihr Team richtig aufbauen lassen möchten, stellen Sie Brainy ein.

Systeme bauen, keine unsterblichen Chats

Die besten KI-Workflows speichern dauerhaftes Wissen außerhalb der Konversation. Sitzungen sollten taktisch sein. Das Gedächtnis sollte strukturell sein.

Das bedeutet Pläne, Notizen, Briefings, Checklisten, Dokumente und wiederverwendbare Prompt-Assets. Wenn der einzige Ort, an dem Ihr wichtiger Kontext existiert, innerhalb eines riesigen Threads ist, haben Sie keinen Workflow aufgebaut. Sie haben eine Geiselnahme geschaffen.

Externer Speicher ermöglicht saubere Neustarts, ohne den Faden der eigentlichen Arbeit zu verlieren. Er erleichtert auch die Zusammenarbeit, macht Übergaben sauberer und Fehler leichter erkennbar, da die wichtigen Dinge außerhalb der Chat-Blase sichtbar sind.

Hier machen die meisten Teams bei der KI auch Fehler. Sie jagen größeren Fenstern hinterher statt besseren Systemen. Größere Fenster sind nützlich. Bessere Systeme sind kumulativ.

Eine zitierfähige Version:

Ein riesiges Kontextfenster ist ein größerer Rucksack. Es ist kein besserer Aktenschrank.

FAQ

Was ist ein Kontextfenster in der KI?

Ein Kontextfenster ist die Menge an Text und Eingaben, die ein KI-Modell aktiv für eine Antwort nutzen kann. Dazu gehören Ihr neuester Prompt, frühere Runden, Dateien, Tool-Ausgaben und versteckte Systemanweisungen.

Warum werden lange KI-Chats schlechter?

Lange Chats werden schlechter, weil das Modell immer mehr altes Material, einschließlich irrelevanten Materials, neu verarbeitet. Das erhöht Kosten und Latenz und kann die Präzision lange vor Erreichen der harten Kontextgrenze verringern.

Behebt ein größeres Kontextfenster das Problem?

Es hilft, aber es beseitigt das Problem nicht. Größere Fenster geben Ihnen mehr Raum, aber unordentliche Sitzungen verschlechtern sich immer noch, weil Relevanz und Zweigqualität genauso wichtig sind wie die reine Größe.

Wie oft sollte ich einen neuen KI-Chat starten?

Starten Sie einen neuen Chat, wann immer die Kontinuität teurer wird als ein erneutes Briefing. In der Praxis bedeutet das normalerweise nach einem Projektwechsel, einer größeren Zieländerung oder sobald der Thread offensichtliche Verzögerungen und Verwirrung zeigt.

Ist das Starten einer neuen Sitzung schlecht für die Kontinuität?

Nur wenn Ihre Kontinuität ausschließlich innerhalb des Threads existiert. Wenn Ihr echtes Gedächtnis in Dateien, Notizen, Briefings und strukturierten Dokumenten liegt, verbessert eine neue Sitzung oft die Kontinuität, indem sie veraltetes Rauschen entfernt.

Behandeln Sie Sitzungen wie Arbeitsbereiche

Halten Sie das System persistent, nicht den Chat.

Das ist das Spiel. Nutzen Sie Sitzungen wie Wegwerf-Arbeitsbereiche. Bewahren Sie die dauerhafte Wahrheit an strukturierten Orten auf. Bringen Sie nur den richtigen Kontext in den nächsten Thread. Dann bleibt das Modell schneller, sauberer und nützlicher.

Wenn Sie einen riesigen Chat weiterhin wie ein unsterbliches Gehirn behandeln, wird er sich irgendwann in Suppe verwandeln. Lecker? Nein. Effizient? Auch nein.

Bauen Sie das System. Setzen Sie den Arbeitsbereich zurück. Machen Sie weiter.

Need an AI workflow that stays sharp under real work? Build the system, not the chaos.

Get Started