Die Frontier-Modellkarte 2026: GPT-5.5, Claude 4.7, Gemini 3 und ihre jeweiligen Stärken

Eine Arbeitskarte der Modelllandschaft für 2026. GPT-5.5, Claude 4.7 Opus und Sonnet, Gemini 3 Pro, Llama 5, Grok 4, DeepSeek V4 und Qwen 3 werden bewertet hinsichtlich ihrer tatsächlichen Erfolge, ihrer potenziellen Verluste, der ungefähren Preise pro Million Token und einer Entscheidungsmatrix für Designer und Entwickler, die Modelle für reale Produkt-Stacks auswählen.

Es gibt 2026 kein führendes Spitzenmodell. Die Rangliste hat sich in Spezialisten aufgespalten. GPT-5.5 ist führend bei allgemeinen Aufgaben. Claude 4.7 Opus überzeugt mit logischem Denken und Agentenzuverlässigkeit. Sonnet ist führend bei Prosa und bietet das optimale Verhältnis von Geschwindigkeit und Kosten. Gemini 3 Pro ist führend bei langen Kontexten. Llama 5 ist führend bei Open-Weight. Grok 4 dominiert eine Echtzeit-Nische. DeepSeek hat die Preisuntergrenze durchbrochen. Qwen 3 ist führend bei mehrsprachigen Anwendungen.

Dies ist eine Übersicht der acht relevanten Modelle, der ungefähren Preise pro Million Token, der vier Anwendungsfälle und ihrer jeweiligen Stärken sowie der vier Fallstricke, in die Teams bei der Auswahl anhand der Rangliste tappen.

Die Spitzenklasse spaltet sich 2026 in Spezialisten auf

Im Jahr 2024 wurde ein einzelnes Modell alle sechs Monate intelligenter. Im Jahr 2026 besteht das Modell aus mehreren Spezialisten, und die aktuell führenden Produktteams setzen zwei oder drei Modelle hinter einer Routing-Schicht ein.

Die Wahl eines einzigen Modells für alles ist der häufigste Fehler im Jahr 2026. Die Kosten steigen bei den falschen Arbeitslasten in die Höhe, und die Qualität sinkt bei den Arbeitslasten, bei denen das gewählte Modell Schwächen aufweist. Die Zukunftsvision ist ein Routing-Problem, kein Auswahlproblem.

GPT-5.5, das Allround-Arbeitstier

GPT-5.5 ist das Flaggschiff von OpenAI und die Standardwahl für allgemeine Produktentwicklung. Es ist das stärkste Allround-Modell, wenn Sie eine API benötigen, die nahezu alles kompetent erledigt. Robuster Code, optimaler Werkzeugeinsatz, klare Vision, geringe Latenz und das ausgereifteste Ökosystem aller Zukunftsvision-Modelle.

Wo es an Kosten spart: Lange Argumentationspfade: Claude 4,7 Opus. Pfade zum Abrufen langer Kontexte: Gemini 3 Pro. Markenstimme und Schreibstil liegen unterhalb von Sonnet. Preisgestaltung: ca. 5 US-Dollar pro Million Input und 15 US-Dollar pro Million Output. Mittelklasse im geschlossenen Marktsegment.

Claude 4.7 Opus, die Spitze in Sachen Logik und Agentenleistung

Claude 4.7 Opus ist das Spitzenmodell von Anthropic und bietet die beste Logik und Agentenzuverlässigkeit, die 2026 auf den Markt kommen wird. Das Modell Ihrer Wahl, wenn die Aufgabe beim ersten Versuch gelöst werden muss. Die Befehlsausführung ist die präziseste im Markt. Die Formatkonformität ist absolut zuverlässig. Die Stabilität der Tool-Nutzung über lange Agentenläufe hinweg ist der Grund, warum Claude Code, der Cursor-Agentenmodus und die meisten professionellen Agenten-Frameworks standardmäßig darauf setzen.

Hier bleiben die Kosten. Langsamstes und teuerstes der geschlossenen Flaggschiffmodelle. Preisgestaltung: ca. 15 US-Dollar Input und 75 US-Dollar Output pro Million. Die richtige Wahl für Anrufe mit höchstem Einsatz. Nicht die richtige Wahl für hohes Arbeitsvolumen.

Claude 4.7 Sonnet – Das optimale Verhältnis von Geschwindigkeit und Kosten

Claude 4.7 Sonnet ist das Modell, auf das die meisten Produktionsteams 2026 standardmäßig setzen sollten. Es bietet etwa 90 % der Opus-Qualität zu einem Bruchteil der Kosten und mit doppelter Geschwindigkeit. Beste Textqualität auf dem Markt. Beste Beibehaltung der Markenstimme. Geringste Abweichungen bei längeren Gesprächen. Die Modellentwickler greifen auf dieses Modell zurück, wenn die Ausgabe von einem Menschen gelesen wird.

Wo es Kosten einbüßt: Bei komplexen Logikaufgaben und langen Agentenläufen etwas schwächer als Opus. Preisgestaltung: ca. 3 US-Dollar Input und 15 US-Dollar Output pro Million. Das beste Kosten-Nutzen-Verhältnis aller geschlossenen Modelle.

Claude 4.7 Haiku, das leistungsstarke Arbeitstier

Claude 4.7 Haiku ist das kostengünstige und schnelle Modell im Anthropic-Stack und die richtige Wahl bei hohem Anrufaufkommen und moderaten Qualitätsansprüchen. Klassifizierung, Extraktion, strukturiertes Tagging, schnelle Routing-Entscheidungen, schlanker Chat. Zuverlässige Befehlsausführung im günstigen Preissegment.

Hier liegt der Kostenfaktor: Nicht geeignet für komplexes Denken, längere Texte oder rechenintensive Agentenläufe. Preis: ca. 1 US-Dollar Input und 5 US-Dollar Output pro Million Anrufe.

Gemini 3 Pro, der Champion für Long-Context und Multimodalität

Gemini 3 Pro ist Googles Flaggschiff und das leistungsstärkste Modell im Jahr 2026 für Long-Context-Retrieval, Dokumenten-Grounding und native Multimodalität. Das effektive Kontextfenster von zwei Millionen Token mit seiner extrem hohen Zuverlässigkeit ist unübertroffen. Die native Verarbeitung von Video-, Audio- und Bildeingaben ist die sauberste im geschlossenen Feld.

Kosten: Die Sprachausgabe ist die schwächste der Flaggschiffmodelle. Fließtext liest sich kompetent, aber statisch. Für Markenstimmen sind intensive Hilfestellungen nötig, um die Standardeinstellung zu überwinden. Preis: ca. 2,50 Dollar Input und 10 Dollar Output pro Million Token. Starkes Kosten-Nutzen-Verhältnis für den Vorteil im Langzeitkontext.

Llama 5, der Open-Weight-Standard

Llama 5 ist Metas Flaggschiff unter den Open-Weight-Modellen und das beste Modell, das Sie 2026 selbst hosten können. Die richtige Wahl, wenn Datenresidenz, Kostenkontrolle oder Feinabstimmung wichtiger sind als absolute Qualität. Die Variante mit 405 Milliarden Parametern liegt in den meisten allgemeinen Benchmarks in Schlagdistanz zu GPT-5.5.

Kosten: Die Infrastrukturkosten für das Selbsthosting der großen Variante sind beträchtlich. Llama 5, gehostet von einem Anbieter, liegt preislich im selben Segment wie Sonnet, bietet aber nicht dessen Prosa-Vorteil. Preis: ca. 1 bis 2 US-Dollar pro Million (bei verschiedenen Anbietern).

Grok 4, die Nischenlösung für Echtzeitanwendungen

Grok 4 ist das Flaggschiff von xAI mit nativem Echtzeitzugriff auf die X-Datenbank und einer unkonventionellen Standardstimme. Geeignet für spezielle Anwendungsbereiche: Nachrichtenüberwachung, Stimmungsanalyse, Echtzeit-Ereignisanalyse und alle Produkte, bei denen die KI die aktuellsten öffentlichen Debatten benötigt, nicht die Trainingsdaten von gestern.

Hier liegen die Schwächen: Die logische Leistung ist geringer als die von Opus, der Code ebenfalls. Die Stimme kann in Produkten, deren Persönlichkeit von der Marke vorgegeben sein sollte, problematisch sein. Preis: ca. 5 US-Dollar pro Million für Eingabe und 15 US-Dollar pro Million für Ausgabe. Im selben Preissegment wie GPT-5.5, jedoch mit einem deutlich eingeschränkteren Anwendungsbereich.

DeepSeek V4 und R2, die Kostensenker

DeepSeek V4 und R2 sind das Open-Weight-Reasoning-Paar, das 2026 die Preisuntergrenze durchbrach. V4 ist das allgemeine Modell. R2 ist der Reasoning-Spezialist. Erstklassige Reasoning-Qualität zu etwa einem Zehntel der Kosten des Closed-Modells. Gehostet von DeepSeek oder selbst gehostet mit den Open Weights.

Was die Kosten angeht: Etwas geringere Stabilität bei der Tool-Nutzung als Claude 4.7. Verzögerungen beim Abrufen langer Kontexte gegenüber Gemini 3. Die Prosa-Qualität ist unter Sonnet. Preisgestaltung: ca. 0,30 Dollar Input und 1 Dollar Output pro Million. Produktionsteams leiten jetzt Reasoning mit hohem Volumen über DeepSeek und reservieren Opus für die Fälle, in denen perfekte Ergebnisse erforderlich sind.

Qwen 3, der offene, mehrsprachige Standard

Qwen 3 ist Alibabas Open-Wight-Produktfamilie und das leistungsstärkste offene Modell für mehrsprachige Workloads. Die richtige Wahl, wenn das Produkt in mehr als Englisch und Mandarin verfügbar ist. Besonders stark ist Qwen 3 bei asiatischen Sprachen, Arabisch und den vielen regionalen Sprachen, bei denen Llama 5 an seine Grenzen stößt.

Kostenvorteile: Benchmarks für rein englischsprachige Anwendungen liegen leicht hinter Llama 5 zurück. Die Nutzung von Hosting-Anbietern ist außerhalb der Alibaba Cloud noch nicht ausgereift. Die Preise ähneln denen von Llama 5 bei Shared-Hosting-Anbietern, sind aber bei Selbsthosting sehr günstig.

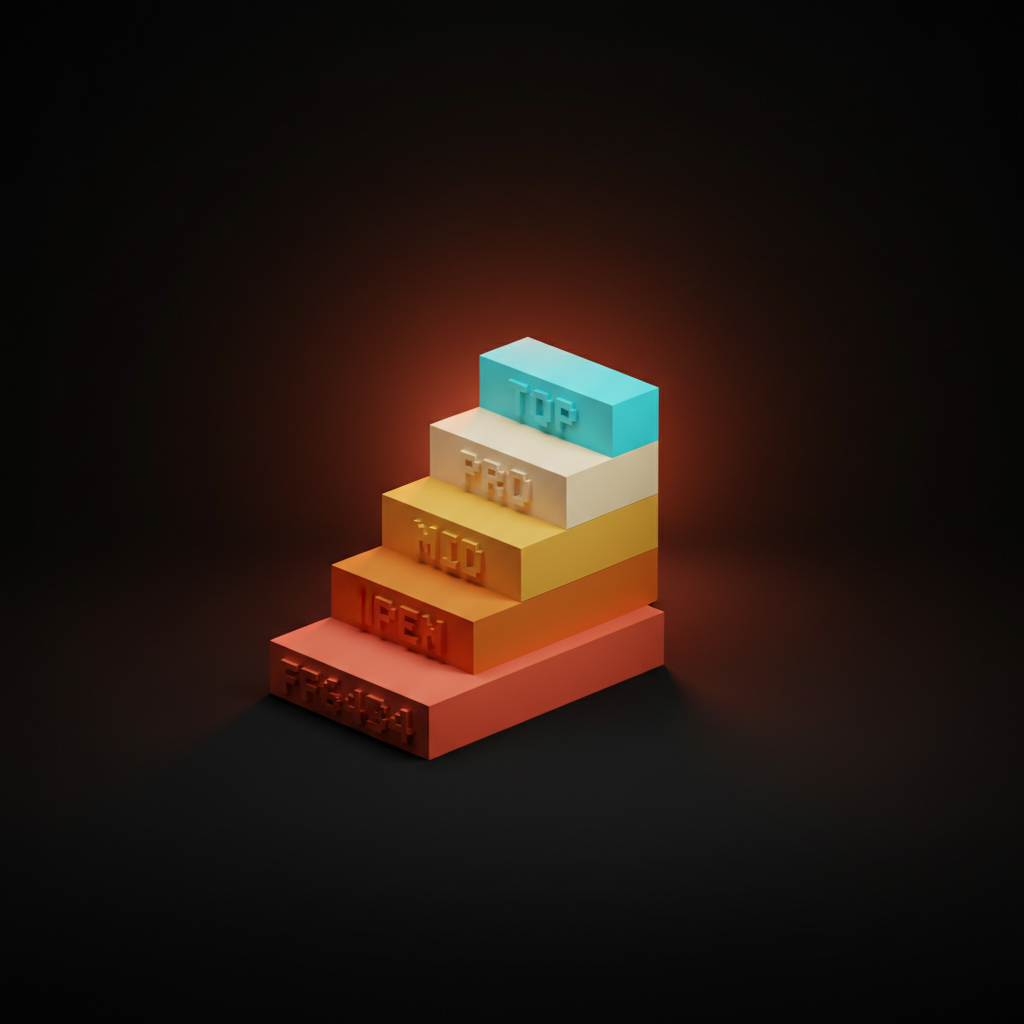

Preisentwicklung 2026: Was kostet eine Million Token tatsächlich?

Die Preisgestaltung ist in vier Stufen unterteilt. Die Modelle mit dem niedrigsten Token-Preis sind nicht immer die günstigsten Modelle pro Auftrag, wenn die Berechnungstiefe und die Nachbearbeitungsraten berücksichtigt werden.

| Modell | Input ($/1 Mio.) | Output ($/1 Mio.) | Stufe |

|---|---|---|---|

| Claude 4.7 Opus | 15 | 75 | Top |

| GPT-5.5 | 5 | 15 | Pro |

| Grok 4 | 5 | 15 | Pro |

| Claude 4.7 Sonnet | 3 | 15 | Pro |

| Gemini 3 Pro | 2.50 | 10 | Mittel |

| Llama 5 (gehostet) | 1 bis 2 | 1 bis 2 | Mittel |

| Qwen 3 (gehostet) | 1 bis 2 | 1 bis 2 | Mittel |

| Claude 4.7 Haiku | 1 | 5 | Mittel |

| DeepSeek V4 | 0.30 | 1 | Offen |

| DeepSeek R2 | 0.30 | 1 | Offen |

Die Kosten pro Auftrag sind entscheidend. Ein günstiges Modell, das drei Wiederholungsversuche für eine komplexe Aufgabe benötigt, ist teurer als ein Opus-Aufruf, der nur einmal erfolgreich ist. Führen Sie die Berechnungen mit realem Datenverkehr durch, bevor Sie die Routing-Schicht festlegen.

Die vier Anwendungsfälle auf Designseite

Forschungssynthese, Copy-QA, Bildgenerierungs-Pipelines und Prompt-as-Component sind die vier Workloads, die darüber entscheiden, welches Modell seinen API-Schlüssel erhält. Jeder hat einen anderen Gewinner.

Forschungssynthese, bei der Gemini 3 Pro gewinnt

Forschungssynthese ist der Workload mit langem Kontext, bei dem zehn Berichte in einen Prompt eingefügt und eine saubere, fundierte Zusammenfassung erstellt wird. Gemini 3 Pro überzeugt durch Zuverlässigkeit beim Abruf, Zitationsqualität und effektives Fenster bei mehr als einer Million Token. Sonnet ist ein starker Zweiter bei kürzeren Horizonten. Die Mathematik spricht für Gemini, sobald die Eingaben 200.000 Token überschreiten. Für Workflows, bei denen die Fenstereffizienz wichtiger ist als die reine Größe, siehe Kontexteffizienz.

Copy-QA, bei der Claude 4.7 Sonnet die Nase vorn hat

Copy-QA umfasst die Überprüfung der Markenstimme, die Kritik an Mikrotexten und die Sicherstellung einer konsistenten Tonalität in großem Umfang. Sonnet überzeugt mit dem besten Stil, der klarsten Prosa und der geringsten Abweichung über längere Sitzungen. In Kombination mit einer strukturierten Rubrik und einem Markenstimme-Paket Claude Fähigkeiten läuft die Evaluierungspipeline vollautomatisch.

Bildgenerierungspipelines, bei denen das Routing entscheidend ist

Bildgenerierungspipelines werden nicht von einem einzelnen Modell, sondern vom Routing entschieden. Der Gewinner im Bereich Prompt-Shaping im Jahr 2026 ist GPT-5.5 in Kombination mit einem dedizierten Bildmodell im Backend. Sonnet ist eine starke Alternative, wenn die Markenstimme im Prompt enthalten sein muss. Das Bildmodell selbst ist eine separate Entscheidung und ändert sich schneller als die Sprachschicht.

Eingabeaufforderung als Komponente, bei der Opus (BRAND17) 4.7 die Nase vorn hat

Bei der Eingabeaufforderung als Komponente wird eine Eingabeaufforderung zu einem wiederverwendbaren Produktionsprimitiv mit strikter Formatkonformität, strukturierter Ausgabe und Werkzeugnutzung über lange Agentenläufe hinweg. Opus ist in Bezug auf Befehlsausführung, Formatkonformität und Stabilität der Werkzeugnutzung überlegen. Informationen zur agentenbasierten IDE finden Sie unter LINK2. Bei LINK3 basiert das zugrunde liegende Modell bei den auszuführenden Aufrufen fast immer auf Opus.

IMG2

Die Entscheidungsmatrix mit vier Anwendungsfällen

| Anwendungsfall | Auswahl | Begründung |

|---|---|---|

| Forschungssynthese | 3 Pro | Langer Kontext, hohe Zitatqualität, zuverlässige Basis für mehr als 200.000 Tokens. |

| Copy QA | Claude 4,7 Sonnet | Bester Prosa-Geschmack, geringste Abweichung, stärkste Markenstimme-Erhaltung. |

| Bildgenerierungs-Pipelines | GPT-5.5 (Prompt) + dediziertes Bildmodell | Beste Prompt-Gestaltung mit umfassendster Provider-Integration. |

| Prompt als Komponente | Claude 4,7 Opus | Beste Anweisungsbefolgung, Formatkonformität, Stabilität bei der Tool-Nutzung. |

Die Kombinationen sind entscheidend. Nur wenige Produktionsteams arbeiten 2026 noch mit einem einzigen Modell. Die meisten setzen auf zwei oder drei Modelle hinter einer Routing-Schicht, die pro Aufruf auswählt.

Benötigen Sie Hilfe bei der Auswahl des richtigen Zukunftsmodells für Ihr Produkt und der Einrichtung des Routings, damit Kosten und Qualität stimmen? Miete Brainy. ClaudeBrainy liefert Skill-Packs und Prompt-Bibliotheken, die die Modellschicht optimal gestalten. AppBrainy liefert vollständige Produktversionen für Teams, die mit ihrer KI tatsächlich Funktionen entwickeln und nicht nur Demos erstellen möchten.

Einsatzgebiete der einzelnen Modelle in realen Produktumgebungen

Die Rangliste ist das eine, die Produktumgebung das andere. Die acht Modelle haben sich in klar definierten Anwendungsbereichen etabliert.

GPT-5.5 ist führend im Bereich Consumer-Chat und die Standardlösung in jeder neuen Anwendung, die eine API benötigt. Opus eignet sich für besonders wichtige Agentenanrufe und die Verarbeitung von Eingabeaufforderungen als Komponenten. Sonnet wird für langfristige Marken- und Schreibprozesse eingesetzt. Haiku ist für umfangreiche Hintergrundprozesse geeignet. BRAND32 3 Pro ist ideal für dokumentenintensive und multimodale Anwendungen. Llama 5 findet Anwendung in regulierten, datenspeichergebundenen und kostenkontrollierten Umgebungen. Grok 4 ist auf Echtzeit-Nachrichten spezialisiert. DeepSeek eignet sich für umfangreiches Reasoning, wo die Kosten das Projekt sonst zum Scheitern gebracht hätten. Qwen 3 ist in mehrsprachigen und asiatisch-pazifischen Umgebungen integriert.

Vier Fallstricke bei der Auswahl anhand von Benchmarks

Erstens: Die Leaderboard-Falle. Ein Team wählt das Modell, das im März die Benchmark anführt, doch im Juli ist es nicht mehr die richtige Wahl. Lösung: Wählen Sie anhand der Eignung für den Anwendungsfall und überprüfen Sie die Routing-Ebene vierteljährlich.

Zweitens: Die Einzelmodell-Falle. Ein Team legt ein einziges Modell für die gesamte Umgebung fest und stößt bei der Arbeitslast, die es nicht bewältigen kann, an seine Grenzen. Lösung: Routing nach Auftrag, nicht nach Vertrag.

Drittens: Die Billig-Token-Falle. Ein Team optimiert den Inputpreis und zahlt mit Wiederholungen, Nacharbeit und Qualitätsverlusten. Lösung: Ermitteln Sie die Kosten pro Auftrag vor dem Rollout.

Viertens: Die Sprachfehler-Falle. Ein Team verwendet ein Modell mit einheitlichem Sprachstil für markenorientierte Texte, und der Text wirkt leblos. Lösung: Leiten Sie markenorientierte Texte über Sonnet, den Rest über das kostengünstigste Modell.

FAQ

Welches ist das beste KI-Modell im Jahr 2026?

Es gibt kein eindeutig bestes Modell. GPT-5.5 ist am besten für allgemeine Aufgaben geeignet, Claude 4.7 Opus überzeugt mit logischem Denken und Agenten, Sonnet mit Prosa und Markenstimme, Gemini 3 Pro mit langen Kontexten, Llama 5 mit Openweight und DeepSeek mit den geringsten Kosten. Wählen Sie das Modell passend zum Anwendungsfall.

Ist Claude 4.7 besser als GPT-5.5?

Es gibt verschiedene Arten von Vorteilen. GPT-5.5 ist der bessere Standard für allgemeine Produktaufgaben und bietet das breiteste Ökosystem. Opus ist besser in den Bereichen logisches Denken, Agentenzuverlässigkeit und Befehlsausführung. Sonnet ist besser in der Prosaverarbeitung. Die meisten Produktionsumgebungen verwenden beide Modelle hinter einem Router.

Welches ist das kostengünstigste Spitzenmodell im Jahr 2026?

DeepSeek V4 und R2. Ca. 0,30 Dollar Input und 1 Dollar Output pro Million. Ungefähr ein Zehntel der Kosten der geschlossenen Flaggschiffmodelle bei erstklassiger Reasoning-Qualität.

Welches Modell hat das längste Kontextfenster?

BRAND34 3 Pro. Mit einem effektiven Fenster von zwei Millionen Token und hoher Abrufzuverlässigkeit ist es führend.

Welches ist das beste Open-Weight-Modell im Jahr 2026?

Llama 5 für allgemeine Aufgaben mit Englisch als Muttersprache. Qwen 3 für mehrsprachige Aufgaben. DeepSeek V4 und R2 für Reasoning in großem Umfang.

Die Verschiebung, die die Frontier-Map tatsächlich ermöglicht

Die Frontier im Jahr 2026 besteht nicht aus einem einzelnen, immer intelligenteren Modell. Sie besteht aus einem Team von Spezialisten, das es einem kleinen Team ermöglicht, die Arbeit eines viel größeren Teams zu erledigen, indem es die Aufgaben nach Auftrag aufteilt. Die erfolgreichen Teams sind nicht diejenigen mit dem besten Modellvertrag, sondern diejenigen mit der besten Routing-Logik.

Es gibt 2026 kein bestes Modell, sondern nur das beste für die jeweilige Aufgabe. Die erfolgreichsten Teams routen anwendungsfallbasiert statt nach Rangliste.

Wenn Ihr Team Modelle vergleicht und sich die Diskussion nur darum dreht, welches Modell den neuesten Benchmark anführt, liegt das Problem in der Diskussion selbst. Bilden Sie die Workloads ab, wählen Sie das jeweils beste Modell, testen Sie es zwei Wochen lang mit realem Datenverkehr und lassen Sie die Kosten-Nutzen-Analyse entscheiden.

Wenn Sie Hilfe bei der Auswahl des richtigen Spitzenmodells und dem Aufbau der Routing-Schicht benötigen, wenden Sie sich an Brainy einstellen. ClaudeBrainy bietet Skill-Packs und Prompt-Bibliotheken für die korrekte Modellierung. AppBrainy liefert vollständige Produktversionen für Teams, die mit ihrer KI Funktionen statt Demos entwickeln möchten.

Want help picking the right frontier model for your product and routing the stack so the cost and quality math both work? Brainy ships ClaudeBrainy as a Skill pack and prompt library that gets the model layer right, and AppBrainy ships full product builds for teams that want their AI to actually ship features, not demos.

Get Started