Modèles de conception d'interfaces utilisateur pour agents IA : comment créer des interfaces pour les outils autonomes

Une bibliothèque de modèles fonctionnels pour la conception d'interfaces utilisateur d'agents IA. Huit analyses de produits réels issus de Claude Code, Cursor, Devin, Linear, ChatGPT Operator, Replit Agent, Bolt et v0, ainsi que les sept modèles indispensables à toute interface d'agent.

La conception d'interfaces pour agents IA ne se résume pas à une interface de chat à laquelle on aurait ajouté de l'autonomie. Un agent est un travailleur autonome qui définit un objectif, planifie un parcours et exécute des outils sans demander d'autorisation à chaque étape. Son interface est une surface de contrôle, et non un espace de conversation. Les produits proposant les interfaces pour agents les plus abouties les conçoivent ainsi dès la première maquette.

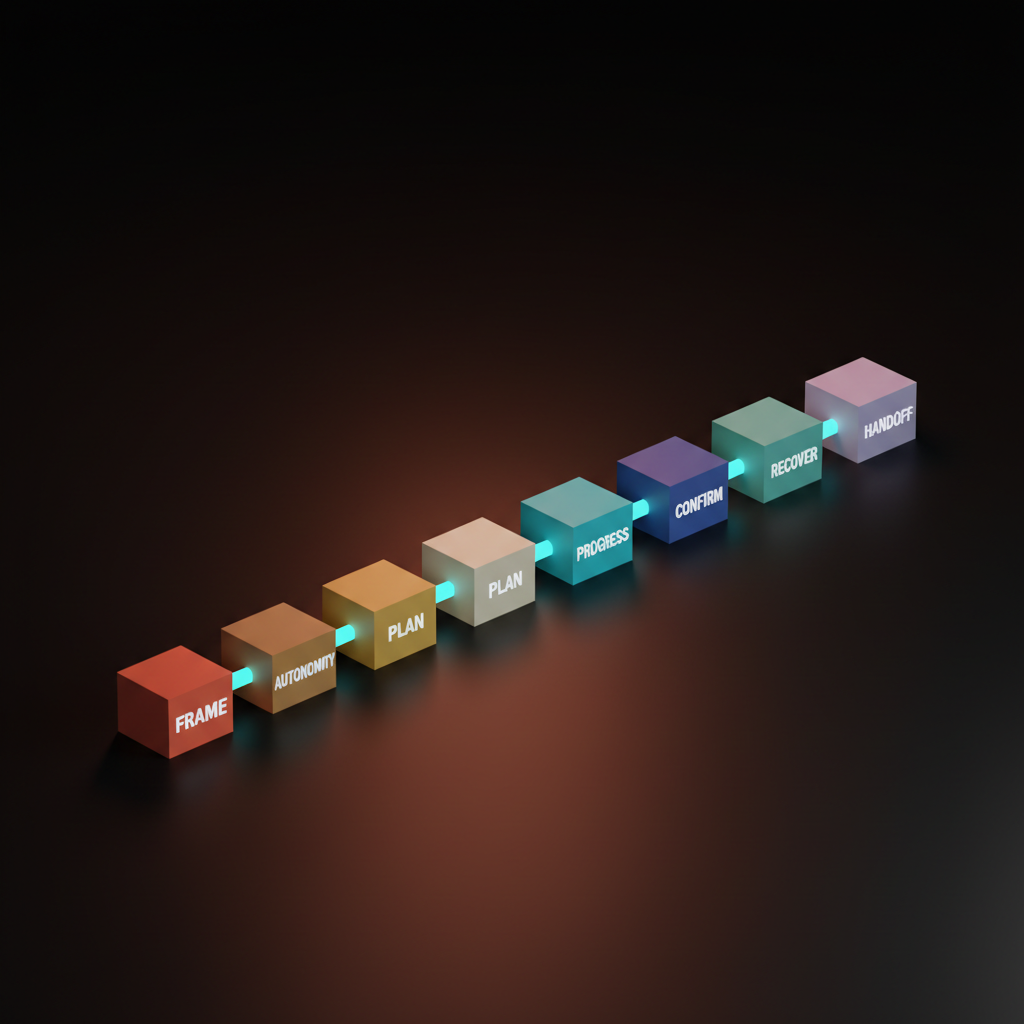

Sept modèles sont présents dans toute interface d'agent digne de ce nom : le cadrage des tâches, les contrôles d'autonomie, la surface de planification, le flux de progression, les points de confirmation, la gestion des erreurs et les transferts d'agents. La plupart des produits actuels n'en proposent que quatre sur sept, négligeant les trois autres. Il en résulte une interface performante en démonstration, mais qui se révèle inadaptée à l'utilisation réelle.

Cet article apporte une solution opérationnelle. Les sept modèles, huit analyses de code issues de Claude Code, Cursor, Devin, Linear AI, ChatGPT Operator, Replit Agent, Bolt et v0, trois bugs courants et leur correction, ainsi qu'une checklist de quinze minutes avant déploiement que tout concepteur peut exécuter avant que l'interface utilisateur ne soit testée par un utilisateur réel.

Les interfaces d'agent sont des surfaces de contrôle, pas des fenêtres de chat

L'interface d'un agent IA est l'interface d'un travailleur autonome. Le problème de conception s'apparente davantage à un poste de pilotage qu'à une conversation. L'utilisateur ne se contente plus d'échanger des messages ; il définit un objectif et supervise un processus.

Une interface de chat est optimisée pour la prise de parole. L'interface d'agent est optimisée pour la clarté de l'objectif, la visibilité du plan, le suivi de la progression et la possibilité de modifier les actions. La plupart des premiers produits d'agent ont commis l'erreur de se contenter d'ajouter au chat quelques indicateurs de « réflexion » et un journal d'utilisation des outils. L'utilisateur restait planté devant une conversation, sans pouvoir consulter le plan, interrompre l'exécution ni rattraper le retard de l'agent. En considérant l'interface de l'agent comme une surface de contrôle, les sept modèles ci-dessous deviennent essentiels.

Les sept modèles indispensables à toute interface d'agent

Cadre de la tâche, curseur d'autonomie, surface de planification, flux de progression, validation, gestion des erreurs et transfert d'agent. Toutes les interfaces d'agent actuelles combinent ces sept éléments.

Le cadre de la tâche permet à l'utilisateur de définir l'objectif. Les contrôles d'autonomie lui permettent de choisir le niveau de liberté accordé à l'agent. La surface de planification permet à l'agent de valider une séquence d'étapes avant d'agir. Le flux de progression affiche en temps réel l'activité de l'agent. La validation correspond au temps de latence avant une action décisive. La gestion des erreurs permet de revenir en arrière après un échec. Le transfert d'agent assure la transition d'une tâche de l'agent à un humain ou d'un agent à un autre, sans perte de contexte.

Ces sept éléments n'ont pas tous la même importance, mais ils sont tous indispensables. Un produit qui propose un cadrage des tâches sans interface de planification est un jeu de devinettes. Un produit qui ne propose que des points de confirmation est une catastrophe annoncée. Ces schémas s'accumulent. En négliger un seul fragilise les autres.

Le cadrage des tâches définit le contrat

Un mauvais cadrage des tâches se présente sous la forme d'une simple fenêtre de discussion où l'utilisateur saisit une phrase vague et où l'agent complète le reste par suppositions. Un bon cadrage des tâches est une entrée structurée qui demande les informations précises dont l'agent a besoin.

Les fonctionnalités d'IA de Linear excellent dans ce domaine. L'utilisateur saisit un bref résumé et l'IA l'analyse pour en faire une tâche structurée avec un titre, une description, des étiquettes et une affectation à un projet que l'utilisateur peut modifier avant validation. Le cadrage est précis, la sortie est structurée et une interface de modification claire est disponible avant validation.

L'interface de cadrage doit être aussi structurée que la tâche elle-même. Une tâche de codage nécessite un objectif, un fichier cible et un critère d'acceptation. Une tâche d'automatisation web requiert une URL de départ, une action cible et une condition d'arrêt. Les entrées de chat génériques conviennent à l'exploration, mais sont inadaptées à la production.

Les contrôles d'autonomie permettent à l'utilisateur de maîtriser le processus

La confiance n'est pas acquise et un seul paramètre ne peut pas couvrir toutes les situations.

Claude Code y remédie grâce à son système d'autorisations. L'utilisateur peut choisir un mode où chaque appel d'outil requiert une approbation, les outils courants sont approuvés automatiquement et les outils à risque restent soumis à une vérification, ou bien une autonomie totale. Le mode est visible, modifiable en cours de session, et l'utilisateur sait précisément quel niveau d'autorisation est appliqué à l'agent.

La plupart des produits intègrent un seul paramètre d'autonomie, sans contrôle par tâche ni visibilité sur l'état. L'utilisateur ignore si l'agent demandera une autorisation avant un déploiement, une suppression ou l'envoi d'un e-mail. Cette incertitude incite les utilisateurs à une surveillance excessive ou à une confiance aveugle. Ces deux attitudes sont vouées à l'échec.

La surface de planification est la première promesse de l'agent

Avant d'agir, l'agent doit indiquer son intention. Le plan doit être lisible, modifiable et rejetable.

Devin a déployé l'une des premières surfaces de planification fonctionnelles. L'agent génère un plan ; l'utilisateur peut modifier chaque étape directement, en supprimer ou en ajouter, ou rejeter le plan entier. Une fois approuvé, le plan devient le journal d'exécution, chaque étape étant mise en évidence pendant son traitement par l'agent. La surface de planification et le flux de progression sont identiques dans deux états : avant exécution et pendant l'exécution. Ce choix architectural est optimal.

Un bug courant : certains produits affichent le plan sous forme de paragraphe au lieu d'une liste structurée. Le plan n'est pas modifiable, ce qui oblige l'utilisateur à l'approuver sans confirmation ou à demander une nouvelle confirmation. La solution consiste à structurer le plan automatiquement : une liste d'étapes distinctes, chaque étape correspondant à une ligne, chaque ligne étant modifiable.

Le flux de progression : la boucle de confiance

L'agent travaille et l'utilisateur attend. Le flux de progression est donc le seul rempart entre l'utilisateur et la décision d'interrompre l'exécution.

L'interface de l'agent Cursor gère cela correctement. Pendant que l'agent modifie des fichiers, les différences s'affichent en direct dans l'éditeur. Lorsqu'il exécute des commandes, la sortie du terminal est diffusée en temps réel. L'utilisateur peut interrompre la consultation à tout moment et revenir à un journal complet. La confiance est de courte durée car le flux est transparent.

Comparez cela à un agent qui diffuse un résumé de type conversationnel, du type « J'examine actuellement la prochaine étape », tout en exécutant discrètement dix appels d'outils en arrière-plan. Ce résumé est trompeur. Consignez chaque appel d'outil et chaque modification de fichier dans un journal structuré et condensez le raisonnement du modèle en un résumé d'une ligne par étape. Toute confusion entre les deux compromet la confiance.

Des portes de confirmation protègent les actions irréversibles

Certaines actions sont irréversibles et l'interface utilisateur doit volontairement ralentir ces moments.

ChatGPT L'opérateur gère cela sur le web ouvert. Lorsqu'un agent s'apprête à soumettre un formulaire, à saisir des informations de paiement ou à effectuer une action touchant un compte, une pause est affichée et l'utilisateur est invité à approuver, modifier ou annuler l'opération. Cette pause est visible, l'action est décrite en clair et l'utilisateur peut reprendre le contrôle de la session de navigation.

La plupart des produits commettent l'erreur de traiter chaque action avec le même niveau de confirmation. Soit tout est soumis à une vérification, ce qui habitue les utilisateurs à cliquer sans lire, soit rien n'est vérifié, permettant ainsi à l'agent d'effectuer des actions irréversibles. Il est recommandé de classer les actions en trois niveaux d'intensité : vérification simple pour les modifications réversibles (une bannière d'annulation de trente secondes) ; vérification stricte pour les actions destructives (une fenêtre modale de confirmation) ; vérification en deux étapes pour les actions critiques (une fenêtre modale et une phrase de confirmation écrite).

La gestion des erreurs représente la moitié du produit

Les agents rencontrent constamment des erreurs, et les produits perçus comme fiables sont ceux dont les mécanismes de récupération sont les plus clairs, et non ceux qui affichent les taux de réussite les plus élevés.

Bolt et v0 excellent dans ce domaine. Lorsqu'une compilation échoue, l'erreur s'affiche directement dans le code, l'agent tente de la corriger, et l'utilisateur peut laisser le processus se poursuivre ou intervenir et modifier directement le code. L'état est préservé entre les tentatives.

La plupart des produits échouent à ce niveau. Une erreur survient, l'agent s'arrête, l'utilisateur reçoit le message « Une erreur s'est produite, veuillez réessayer » sans aucune information sur l'état du système. Chaque erreur doit être accompagnée d'un statut clair, d'un ensemble d'options de récupération (réessayer, modifier, reprendre le contrôle, abandonner) et d'une garantie de préservation de l'état. Les erreurs sont le mode d'utilisation normal d'un agent en conditions réelles, et non un événement exceptionnel.

Les transferts d'agents nécessitent une trace écrite

Lorsqu'une tâche passe d'un agent à un utilisateur, ou d'un agent à un autre, le destinataire doit disposer de l'état complet du système sans avoir à le demander.

Les fonctionnalités d'IA de Linear gèrent cela en intégrant des mises à jour structurées dans le ticket. Le prochain membre de l'équipe dispose ainsi du contexte complet. Pas de tableau de bord séparé, pas d'outil supplémentaire. Chaque transmission doit générer un document récapitulatif (un commentaire structuré, un résumé généré, un point de contrôle enregistré) que le destinataire peut lire en moins de trente secondes. Si le destinataire doit demander « où en étiez-vous ? », la transmission a échoué. La même rigueur que celle exigée par Ingénierie rapide pour les concepteurs pour tout flux de travail réutilisable.

Huit interfaces utilisateur d'agent réelles, annotées

Ces modèles ne sont pertinents que s'ils résistent à l'épreuve des produits déployés. Huit sont actuellement en production, chacune étant encore en développement et aucune n'étant parfaite.

Claude Code, interface utilisateur d'agent comme terminal transparent

Claude Code est l'interface utilisateur d'agent la plus épurée à ce jour, car elle considère le terminal comme une surface d'affichage et refuse de masquer l'activité de l'agent. Chaque appel d'outil est redirigé vers le terminal, chaque modification de fichier affiche une différence, chaque commande affiche son résultat. L'avantage principal est l'honnêteté. Le point faible : l'interface du plan est au format Markdown et non modifiable comme une liste structurée.

Cursor, interface utilisateur pour la programmation en binôme ambiante

L'agent de Cursor est quasiment invisible jusqu'à ce qu'on en ait besoin, ce qui représente le summum de la conception d'interfaces utilisateur pour agents. Les petites modifications sont instantanées et affichent un diff. Les refactorisations multi-fichiers font apparaître un plan. L'avantage principal est la gestion de la présence : Cursor ajuste la visibilité de l'agent à la tâche. Le point faible : l'interface du plan pour les refactorisations complexes ressemble davantage à une conversation qu'à une liste de tâches modifiable.

Devin, interface utilisateur pour l'agent comme un espace de travail interactif

Devin affiche l'espace de travail complet de l'agent, incluant un navigateur, un terminal et un éditeur en direct. Le pari est que la transparence instaure la confiance plus rapidement que l'abstraction. Un plan structuré et modifiable est visible dès le départ. L'espace de travail entier constitue le flux de progression. L'utilisateur peut prendre le contrôle à n'importe quel niveau. L'avantage principal est la visibilité totale. Le point faible : l'espace de travail est lourd pour les tâches simples.

Linear IA, interface utilisateur de l'agent comme assistant intégré

Les fonctionnalités d'IA de Linear sont intégrées à l'interface existante de Linear, ce qui constitue le modèle idéal pour les agents intégrés qui doivent fonctionner comme un membre de l'équipe, et non comme une application distincte. L'IA renvoie un élément structuré (un problème, un commentaire, une mise à jour de statut) qui s'intègre au flux existant. L'avantage principal réside dans l'intégration. Le point faible : les tâches autonomes en plusieurs étapes nécessitent une interface de planification et un flux de progression. Linear n'est pas encore disponible.

ChatGPT Opérateur, interface utilisateur de l'agent comme navigateur supervisé

L'opérateur s'exécute dans un navigateur isolé que l'utilisateur peut observer, mettre en pause et reprendre en main. Ce modèle est idéal pour les agents qui interagissent avec le Web. Le navigateur en direct constitue le flux de progression. Les paiements et les actions sur les comptes sont contrôlés. L'avantage principal réside dans le modèle du navigateur supervisé lui-même, qui privilégie la confiance à la vitesse. Points faibles : la surface de planification est gérée par le chat, déconnectée du flux de progression, ce qui complique inutilement les corrections en cours d'exécution.

Replit Agent, Bolt et v0 : l'interface utilisateur de l'agent comme canevas de construction

Replit Agent, Bolt et v0 proposent tous le même modèle : une invite à gauche, un aperçu en direct à droite, et l'agent effectue son travail entre les deux. L'utilisateur décrit ce qu'il souhaite construire, l'agent s'exécute jusqu'à l'affichage d'un aperçu. Le point fort est le canevas de construction, qui concrétise la tâche abstraite de « créer une application ». Points faibles : Replit Agent masque trop d'informations dans son thread d'agent. La surface de planification de Bolt pour les applications complexes est limitée. La boucle d'itération de v0 pour les modifications multi-composants ressemble davantage à une conversation qu'à un plan structuré. Lovable, dans la même veine, propose une surface de planification plus robuste, mais un flux de progression moins performant.

Vous souhaitez une interface utilisateur d'agent qui inspire confiance dès la première utilisation, et non à la dixième ? Embaucher Brainy AppBrainy fournit une interface utilisateur pour agents destinée aux équipes développant des outils autonomes. ClaudeBrainy, quant à lui, propose Claude Compétences et des bibliothèques d'invites qui optimisent la couche agent avant même que l'interface utilisateur n'ait à s'en préoccuper.

Trois bugs courants des interfaces utilisateur d'agents et leurs solutions

La plupart des interfaces utilisateur d'agents présentent les mêmes trois bugs, et les solutions sont loin d'être simples.

Premièrement : L'agent qui masque le plan. Le produit prend un objectif, s'exécute en arrière-plan et affiche un résultat. L'utilisateur n'a aucun plan à consulter, aucun moyen de suivre la progression, ni aucune possibilité d'interrompre l'exécution. Solution : afficher un plan structuré et modifiable avant l'exécution, même sur deux lignes. Le coût ? Vingt pixels d'interface en moins. L'avantage ? L'utilisateur peut corriger l'agent avant qu'il ne produise un résultat erroné.

Deuxièmement : L'agent qui confirme tout. Le produit conditionne chaque action par une fenêtre modale, incitant l'utilisateur à cliquer sans lire les informations. Résultat : lorsqu'une action destructive survient, l'utilisateur clique également sur cette fenêtre. Solution : classer les actions en réversibles, destructives et catastrophiques. Bloquer uniquement les deux dernières et autoriser les actions réversibles avec un bandeau d’annulation de trente secondes.

Troisièmement : l’agent qui masque les défaillances. Le produit effectue des tentatives de redémarrage silencieuses, ignore les erreurs ou signale un « problème survenu » sans préciser la cause. Solution : afficher chaque erreur avec le point de défaillance, l’état du système et des options de récupération concrètes. La confiance repose sur la transparence des défaillances, et non sur leur dissimulation.

Chaque correction n’implique pas une refonte complète. Il s’agit d’ajouter ou de supprimer une interface jusqu’à ce que les modèles fonctionnent correctement. La plupart des bugs d’interface des agents sont des problèmes de modèles déguisés en problèmes de conception.

Checklist de quinze minutes avant déploiement

Exécutez cette checklist sur n’importe quelle interface d’agent avant sa mise en production et vous identifierez les modèles défaillants.

-

Formulation de la tâche. Saisissez un objectif type. La saisie impose-t-elle une structure suffisante à l’agent pour agir ?

-

Visibilité de l’autonomie. Pouvez-vous deviner en une seconde ce que l’agent va faire sans poser de questions ? 3. Plan d'exécution. Exécutez une tâche complexe. L'agent affiche-t-il un plan structuré et modifiable avant d'agir ?

-

Transparence de la progression. Les appels d'outils et les modifications de fichiers sont-ils visibles, ou le flux se limite-t-il à un résumé de type conversation ?

-

Possibilité de pause. Essayez de mettre en pause un agent en cours d'exécution. Le bouton de pause est-il visible et immédiatement accessible ?

-

Gestion des confirmations. Les actions réversibles s'exécutent-elles librement ? Les actions destructives sont-elles conditionnées par une fenêtre modale ? Les actions critiques nécessitent-elles une confirmation écrite ?

-

Visibilité des erreurs. Provoquez une erreur. L'interface utilisateur affiche-t-elle l'erreur avec un état et des options de récupération ?

-

Possibilité d'annulation. Existe-t-il une procédure d'annulation claire dans les trente secondes suivant une action réversible ?

-

Conservation de l'état. En cas d'échec d'une étape, réessayez. Le travail précédent est-il conservé ?

-

Document de transfert. Arrêtez une tâche en cours d'exécution. Un fichier d'état est-il disponible pour permettre à la personne suivante de reprendre l'exécution ?

-

Journal d'utilisation des outils. Le journal est-il structuré et lisible par machine, ou mélange-t-il raisonnement et actions ?

-

Bouton d'arrêt d'urgence. Est-il toujours visible, ou est-il caché dans un menu de paramètres ?

Un produit qui réussit ces douze tests possède une interface utilisateur fonctionnelle pour l'agent. L'utilisateur saura ce que fait l'agent et comment l'arrêter.

FAQ

Qu'est-ce que la conception d'interface utilisateur pour agents IA ?

La conception d'interface utilisateur pour agents IA consiste à créer des interfaces pour les agents IA autonomes qui définissent un objectif, planifient des étapes et exécutent des outils sans approbation à chaque étape. Contrairement aux interfaces de chat, les interfaces utilisateur pour agents sont des surfaces de contrôle avec sept modèles principaux : cadrage des tâches, contrôles d'autonomie, surfaces de planification, flux de progression, points de confirmation, gestion des erreurs et transferts d'agents.

Quelle est la différence entre une interface utilisateur pour agent IA et une interface utilisateur pour chatbot ?

Une interface utilisateur pour chatbot suppose une conversation séquentielle. Une interface utilisateur pour agent suppose que l'agent s'exécute en arrière-plan, exécute plusieurs appels d'outils, modifie son état et signale lorsqu'une intervention humaine est nécessaire. Les interfaces utilisateur des agents nécessitent des surfaces de planification, des flux de progression en temps réel, des portes de confirmation et des boutons d'arrêt d'urgence, contrairement aux interfaces de chat.

Quels sont les modèles clés pour la conception d'interfaces d'agents IA ?

Sept modèles : cadrage des tâches, contrôles d'autonomie, surface de planification, flux de progression, portes de confirmation, gestion des erreurs et transferts d'agent. Dimensionnés en fonction de la tâche, calibrés pour la confiance et soutenus par une forte intégration (LINK3) au niveau du modèle.

Quels produits d'agents IA offrent la meilleure conception d'interface utilisateur ?

BRAND4 l'emporte en matière de transparence. Cursor l'emporte en matière de calibration de présence. Devin l'emporte en matière de visibilité de l'espace de travail. BRAND12 l'emporte en matière d'intégration. BRAND16 l'emporte en matière d'exécution supervisée. Replit Agent, Bolt et v0 l'emportent en matière de canevas de construction. Aucun ne maîtrise pleinement les sept modèles, ce qui explique pourquoi cette catégorie reste encore très ouverte.

Comment équilibrer autonomie et contrôle dans une interface utilisateur d'agent ?

Faites de l'autonomie un paramètre visible et ajustable par session, par tâche et par outil. Classez les actions en trois catégories : réversibles (exécution libre avec possibilité d'annulation), destructives (vérification par une fenêtre modale) et catastrophiques (vérification par confirmation écrite). Affichez le plan d'exécution avant et la progression pendant l'exécution. Permettez à l'utilisateur de mettre en pause, de reprendre le contrôle ou d'interrompre l'exécution à tout moment. La confiance se construit avec la capacité de contrôle, et non avec une complexité cachée.

Le véritable potentiel des interfaces utilisateur d'agent

Une interface utilisateur d'agent n'est pas un simple outil de messagerie instantanée auquel on a ajouté de l'autonomie ; c'est un nouveau modèle d'interaction, et les produits qui l'intègrent pleinement sont ceux qui réussissent.

La plupart des équipes considèrent l'interface utilisateur d'agent comme une fonctionnalité supplémentaire. Elles prennent une conversation, ajoutent un indicateur de « réflexion », quelques bulles d'outils, et appellent cela un agent. Le résultat ? Un chatbot avec une latence accrue. Chaque erreur de la messagerie instantanée amplifie les dégâts, car l'agent s'exécute plus longtemps et les conséquences d'une panne sont plus graves.

Le changement consiste à considérer l'agent comme un travailleur autonome et l'interface utilisateur comme son interface de contrôle. La conversation devient un élément d'une interface plus vaste comprenant un tableau de planification, un flux de progression, un bouton d'autonomie, une fenêtre de confirmation, une console d'erreurs et un indicateur de transfert. L'utilisateur n'est plus le partenaire de conversation de l'agent, mais son superviseur.

Si votre équipe déploie un agent que les utilisateurs surveillent de manière excessive ou lui font aveuglément confiance, le problème réside presque toujours dans un problème de comportement. La solution ? Les sept modèles mentionnés précédemment, adaptés à la tâche, calibrés pour instaurer la confiance et intégrés à une véritable interface utilisateur (Flux de travail de conception d'IA) plutôt que d'y ajouter des éléments superflus.

Si vous souhaitez une interface utilisateur pour agent qui inspire confiance dès la première utilisation, et non après dix essais (embauche Brainy), AppBrainy propose une interface utilisateur complète pour les équipes développant des outils autonomes. ClaudeBrainy propose des workflows Claude Code, des packs de compétences et des bibliothèques d'invites qui optimisent la couche agent afin que l'interface utilisateur n'ait pas à compenser.

Want an agent UI that earns trust on the first run, not the tenth? Brainy ships ClaudeBrainy as a Skill pack and prompt library, and AppBrainy ships full agent product UI for teams building autonomous tools they want their users to actually use.

Get Started