KI-natives Produktdesign: Wie man Produkte entwickelt, die KI in den Vordergrund stellen, nicht KI-gestützte.

Was KI-natives Produktdesign wirklich bedeutet. Sechs Prinzipien, fünf Analysen von Linear, Cursor, Granola, Perplexity und Arc Search, zwei warnende Beispiele für Fehlfunktionen nachträglich integrierter KI sowie eine Checkliste für die Entwicklung von KI-zentrierten Produkten.

Ein KI-natives Produkt ist eines, bei dem ohne das Modell nichts mehr nutzbar ist. Die meisten Produkte, die sich heute als KI-nativ bezeichnen, würden auch ohne KI einwandfrei funktionieren, sind also nicht KI-nativ. Sie sind lediglich nachträglich mit KI ausgestattet, und der Unterschied liegt nicht im Branding, sondern in der Architektur.

Der aussagekräftigste Test ist der Löschtest. Öffnen Sie das Produkt und löschen Sie gedanklich jeden Modellaufruf, jedes Chat-Panel, jeden Glitzerbutton und jede Zeile mit der „KI-Zusammenfassung“. Was bleibt übrig? Wenn das Ergebnis ein voll funktionsfähiges Produkt ist, das lediglich einige Details eingebüßt hat, handelt es sich um nachträglich hinzugefügte KI. Wenn das Ergebnis eine leere Hülle ist, die ihre grundlegende Funktion verloren hat, ist das Produkt KI-nativ. Linear besteht den Löschtest nur auf den neueren Oberflächen. Cursor fällt sofort durch, da ohne das Modell nichts mehr übrig ist. Die meisten Enterprise-SaaS-Lösungen, die 2024 eine Chat-Seitenleiste eingeführt haben, bestehen den Löschtest, da nichts Wichtiges verloren geht – und genau das ist der entscheidende Punkt.

Dieser Artikel ist die praktische Umsetzung dieses Tests. Die sechs Prinzipien, die KI-nativ von nachträglich hinzugefügter KI unterscheiden, fünf reale Produktanalysen von Linear, Cursor, Granola, Perplexity und Arc Search, die zeigen, wie jedes Prinzip umgesetzt wird, zwei warnende Beispiele von Produkten, die KI nachträglich in ein Seitenmenü integriert haben und damit keinen Nutzen erzielten, sowie eine Checkliste für die Vorveröffentlichung, die jedes Team vor dem Release auf einer funktionierenden Version durchführen kann.

KI-nativ bedeutet, dass das Modell das Produkt ist, nicht nur eine Funktion

Der Begriff „KI-nativ“ wird heutzutage inflationär für jedes Produkt mit dem OpenAI-Logo und einem entsprechenden Marketing-Effekt verwendet, was seine Aussagekraft stark beeinträchtigt hat. Eine präzisere Definition ist hilfreich: Bei einem KI-nativen Produkt bildet das Modell die primäre Oberfläche, während die restliche Benutzeroberfläche dazu dient, das Modell nutzbar, nachvollziehbar und schnell zu machen. Chat-Panel, Formularfelder, Dashboards und Seitenleisten dienen lediglich als Gerüst. Das Modell bildet die tragende Wand.

Das klingt einleuchtend, bis man sich ansieht, wie Produkte tatsächlich auf den Markt gebracht werden. Das gängige Enterprise-Muster von 2024 sieht vor, das bestehende Dashboard beizubehalten und ein Chat-Panel am rechten Rand anzufügen. Das Modell ist zwar im Produkt vorhanden, aber das Produkt ist nicht darauf ausgelegt. Der Benutzer kann das Chat-Panel ignorieren und alle Aufgaben mit der ursprünglichen Benutzeroberfläche erledigen. Das ist die Definition von nachträglich hinzugefügter KI, egal wie auffällig das Symbol auch sein mag.

Die KI-native Version desselben Produkts hätte den primären Workflow um das Modell herum neu aufgebaut. Das Dashboard wird zur Eingabeaufforderung. Das Formular wird zum Dialog. Der Export wird zur Datengenerierung. Das Modell ist nicht länger etwas, das man ignorieren kann, sondern es ist die Oberfläche selbst. Ein solches Produkt ist deutlich schwieriger auf den Markt zu bringen, weshalb sich die meisten Teams mit der nachträglich hinzugefügten Lösung zufriedengeben.

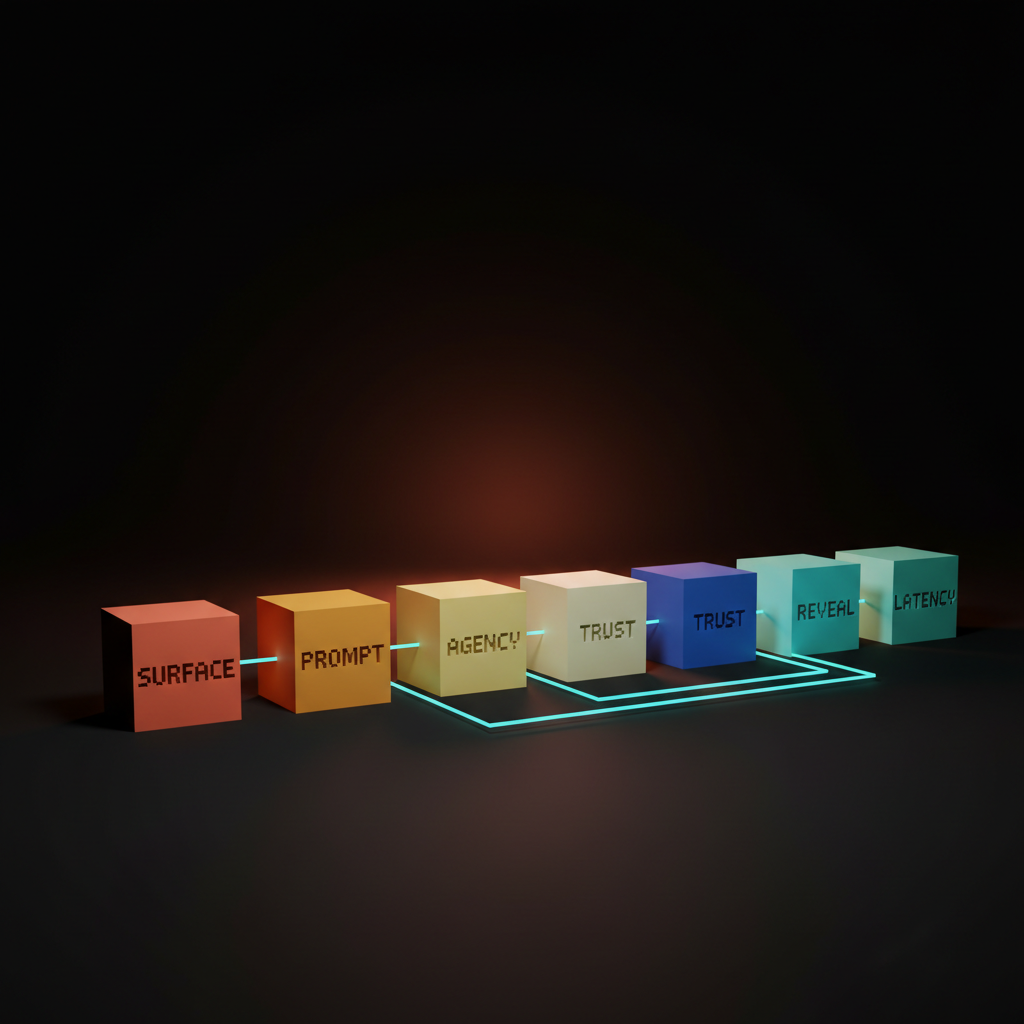

Die sechs Prinzipien des KI-nativen Produktdesigns

Modell als zentrale Oberfläche, Eingabeaufforderung als Eingabe, standardmäßige Handlungsfähigkeit, transparente Oberflächen, bewusste Modelldarstellung und Latenz als Designbeschränkung Jedes KI-native Produkt, das es wert ist, genauer betrachtet zu werden, beinhaltet eine Kombination dieser sechs Prinzipien.

Die Prinzipien sind keine Checkliste im herkömmlichen Sinne, bei der das Erfüllen von vier von sechs Punkten ein Produkt automatisch als KI-nativ kennzeichnet. Sie beschreiben vielmehr eine grundlegende Haltung. Ein Team, das das Modell von Anfang an als zentrale Benutzeroberfläche betrachtet, wird die meisten dieser Prinzipien automatisch erreichen. Ein Team, das das Modell erst im zwölften Sprint als Feature hinzufügt, wird an allen scheitern und letztendlich nur eine Chat-Seitenleiste ausliefern.

Die folgenden Prinzipien sind als Entscheidungen und nicht als Features formuliert. Jedes Prinzip hat eine Standardhaltung für ein KI-natives Produkt und eine Standardhaltung für ein Produkt, das KI nachträglich integriert. Der Unterschied zwischen diesen beiden Haltungen ist das, was Cursor von jedem Texteditor mit einem Copilot-Plugin unterscheidet.

Modell als zentrale Benutzeroberfläche, nicht als Seitenleiste

Das erste Prinzip ist das einfachste und wird am häufigsten missachtet, denn jede Enterprise-SaaS-Lösung, die eine Chat-Seitenleiste ausliefert, scheitert von Anfang an an diesem Prinzip.

Zentrale Benutzeroberfläche bedeutet, dass das Modell das Erste ist, wonach der Benutzer greift, wenn er das Produkt öffnet. Das Seitenpanel bedeutet, dass das Modell neben der bestehenden Benutzeroberfläche platziert ist, bei Bedarf verfügbar ist und standardmäßig ignoriert wird. Perplexity ist die Kernoberfläche. Notion Der Slash-Befehl der KI ist im Schreibkontext größtenteils Kernoberfläche. Cluely ist als Overlay auf dem gesamten Bildschirm Kernoberfläche. Das Chat-Symbol, das rechts neben jedem Standard-SaaS-Dashboard angedockt ist, ist das Idealbild eines Seitenpanels.

Der Test besteht darin, wo der Benutzer landet, wenn er das Produkt zum ersten Mal öffnet. Wenn er als Erstes ein Eingabefeld, eine Antwortoberfläche oder eine modellgesteuerte Hauptansicht sieht, ist das Produkt Kernoberfläche. Wenn er als Erstes das ursprüngliche Dashboard mit einem Chat-Symbol in der Ecke sieht, ist das Produkt Seitenpanel, und die KI wird von allen Benutzern nach der ersten Sitzung ignoriert.

Die Lösung für ein bestehendes Produkt ist nicht subtil. Das Chat-Panel kann nicht rechts angedockt bleiben. Das Modell muss entweder die Hauptoberfläche ersetzen oder als erstklassige Aktion in den zentralen Workflow integriert werden. Das ist eine Neugestaltung, keine neue Funktion. Deshalb lehnen die meisten Teams dies ab und liefern stattdessen die Seitenleiste aus.

Eingabeaufforderung ersetzt Formulareingabe

Das zweite Prinzip ist das Eingabemodell selbst. Natürliche Sprache ersetzt hier Dropdown-Menüs, mehrstufige Assistenten und Formulare im leeren Zustand.

Bei der Eingabeaufforderung tippt der Benutzer seine Eingabe in eigenen Worten ein, und das Modell ermittelt die Struktur. Bei der Formulareingabe füllt der Benutzer die vordefinierten Felder des Produkts aus, und das Modell hat nichts zu tun. Die Cmd-K-Taste von Cursor ist ein Beispiel für Eingabeaufforderung. Die Befehlspalette von Linear in Kombination mit KI ist ebenfalls ein Beispiel. Perplexity ist das gesamte Produkt als Eingabeaufforderung. Das Bildeingabefeld von Krea ist eine Eingabeaufforderung mit Referenzbildern. Lovable ist ein Beispiel für Eingabeaufforderung, das die gesamte Anwendung aus einem Satz generiert.

Formulare als Eingabefeld sind nicht immer falsch. Manche strukturierte Daten gehören tatsächlich in ein Formular, und jede Interaktion über eine Eingabeaufforderung zu erzwingen, ist ein Designfehler. Die richtige Herangehensweise besteht darin, zu prüfen, welche Eingaben das Modell besser verarbeiten kann als ein Formular, und diese Formulare zuerst zu ersetzen. Konfigurationsbildschirme, Suchfilter, Berichtsgeneratoren und Abfrageschnittstellen sind dafür ideale Kandidaten. Name, E-Mail-Adresse und Kreditkartendaten des Benutzers hingegen nicht.

Der Fehler, den die meisten Produkte mitbringen, ist, dass sie jedes Formular beibehalten und eine Eingabeaufforderung als alternativen Einstiegspunkt hinzufügen. Der Benutzer muss nun zwei Wege lernen, um dasselbe zu tun, was schlechter ist als jeder Weg allein. Die Eingabeaufforderung sollte das Formular ersetzen, nicht parallel dazu existieren, und das Team sollte bereit sein, das Formular zu ersetzen, sobald die Eingabeaufforderung besser ist.

Eigenständiges Handeln bedeutet, dass das Produkt handelt, anstatt zu fragen

Das dritte Prinzip ist die Autonomie: KI-basierte Produkte erledigen die Arbeit, ohne auf eine Erlaubnis zu warten, während KI-gestützte Produkte bei jedem Tastendruck eine Bestätigung anfordern.

„Agency by default“ bedeutet, dass das Produkt die Aktion ausführt, sobald der Nutzer seine Absicht äußert, anschließend die Ergebnisse anzeigt und dem Nutzer die Möglichkeit gibt, diese rückgängig zu machen. „Permission by default“ bedeutet, dass das Produkt anbietet, die Aktion auszuführen, der Nutzer auf „Bestätigen“ klickt, das Produkt erneut fragt und der Nutzer schließlich aufgibt. Der Cursor-Agent bearbeitet Dateien ohne Rückfrage. Granola transkribiert und ergänzt Notizen ohne Rückfrage. Die Suche durchsucht, fasst zusammen und präsentiert Ergebnisse ohne Rückfrage. Das Produkt handelt, anstatt zu verhandeln.

Der Zielkonflikt ist real. „Agency by default“ benötigt eine Rückgängig-Funktion, einen Prüfpfad und eine transparente Darstellung der Aktionen des Modells. Fehlen diese, wird „Agency by default“ feindselig, das Produkt führt Aktionen aus, die der Nutzer nicht wollte, und das Vertrauen schwindet. Die Kunst besteht darin, „Agency by default“ zusammen mit der Wiederherstellungsfunktion bereitzustellen, nicht nur „Agency by default“ und darauf zu hoffen, dass alles gut geht. Derselbe Zielkonflikt gilt für die umfassendere Diskussion, bei der der Autonomie-Regler ein wichtiges Steuerungsinstrument darstellt.

Die vorsichtige Variante ist das Produkt, das bei jeder Aktion fragt: „Möchten Sie, dass ich …?“ Jede Bestätigung kostet einen Klick, unterbricht den Arbeitsfluss und signalisiert, dass das Modell vom Entwicklerteam nicht wirklich vertraut wird. Wenn das Team dem Modell nicht vertraut, wird es auch der Nutzer nicht tun, und die Agentur sollte ihre Haltung verschärfen, bis die Reibung nicht mehr als Schutz, sondern als Feigheit empfunden wird.

Transparente Oberflächen machen das Modell verantwortlich

Das vierte Prinzip ist die Vertrauensschleife. Das Produkt zeigt auf einer für den Nutzer verständlichen Oberfläche, was das Modell gesehen, entschieden und warum.

Transparenz ist nicht dasselbe wie die Offenlegung der Systemabfrage. Transparenz bedeutet, dass der Nutzer drei Fragen auf Anfrage beantworten kann: Auf welchen Kontext hatte das Modell Zugriff? Welche Aktion hat das Modell durchgeführt? Was hat das Modell erstellt und woher stammen die Quellen? Perplexity liefert dies mit Quellenangaben zu jeder Aussage. Cursor liefert dies mit einer Differenzanzeige bei jeder Bearbeitung. Granola liefert dies mit dem Rohtranskript neben den ergänzten Notizen. Der Nutzer fragt sich nie, ob das Modell etwas erfunden hat, denn die Quelle ist nur einen Klick entfernt.

Das Gegenteil ist das „Zauberkasten“-Muster: Das Modell erzeugt ein Ergebnis, das der Nutzer nicht überprüfen kann. Notion Die ältere Zusammenfassungsfunktion der KI wurde eine Zeit lang so ausgeliefert: Die Zusammenfassung erschien, und der Nutzer musste ihr vertrauen. Die Lösung bestand darin, Quellenangaben und eine Möglichkeit zum Anzeigen des zusammengefassten Inhalts hinzuzufügen. Die Lehre daraus: Transparenz ist bei einem KI-basierten Produkt unerlässlich. Sie ist der Vertrauensmechanismus, der verhindert, dass das Produkt zu einer Illusion wird.

Es ist wichtig, Transparenz von Anfang an zu bieten und sie nicht nachträglich einzubauen, nachdem das Vertrauen bereits geschwunden ist. Ein Produkt, das ohne Quellenangaben ausgeliefert wurde und diese nun hinzufügt, betreibt Schadensbegrenzung. Ein Produkt, das von Anfang an Quellenangaben enthielt, erfüllt seinen Zweck.

Modelldetails standardmäßig ausblenden, bei Bedarf anzeigen

Das fünfte Prinzip betrifft den richtigen Zeitpunkt für die Anzeige von Temperatur, Modellnamen und Systemmeldungen. Die Antwort darauf findet sich fast nie auf der Hauptseite.

Dem Benutzer ist es egal, welche Modellvariante ausgeführt wird. Wichtig ist ihm, dass das Ergebnis gut, schnell und nachvollziehbar ist. Die Anzeige des Modellnamens auf der primären Benutzeroberfläche lässt die Vorstellungen des Produktteams in die des Benutzers durchsickern und signalisiert, dass das Team noch nicht entschieden hat, was das Produkt eigentlich sein soll. ChatGPT präsentierte die Modellauswahl früher prominent, entfernte sie dann aber stillschweigend, da die meisten Benutzer den Unterschied zwischen GPT-4-Turbo und GPT-4o nicht kannten und die Auswahlmöglichkeit eher zu Entscheidungslähmung als zu einem Mehrwert führte.

Eine Ausnahme bildet die Benutzeroberfläche für fortgeschrittene Benutzer. Cursor bietet die Modellauswahl an, da die Benutzer Entwickler sind, die diese Wahlmöglichkeit wünschen. Claude Code bietet die Modellauswahl aus demselben Grund an. Krea zeigt die Generierungsparameter an, da die Benutzer diese anpassen möchten. Das Muster besteht darin, Modelldetails standardmäßig auf der Benutzeroberfläche auszublenden und sie dann in einem Einstellungsmenü oder einem erweiterten Modus für Benutzer anzuzeigen, die diese Kontrolle explizit wünschen.

Der Fehler liegt darin, dass die Modellauswahl auf dem Startbildschirm eines Produkts angezeigt wird, dessen Zielgruppe die Modelle nicht kennt. Jede Produktpräsentation zeigt die Modellauswahl noch immer im Hero-Screenshot. Bei den meisten dieser Produkte wäre es besser, sie auszublenden und dem Team die Navigation zum richtigen Modell unauffällig zu gestalten.

Latenz ist eine zentrale Designbedingung

Das sechste Prinzip besagt, dass sich ein KI-basiertes Produkt langsam anfühlt, wenn das Modell länger als zwei Sekunden zum Starten der Datenverarbeitung benötigt. Das Design muss diese Wahrnehmung korrigieren, bevor die Entwicklung eingreift.

Latenz ist nicht nur eine Leistungskennzahl, sondern der Rhythmus des Produkts. Eine zweisekündige Pause vor dem ersten Token ist Leerlauf, und der Nutzer füllt diese Zeit mit Zweifeln. Die Lösung besteht in einer Kombination aus der schrittweisen Ausgabe der Antwort (sodass der Nutzer sofort eine Bewegung sieht), der Anzeige eines Skelett- oder Schimmerzustands, der eine baldige Antwort signalisiert, und der sofortigen Anzeige von Teilergebnissen. Perplexity und Cursor setzen alle drei Maßnahmen um. Die meisten Chat-Sidebars von Enterprise-SaaS erfüllen keine dieser Anforderungen und wirken bei jeder Interaktion fehlerhaft.

Die daraus resultierende Designvorgabe ist, dass das Produkt nicht ohne Tests der tatsächlichen Latenz des Modells entwickelt werden kann. Ein Prototyp, der mit einem schnellen Mock-Modell getestet wird, deckt die Latenzprobleme nicht auf, und das Team liefert ein Produkt aus, das in der Designprüfung funktionierte, sich im Produktivbetrieb aber langsam anfühlt. Die Disziplin besteht darin, von Anfang an mit der realen Latenz des ersten Prototyps zu designen und dann entweder die Wahrnehmung zu korrigieren oder die Architektur so lange anzupassen, bis die Performance stimmt.

Fünf KI-basierte Produkte, kommentiert

Die Prinzipien sind nur dann relevant, wenn sie sich im praktischen Einsatz bewähren. Hier sind fünf Beispiele, die es heute schon richtig machen.

Jede Analyse ist kurz und prägnant. Sie zeigt, was das Produkt in Bezug auf jedes Prinzip leistet, wo es seine Stärken hat und wo es Potenzial verschenkt. Keines dieser Produkte ist perfekt. Alle arbeiten jedoch deutlich über dem Standard für KI-basierte Zusatzfunktionen, was sie so interessant macht.

Linear, KI-nativ als unauffällige Befehlsoberfläche

Die KI von Linear ist unsichtbar, bis Sie sie aktivieren. Dann ist sie der schnellste Weg zu jeder Aktion im Produkt.

Oberfläche: Die KI ist in die bestehende Befehlsleiste integriert, die bereits von Linear-Power-Usern hauptsächlich genutzt wird. Das Modell bildet somit die zentrale Oberfläche für die relevante Zielgruppe. Eingabeaufforderung: Reine Eingabeaufforderung über natürlichsprachliche Befehle. Handlungsfähigkeit: Hoch, die KI erstellt Probleme, bearbeitet Beschreibungen und priorisiert diese ohne Rücksprache. Transparenz: Die Aktion ist in der Zeitleiste als normales Linear-Ereignis sichtbar. Offenlegung: Modelldetails sind verborgen, selbst der Auslöser fühlt sich eher wie eine Linear-Funktion als wie eine KI-Funktion an. Reaktionszeit: Blitzschnelle Antworten, sofortige Auslösung.

Hier lässt Linear Geld liegen. Die KI ist hinter dem Aufruf der Befehlsleiste verborgen, wodurch neue Benutzer sie erst spät entdecken. Ein expliziteres, KI-zentriertes Onboarding würde die Akzeptanz bei weniger erfahrenen Nutzern steigern, ohne die gewohnte Ruhe der Power-User zu beeinträchtigen.

Cursor: KI-nativer Editor

Cursor ist das Ergebnis, wenn man aufhört, KI an VS Code anzuhängen und den Editor um das Modell herum neu entwickelt. Das Resultat ist das bisher eleganteste KI-native Entwicklertool.

Oberfläche: Das Modell ist allgegenwärtig – Cmd-K, Agentenmodus, Autovervollständigung, Chat – alles ist in die Editoroberfläche integriert. Eingabeaufforderung: Die Eingabeaufforderung ist die primäre Aktion. Der Editor verfügt zwar weiterhin über Menüs, aber die Eingabeaufforderung übernimmt den Großteil der Arbeit. Handlungsfähigkeit: Im Agentenmodus ist die Handlungsfähigkeit sehr hoch. Das Produkt bearbeitet Dateien, führt Befehle aus und erstellt Diffs. Transparenz: Jede Änderung wird als Diff angezeigt, den der Benutzer überprüft. Jede Aktion wird protokolliert. Offenlegung: Modelldetails werden offengelegt, da die Zielgruppe Entwickler sind, die diese benötigen. Latenz: Streaming, parallele Aufrufe, optimierte Benutzeroberfläche.

Wo Cursor Potenzial verschenkt. Die Benutzeroberfläche im Agentenmodus wirkt in manchen Abläufen immer noch wie ein Chatfenster, das an den Editor angehängt ist, anstatt sich nahtlos in die Benutzererfahrung einzufügen. Eine verbesserte Integration würde Cursor stärker in Richtung Kernoberfläche rücken.

Granola: KI-basierte, unauffällige Transkription mit Intelligenz

Granola behandelt das Modell als Hintergrundschicht, die während der manuellen Notizen des Nutzers aktiv ist und diese nach dem Meeting unauffällig ergänzt.

Oberfläche: Das Modell bildet den gesamten Ergänzungsschritt und ist damit der Hauptnutzen des Produkts. Die Notizoberfläche selbst ist konventionell, bildet aber die Schnittstelle zum Modell. Eingabeaufforderung: Weniger Eingabeaufforderung als üblich, sondern eher Nachbearbeitung, bei der die manuellen Notizen des Nutzers die Grundlage für die Ergänzung bilden. Handlungsfähigkeit: Hoch, die Ergänzung erfolgt automatisch. Transparenz: Das Rohtranskript und die ergänzten Notizen werden nebeneinander angezeigt, der Nutzer kann jede Aussage überprüfen. Offenlegung: Modelldetails bleiben verborgen, der Nutzer weiß nicht, welches Modell zum Einsatz kam. Latenz: Nach dem Meeting, daher ist Latenz kein Echtzeitproblem.

Hier lässt Granola Potenzial ungenutzt. Das Produkt könnte die Eingabeaufforderung stärker nutzen, indem der Nutzer die Erweiterung nach dem Meeting mit einer kurzen Aufforderung steuern kann, anstatt sich ausschließlich auf die stille Standardeinstellung zu verlassen. Diese zusätzliche Möglichkeit würde die KI-basierte Ausrichtung um die redaktionelle Kontrolle des Nutzers erweitern, ohne die bestehende Standardeinstellung zu beeinträchtigen.

Perplexity, KI-basiert als Suchmaschine

Perplexity hat die Suche um ein Modell und eine Antwort herum neu aufgebaut. Eingabe, Oberfläche und Ergebnis sind das Modell.

Oberfläche: Maximale Kernoberfläche, das gesamte Produkt ist das Modell. Aufforderung: Eingabeaufforderung als Eingabe ist das einzige Interaktionsmodell. Handlungsfähigkeit: Mittel, das Modell beantwortet die Frage automatisch, aber der Nutzer steuert weiterhin jede Interaktion explizit. Transparenz: Zitate für jede Aussage, Quellen werden im Text angezeigt, Folgefragen werden eingeblendet. Reveal: Modelldetails sind für Endnutzer größtenteils verborgen, werden aber in professionellen Einstellungen sichtbar. Latenz: Streaming, schnelles erstes Token, Teilergebnisse bei tiefergehenden Suchanfragen.

Wo Perplexity Potenzial ungenutzt lässt. Der agentenbasierte Tiefenrecherchemodus wirkt noch etwas aufgesetzt und könnte besser als Tiefenregler in den Antwortfluss integriert werden, anstatt als separater Modus. Diese Integration würde das Prinzip der Agentenfunktion für Erstnutzer verständlicher machen.

Arc Suche, KI-nativ als Browsertab

Arc Die Suche reduziert den gesamten Such- und Zusammenfassungsprozess auf einen einzigen Klick. Die KI ist der Tab selbst und nicht ein daran angehängtes Panel.

Oberfläche: Das Modell ersetzt die Seite. „Für mich suchen“ liefert eine Antwort, keine Linkliste. Eingabeaufforderung: Eingabeaufforderung über die Adressleiste – die natürlichste Eingabeaufforderung im Browser. Agentur: Sehr hoch. Das Produkt durchsucht mehrere Seiten, fasst sie zusammen und präsentiert ein synthetisiertes Ergebnis ohne Nachfrage. Transparenz: Quellenlinks befinden sich am Ende des synthetisierten Ergebnisses. Offenlegung: Modelldetails vollständig verborgen, die KI ist als Infrastruktur unsichtbar. Latenz: Überraschend schnell für eine mehrseitige Agentenaktion; die kurze Ladezeit trägt zu dieser positiven Wahrnehmung bei.

Wo Arc Search Potenzial verschenkt. Die synthetisierte Antwort kann subtile Fehler aufweisen, und die Transparenzoberfläche (verlinkte Quellen) ist zwar funktional, aber leicht zu übersehen. Eine stärkere Hervorhebung von Quellenangaben im Antworttext würde das Vertrauen stärken, ohne den KI-Charakter zu beeinträchtigen.

Sie wünschen sich ein Produkt, bei dem die KI im Vordergrund steht und nicht nur ein glitzerndes Symbol in der Ecke? Miete Brainy. UXBrainy bietet KI-basierte Produktstrategie- und Design-Audits. AppBrainy liefert eine vollständig KI-native Produkt-UI für Teams, die Tools der Spitzenklasse entwickeln. ClaudeBrainy liefert ein Skill-Paket und eine Prompt-Bibliothek für Teams, die KI-Funktionen wie die Produkte dieser Liste benötigen – und nicht wie eine Chat-Sidebar aus dem Jahr 2024.

Zwei warnende Beispiele für KI-Integration in Seitenleisten

Für jedes KI-basierte Produkt, das Vertrauen gewinnt, gibt es eine Enterprise-SaaS-Lösung, die 2024 eine Chat-Sidebar eingeführt hat, deren Nutzung stagnierte und die sich nun wundert, warum niemand auf das Symbol klickt.

Diese beiden Muster sind derzeit in Unternehmenssoftware weit verbreitet und lassen sich innerhalb der ersten zehn Sekunden der Produktnutzung erkennen. Sie sind die typischen Beispiele für nachträglich integrierte KI-Funktionen, und jedes Team, das eine solche Lösung plant, sollte seine Pläne überdenken, bevor die Präsentation veröffentlicht wird.

Die Chat-Sidebar, die niemand öffnet

Das erste warnende Beispiel ist das KI-Panel, das rechts neben der bestehenden Benutzeroberfläche angedockt ist. Es bietet keinen Mehrwert für den Workflow und beansprucht unnötig Bildschirmplatz.

Die Form ist bekannt. Ein CRM-System, ein Projektmanagement-Tool, ein Helpdesk, ein Analyse-Dashboard – sie alle fügen rechts ein Chat-Panel mit einem Glitzer-Symbol hinzu, das KI-gestützte Unterstützung verspricht. Der Nutzer öffnet es einmal, stellt eine Frage, erhält eine Standardantwort, die den Kontext nicht berücksichtigt, schließt es und öffnet es nie wieder. Das Chat-Panel ist nur deshalb im Produkt, weil das Team es in der Keynote vorgestellt hat, nicht weil die Nutzer es wollten.

Die Lösung besteht nicht darin, das Chat-Panel zu verbessern. Die Lösung besteht darin, das Chat-Panel zu entfernen und den primären Workflow um das Modell herum neu zu gestalten. Ersetzen Sie das Formular durch eine Eingabeaufforderung. Ersetzen Sie den Berichtsgenerator durch eine Generierungsfunktion. Ersetzen Sie die Suchleiste durch eine Antwortoberfläche. Das Modell muss im Arbeitsablauf integriert sein, nicht daneben. Teams, die sich dieser Neugestaltung verweigern, werden weiterhin Chat-Seitenleisten veröffentlichen und sich wundern, warum ihre KI-Nutzung nur ein Prozent beträgt.

Der Glitzer-Button, der Dinge zusammenfasst, die niemand zusammenfassen wollte

Das zweite Warnsignal ist der Zauberstab, der an jedes Textfeld angebracht ist. Die KI bietet an, jede Eingabe umzuschreiben, zusammenzufassen oder zu erweitern, während der Nutzer weiter tippt.

Das Problem: Jedes Formularfeld, jedes Texteingabefeld, jedes Kommentarfeld erhält einen kleinen Glitzer-Button mit KI-Unterstützung. Das Team hat ihn eingeführt, weil es einfach war. Der Nutzer ignoriert ihn, weil die KI den Kontext nicht ausreichend kennt, um hilfreich zu sein, und das Klicken mehr Aufmerksamkeit kostet, als den Satz selbst zu schreiben. Der Button breitet sich wie Kletten auf der Produktoberfläche aus, und die Kennzahl, die das Team verfolgt (Button-Sichtbarkeit), steigt, während die wichtigste Kennzahl (Nutzerzufriedenheit) stagniert.

Die Lösung ähnelt der Lösung für die Chat-Seitenleiste, ist aber kleiner. Man wählt die zwei oder drei Textfelder aus, in denen die KI wirklich hilft (lange Texte, Extraktion strukturierter Daten, Zusammenfassung großer Dokumente) und bietet dort eine umfassende KI-basierte Benutzererfahrung. Der Glitzer-Button wird aus allen anderen Feldern entfernt. Das Produkt ist nun in den relevanten Bereichen KI-nativ, und alle unnötigen Elemente wurden entfernt.

Checkliste vor der Auslieferung für KI-native Produkte

Führen Sie diese Checkliste bei jedem Produkt durch, das behauptet, KI-nativ zu sein, und Sie erkennen nachträglich hinzugefügte Elemente, bevor sie einen echten Nutzer erreichen.

-

Löschtest: Entfernen Sie gedanklich alle Modellaufrufe aus dem Produkt. Was bleibt übrig? Wenn ein vollständiges, funktionsfähiges Produkt übrig bleibt, handelt es sich um nachträglich hinzugefügte KI. Wenn nur eine leere Hülle übrig bleibt, ist das Produkt KI-nativ.

-

Kaltstarttest: Öffnen Sie das Produkt ohne vorherige Anmeldung. Welche Oberfläche sieht der Nutzer als Erstes? Handelt es sich um ein Eingabefeld, eine Antwortoberfläche oder eine modellgesteuerte Hauptansicht, ist das Oberflächenprinzip erfüllt. Ist es die ursprüngliche Benutzeroberfläche mit einem Chat-Symbol in der Ecke, ist das Oberflächenprinzip nicht erfüllt.

-

Formular-zu-Eingabeaufforderung-Audit: Listen Sie alle Formularfelder im Produkt auf. Fragen Sie sich bei jedem Feld, ob eine Eingabeaufforderung die Funktion besser erfüllen würde. Ersetzen Sie die Felder, die den Test nicht bestehen.

-

Agentenverhalten. Zählen Sie die Bestätigungsdialoge zwischen der Absichtserklärung des Nutzers und der Aktion des Modells. Sind es mehr als ein Dialog, ist das Agentenprinzip zu vorsichtig. Fördern Sie mehr Aktionen mit der Option „Aktivieren und dann rückgängig machen“.

-

Transparenzprüfung. Fragen Sie sich bei jeder Modellausgabe: Ist für den Nutzer der Kontext des Modells, die ausgeführte Aktion und die Herkunft der Antwort ersichtlich? Fehlt eine dieser drei Informationen, ist die Transparenz unvollständig.

-

Darstellungsdisziplin. Betrachten Sie die primäre Oberfläche. Sind Modellname, Temperatur oder Systemaufforderung sichtbar? Wenn ja und die Zielgruppe nicht technisch versiert ist, blenden Sie diese Informationen aus. Wenn ja und die Zielgruppe technisch versiert ist, behalten Sie sie bei.

-

Reaktionszeit. Messen Sie die Zeit von der Absichtserklärung des Nutzers bis zur ersten Reaktion des Modells. Dauert es länger als zwei Sekunden ohne Feedback, ist die Reaktionszeitwahrnehmung gestört. Fügen Sie Streaming, Zwischenergebnisse oder Teilergebnisse hinzu, bis die Reaktionszeit flüssiger wirkt.

-

Überprüfung der Feedback-Symbole. Zählen Sie die Feedback-Symbole auf der Produktoberfläche. Sind es mehr als drei, handelt es sich meist um irrelevante Informationen. Konzentrieren Sie sich auf die zwei oder drei relevanten Bereiche, um tiefgreifende KI-basierte Nutzererlebnisse zu schaffen, und entfernen Sie die übrigen.

-

Onboarding-Test: Beobachten Sie einen Erstnutzer bei der Erledigung der Hauptaufgabe. Wurde das Nutzererlebnis vom Modell gesteuert oder hat der Nutzer die Aufgabe über die ursprüngliche Benutzeroberfläche abgeschlossen? Im letzteren Fall ist die KI nachträglich hinzugefügt, unabhängig von den Marketingaussagen.

-

Vertrauensverlust-Recovery: Zwingen Sie das Modell, eine falsche Antwort zu liefern. Wie reagiert das Produkt? Fehlt eine saubere Recovery-Funktion, ist der Vertrauenskreislauf unvollständig und das Produkt verliert Nutzer aufgrund des ersten Fehlers.

Ein Produkt, das diese zehn Tests besteht, ist wirklich KI-nativ. Es wird nicht perfekt sein, aber die Architektur stimmt, und die meisten anderen Probleme lassen sich von dort aus beheben. Ein Produkt, das die meisten Tests nicht besteht, ist KI-nachträglich hinzugefügt, egal wie prominent die KI-Funktionen im Launch-Post dargestellt werden.

FAQ

Was bedeutet KI-natives Produktdesign?

KI-natives Produktdesign bedeutet, dass das Modell die primäre Oberfläche bildet und die restliche Benutzeroberfläche dazu dient, das Modell nutzbar, nachvollziehbar und schnell zu machen. Der aussagekräftigste Test ist der Löschtest: Bleibt nach dem Entfernen aller Modellaufrufe ein voll funktionsfähiges Produkt übrig, handelt es sich um ein nachträglich hinzugefügtes KI-System. Bleibt nur eine leere Hülle übrig, ist das Produkt KI-nativ. Produkte wie Linear, Cursor, Granola, Perplexity und Arc Search bestehen diesen Test mit ihren Kernfunktionen. Die meisten Enterprise-SaaS-Lösungen, die 2024 eine Chat-Seitenleiste eingeführt haben, fallen daran durch.

Worin unterscheidet sich KI-nativ von KI-nachträglich hinzugefügt?

KI-native Produkte bauen den primären Workflow um das Modell herum neu auf. Produkte mit nachträglich hinzugefügtem KI-System behalten den bestehenden Workflow bei und fügen ein KI-Panel an der Seite hinzu. Der Unterschied zeigt sich darin, wo der Nutzer beim Kaltstart landet, ob die Eingabe per Eingabeaufforderung oder Formular erfolgt, ob das Produkt aktiv wird oder fragt und ob das Modell ignoriert werden kann, ohne die Hauptfunktionalität zu beeinträchtigen. KI-integrierte Produkte können ignoriert werden. KI-native Produkte nicht.

Was sind die Prinzipien des KI-zentrierten Produktdesigns?

Sechs Prinzipien unterscheiden KI-native von KI-integrierten Produkten. Das Modell dient als zentrale Oberfläche, nicht als Seitenleiste. Eingabeaufforderungen werden als Eingabe verwendet, nicht Formulare. Handlungsfähigkeit ist standardmäßig gegeben, nicht standardmäßige Berechtigungen. Transparente Oberflächen machen das Modell nachvollziehbar. Modelldetails werden standardmäßig ausgeblendet und erst bei Bedarf angezeigt. Latenz ist eine wichtige Designbedingung bei Streaming, Skelettzuständen und Teilergebnissen. Jedes KI-native Produkt, das es wert ist, untersucht zu werden, verwendet eine Kombination dieser sechs Prinzipien.

Was ist das beste Beispiel für ein KI-natives Produkt?

Cursor ist das bisher beste Beispiel für KI-natives Produktdesign im Bereich Entwicklertools. Perplexity ist das beste Beispiel für die Nutzersuche. Linear ist das beste Beispiel für eine integrierte KI-Anwendung innerhalb einer bestehenden Produktivitätsoberfläche. Granola ist das beste Beispiel für ein KI-basiertes Produkt, bei dem das Modell im Hintergrund läuft. Arc Search ist das beste Beispiel für eine KI-basierte Browserinteraktion. Jedes dieser Produkte hat seinen primären Workflow um das Modell herum neu aufgebaut, anstatt KI einfach in eine bestehende Benutzeroberfläche zu integrieren.

Wie gestaltet man eine KI-basierte UX für ein KI-basiertes Produkt?

Beginnen Sie mit einem Löschtest auf jedem Bildschirm. Ersetzen Sie Formulare durch Eingabeaufforderungen, bei denen das Modell die Strukturierung besser übernehmen kann als der Nutzer. Legen Sie die Standardeinstellung der KI auf „Aktivieren und dann rückgängig machen“ fest, nicht auf „Fragen und dann handeln“, und stellen Sie die Rückgängig-Funktion zusammen mit der Aktion bereit. Fügen Sie für jede Modellausgabe eine transparente Oberfläche hinzu. Blenden Sie Modelldetails für den Nutzer aus. Gestalten Sie jede Interaktion mit realer Modelllatenz, nicht mit simulierter Latenz, und verwenden Sie Streaming- oder Skeleton-Zustände, sobald das erste Token länger als einen Moment benötigt. Dasselbe gilt für den umfassenderen Trend von Webdesign-Trends 2026 hin zu Layouts, die sich dem Modell anpassen, anstatt es zu umschließen.

Der Wandel, den KI-native Produkte tatsächlich ermöglichen

Ein KI-natives Produkt ist keine SaaS-Anwendung mit einem Chatfenster in der Ecke, sondern eine neue Produktform, bei der das Modell das primäre Medium und die Benutzeroberfläche die Membran ist.

Die Marken, die KI-native Lösungen anbieten (Linear auf ihren neueren Oberflächen, Cursor überall, Granola in ihrer Erweiterungsschicht, Perplexity durchgängig, Arc Suche als gesamtes Interaktionsmodell), haben dies verinnerlicht. Sie haben KI nicht einfach einem Produkt hinzugefügt, sondern ein Produkt um KI herum entwickelt. Die architektonische Entscheidung liegt jeder Designentscheidung zugrunde und prägt alles – vom Eingabemodell über die Latenz bis hin zur Wiederherstellungsoberfläche. Produkte, die versuchen, KI nachträglich in eine bestehende Oberfläche zu integrieren, enden mit einer Chat-Seitenleiste, die niemand öffnet, und einem Glitzerbutton, den niemand anklickt – egal wie sehr die Marketingseite auch betont, dass sie KI-zentriert sind.

Die Chance für Designteams im Jahr 2026 besteht darin, den Löschtest für jedes Produkt, das sie veröffentlichen, ernst zu nehmen. Übersteht das Produkt den Test, liefert das Team eine Funktion, kein fertiges Produkt. Scheitert das Produkt am Test (im positiven Sinne, indem es ohne das Modell zu einer leeren Hülle wird), hat das Team die Chance, etwas wirklich KI-natives zu entwickeln. Die oben genannten Prinzipien bilden das Arbeitsgerüst für den Erfolg. Dasselbe Gerüst liegt der umfassenderen Disziplin visuelle Hierarchie zugrunde, in der das Modell nun die größte visuelle Priorität auf der Seite einnimmt, anstatt die ursprüngliche Benutzeroberfläche zu umgeben.

Der tiefere Wandel besteht darin, dass sich das mentale Modell des Nutzers von Software verändert. Sie erwarten nicht mehr, ein Tool erlernen zu müssen, sondern eine Absicht auszudrücken und eine entsprechende Reaktion zu erhalten. Produkte, die auf dem alten Denkmodell basieren (Formulare, Dashboards, mehrstufige Assistenten), werden sich innerhalb von zwei Jahren langsam, umständlich und veraltet anfühlen. Produkte, die dem neuen Denkmodell folgen (Abfrage, Antwort, Aktion, Rückgängigmachen), werden sich zeitgemäß anfühlen. Die Teams, die den Wandel als Erste vollziehen, werden definieren, was KI-nativ in ihrer Kategorie bedeutet, und die Teams, die lediglich eine Chat-Seitenleiste an eine bestehende Oberfläche anfügen, werden den Rest des Jahrzehnts damit verbringen, zu erklären, warum ihre KI-Nutzungsrate so niedrig ist.

Wenn Ihr Team eine KI-Funktion oder ein KI-Produkt entwickelt oder sich fragt, welches Produkt Sie eigentlich auf den Markt bringen, sind die Prinzipien auf dieser Seite Ihre Bedienungsanleitung. Wenn Sie Unterstützung bei der Anwendung auf Ihr spezifisches Produkt benötigen, klicken Sie auf Brainy einstellen. UXBrainy bietet KI-zentrierte Produktstrategien und umfassende Design-Audits anhand dieses Frameworks. AppBrainy bietet KI-native Produkt-UIs für Teams, die Tools entwickeln, die ihre Nutzer auch tatsächlich verwenden sollen. ClaudeBrainy veröffentlicht Claude Fähigkeiten und eine Prompt-Bibliothek für Teams, die KI-Funktionen wie bei Cursor und nicht wie in einer Chat-Sidebar von 2024 benötigen. Das Framework auf dieser Seite setzen wir in jedem Projekt und auf jedem Bildschirm ein, bevor überhaupt etwas veröffentlicht wird.

Want a product where the AI is the surface, not a sparkle icon parked in the corner? Brainy ships UXBrainy for AI-first product strategy, AppBrainy for full AI-native product UI, and ClaudeBrainy as a Skill pack for teams who want AI features built like Cursor and not like a 2024 chat sidebar.

Get Started