Screenshot-basiertes Design: Der neue Referenz-Workflow

Designer nutzen Pinterest nicht mehr. Sie erstellen einen Screenshot, fügen ihn in KI ein und entwerfen anhand realer Vorlagen. Das komplette Handbuch für screenshotbasiertes Design.

Designer nutzen Pinterest seit einem Jahr nicht mehr. Stattdessen erstellen sie Screenshots und fügen diese in KI-Systeme ein. Dieser einfache Schritt – Screenshot zu Modell – ist der neue Standard im Produktdesign.

Kaum jemand hat diesem Prozess einen Namen gegeben. Dieses Paper tut es: Screenshot-basiertes Design. Dieser Workflow wird 2026 bereits in jedem agilen Produktteam Standard sein.

Er hat still und leise Moodboards, Wireframes und fast alles, was früher auf der Referenzseite eines Designers zu finden war, ersetzt. Der Screenshot ist heute die universelle Sprache zwischen Mensch und Modell. Wir erklären Ihnen, was Screenshot-basiertes Design ist, warum es so gut funktioniert, welche Tools und Methoden es gibt und wie Sie es direkt im Workshop umsetzen können.

Was ist Screenshot-basiertes Design eigentlich?

Screenshot-basiertes Design bedeutet, jede Designaufgabe mit einem Screenshot eines realen Produkts zu beginnen – nicht mit einem Wireframe oder einem Moodboard. Sie erstellen einen Screenshot von einem funktionierenden Produkt und geben diesen in ein KI-Tool ein. Sie lassen das Modell die Muster benennen, die Token extrahieren und einen ersten Entwurf erstellen, den Sie weiter verfeinern.

Der Screenshot ist Spezifikation, Briefing und Aufgabenstellung in einem. Die Arbeitsweise hat sich verändert. Der alte Ablauf war: Skizze, Wireframe, Hi-Fi-Modell, Prototyp, Übergabe. Der neue Ablauf ist: Aufnahme, Bildunterschrift, Aufgabenstellung, Iteration, Auslieferung.

Fünf Schritte, vier davon schneller als früher. Der erste Schritt findet im Browser beim Scrollen statt. Das ist alles ganz einfach. Öffnen Sie die Website eines aktiven Designteams (Slack) und Sie werden sehen, wie Screenshots so schnell herumfliegen wie früher Pinterest-Pins.

Der Grund dafür ist die Geschwindigkeit der Intention. Ein Wireframe vermittelt die Intention mit geringer Detailgenauigkeit und in langsamer Geschwindigkeit. Ein Moodboard vermittelt Stimmung, aber keine Struktur. Ein Screenshot vermittelt Intention, Struktur, Ton, Hierarchie, Abstände, Farben und Bewegung mit nur einem Klick durch die Auswahl eines Pixelbereichs.

Jedes weitere Artefakt im Designprozess ist eine verlustbehaftete Komprimierung dessen, was ein Screenshot bereits zeigt.

Warum es jetzt funktioniert und nicht erst 2023

Zwei Dinge mussten sich entwickeln, bevor dieser Workflow möglich war. Die KI-Bilderkennung musste so gut werden, dass sie einen echten Produkt-Screenshot analysieren und wie ein Designer interpretieren konnte. Und die gängigen Aufnahmewerkzeuge mussten das Erstellen eines sauberen Referenzbildes so günstig machen, dass man es automatisch tut. Beides ist in den letzten zwanzig Monaten geschehen.

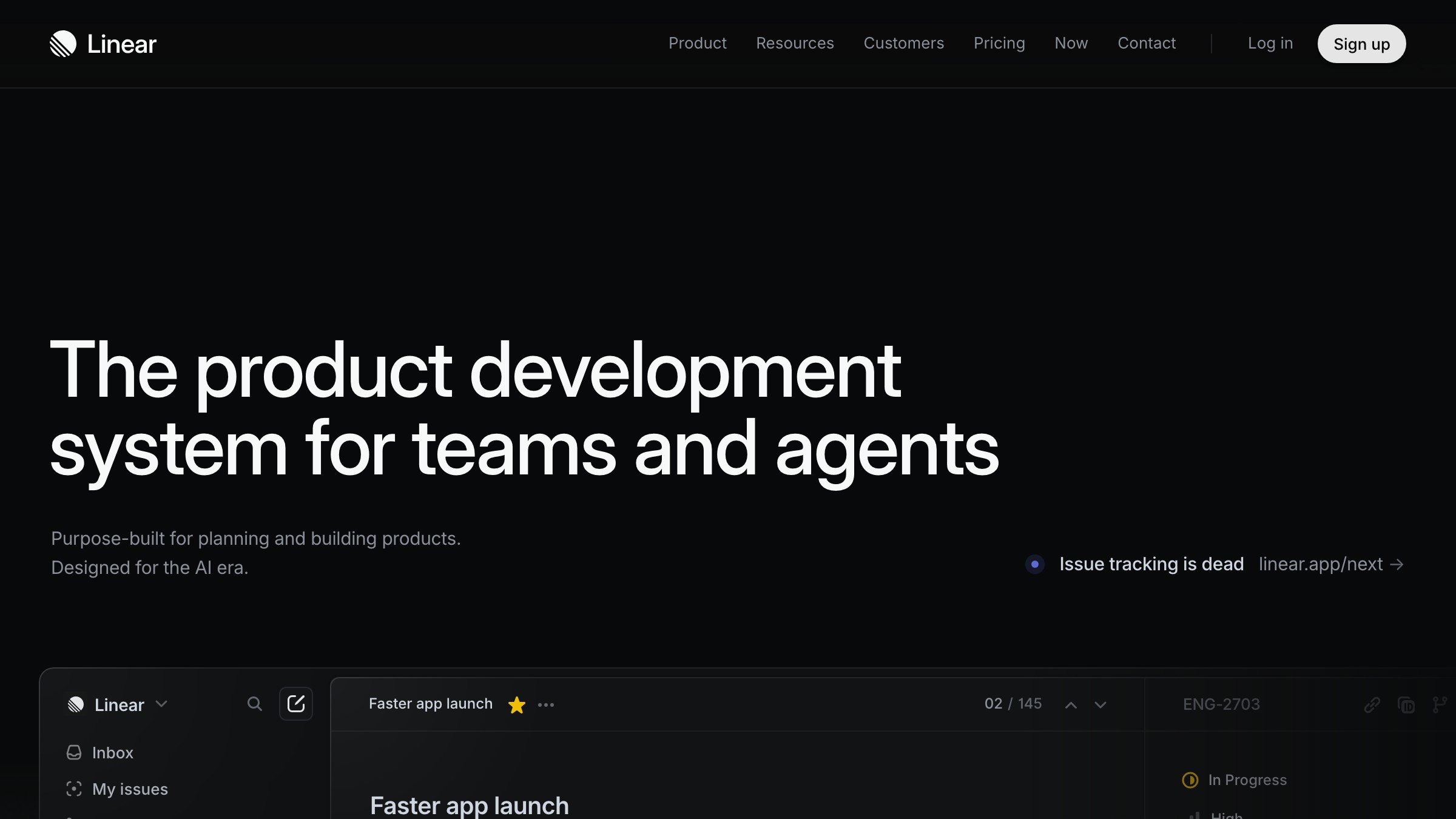

Die Visionen von Claude, GPT und Gemini haben 2025 alle denselben Punkt erreicht: Sie beschreiben nicht mehr nur, was auf einem Bild zu sehen ist, sondern analysieren, warum es dort zu sehen ist. Ein Modell, das die Marketingseite von Linear analysieren und Ihnen mitteilen kann, dass der Hero-Bereich eine einheitliche, dicke Schriftstärke für die H1-Überschrift, eine entsättigte Markenfarbe, eine Sub-Grid-Ausrichtung für die sekundäre Illustration und eine spezifische Bewegungsverzögerung für den Begleittext verwendet, ist ein Modell, das als Design-Kollaborator fungieren kann. Kein einfacher Alt-Text-Generator.

Die Erfassungsseite schloss den Kreis. CleanShot X machte Screenshots zu einem erstklassigen Asset mit integrierten Funktionen für Anmerkungen, Teilen und OCR. Raycast fügte eine systemweite Erfassungsoberfläche hinzu, die nur einen Tastendruck von jeder beliebigen Aktion entfernt ist.

Arc machte das gesamte Web zu einer einzigen Screenshot-Plattform. Und Playwright, das Headless-Browser-Tool, das Entwickler zum Testen von Webanwendungen verwenden, wurde still und leise zum Schlüssel, mit dem Designer jede beliebige Webseite in jeder Größe automatisch, wiederholbar und nach Bedarf erfassen können. Zusammen machten diese Tools die Referenzrecherche von einer lästigen Pflicht zu einem Reflex.

Fünf Vorteile von Screenshots gegenüber Moodboards

Ein Moodboard ist ein Stimmungsdokument. Ein Screenshot ist eine Arbeitsspezifikation. Der Unterschied zwischen diesen beiden ist der Hauptgrund, warum man seine Recherchemethoden überdenken sollte, und er zeigt sich in fünf konkreten Punkten.

-

Struktur. Ein Moodboard verbirgt Hierarchien hinter ästhetischen Aspekten. Ein Screenshot legt sie offen.

-

Detailgenauigkeit. Ein Moodboard ist zu 60 % detailliert. Ein Screenshot liefert die volle Detailgenauigkeit.

-

Präzision. Ein Moodboard vermittelt Gemütlichkeit. Ein Screenshot zeigt die Linienhöhe von 14 Pixeln auf einem 16 Pixel großen Körper in Inter bei 450 ct.

-

Schnelligkeit. Ein Moodboard ist eine Sammlung von Inspirationen, die ein Model nicht analysieren kann. Ein Screenshot ist ein einzelnes Bild, das ein Model in Sekundenschnelle auswerten kann.

-

Iterationsgeschwindigkeit. Ein Moodboard benötigt einen Tag. Eine Screenshot-Sammlung ist in 30 Sekunden erstellt und befindet sich in der Zwischenablage.

Der letzte Punkt ist für Teams besonders wichtig. Die Iterationsgeschwindigkeit steigert sich. Ein Team, das innerhalb von fünf Minuten erfassen, beschriften und erneut Anweisungen geben kann, wird ein Team, das zweimal wöchentlich Moodboard-Reviews durchführt, designtechnisch übertreffen.

Das gilt selbst dann, wenn das Moodboard-Team einen besseren individuellen Geschmack hat. Die Anzahl der Iterationen ist bei jedem Designproblem wichtiger als die Qualität der Ergebnisse.

Der Capture-Stack, den jeder Designer 2026 verwenden wird

Die Erfassungsseite des Workflows ist der langweilige Teil. Hier machen die meisten Teams Fehler, weil sie Screenshots wie Standard-Screenshots behandeln und weitermachen. Standard-Screenshots sind für den gelegentlichen Gebrauch ausreichend. Der screenshotbasierte Workflow benötigt jedoch einen Capture-Stack, der schneller, sauberer, besser annotierbar und wiederholbarer ist als der, der im Betriebssystem enthalten ist.

CleanShot X ist der macOS-Standard. Es bietet Scroll-Screenshots, Bereichs-Screenshots mit Ausrichtung an Elementen, Video, OCR und eine Zwischenablage-Historie, die eine Designbibliothek im Verborgenen darstellt. Raycast Window Capture ergänzt CleanShot X für Ganzfenster-Screenshots, die die aktive Anwendung berücksichtigen.

Die „Fragen an die Seite“-Funktion von BRAND22 ermöglicht es, Fragen an beliebige Tabs zu stellen und die Antwort direkt im selben Fenster als Screenshot festzuhalten. ShareX bietet unter Windows dieselbe Funktion. Shottr ist die schlanke CleanShot-Alternative für Designer, die weniger Software und mehr Tastaturarbeit bevorzugen.

Dann gibt es noch die oft unterschätzte Kategorie: Tools, die das Web selbst in ein Aufnahmeobjekt verwandeln. Screenshot.rocks rendert jede URL in jeder Bildschirmgröße mit einem Rahmen. Browserless und ScreenshotOne erledigen dieselbe Aufgabe mit API-Unterstützung. Mit Google Lens lassen sich Screenshots der realen Welt erstellen und Designreferenzen aus der physischen Umgebung extrahieren.

Der Capture-Stack besteht nicht aus einem einzigen Tool. Es ist ein kleines Set von Tools, von denen jedes für einen bestimmten Teilbereich des Capture-Problems optimal geeignet ist und durch die Gewohnheit des Designers, der sie installiert hat, miteinander verbunden wird.

Playwright ist jetzt ein Designer-Tool

Das am meisten unterschätzte Capture-Tool im Designbereich im Jahr 2026 ist Playwright – und es ist kein Design-Tool. Es ist die Testbibliothek, die Entwickler zur Browserautomatisierung verwenden. Warum Playwright in den Stack eines Designers gehört, ist einfach.

Mit nur sechs Codezeilen öffnet Playwright jede beliebige Website, stellt den Viewport ein, wartet, bis die Netzwerkverbindung stabil ist, scrollt zu einer beliebigen Position und speichert einen pixelgenauen Screenshot. Das wiederholt sich nächste Woche, sodass Sie die Designentwicklung verfolgen können.

Die Anwendungsfälle liegen auf der Hand: Erstellen Sie eine Liste mit Wettbewerbern und lassen Sie Playwright jeden Montag die Startseiten von 40 Konkurrenten erfassen. Erstellen Sie eine Pattern Library, indem Sie dieselbe Komponente – Preistabelle, leeren Zustand, Onboarding-Modal – für 30 Produkte erfassen und alle 30 in einen einzigen Figma-Frame einfügen.

Erfassen Sie Marketingseiten in 1200x675 für Share-Bilder, in 375x812 für Mobilgeräte und in 1920x1080 für Design-Reviews – alles mit demselben Skript.

Designer, die innerhalb eines Nachmittags gelernt haben, ein Playwright-Skript zu schreiben, berichten alle dasselbe. Die Referenzrecherche, die früher drei Stunden Klicken und Ausschneiden in Anspruch nahm, dauert jetzt nur noch dreißig Sekunden mit einem Skript. Das ist keine Produktivitätssteigerung, sondern eine völlig andere Aufgabe.

Der Vision Stack, der Screenshots analysiert

Ein Screenshot ist nur so nützlich wie das Modell, das ihn interpretieren kann. Der Vision Stack ist die zweite Hälfte des screenshotbasierten Designs, und die hier verwendeten Modelle sind nicht austauschbar. Verschiedene Modelle haben unterschiedliche Stärken, und ein erfahrener Designer lernt, welches Modell für welchen Screenshot-Typ geeignet ist.

Die Bildeingabe von Cursor ist der einfachste Weg, Design in Code umzusetzen. Ziehen Sie einen Screenshot in den Chat, bitten Sie Cursor, ihn als React-Komponente oder Tailwind-Layout neu zu erstellen, und beobachten Sie, wie Code generiert wird, der die Struktur der Referenz berücksichtigt.

Die Vision von Claude ist am stärksten in der Analyse von Typografie, Abständen und Hierarchie. Fügen Sie einen Screenshot ein und bitten Sie Claude, das zugrunde liegende Designsystem zu beschreiben. Die Antwort ist oft nützlicher als ein echtes Audit, da Claude keinen Anreiz hat, die Lücken höflich zu beschönigen.

V0 ist das Arbeitspferd für die Bild-zu-Code-Konvertierung der Teams von shadcn und Next.js. Screenshot einfügen, funktionierende Komponente erhalten, auf derselben Oberfläche iterieren. ChatGPTs Vision ist die des Generalisten.

Geminis Vision punktet mit langen Kontexten und ist nützlich, wenn man zwölf Screenshots von zwölf Wettbewerbern einfügen und nach Mustern suchen möchte. Google Lens ist das einzige Bildverarbeitungstool, das die physische Welt sauber erfasst und daher nützlich für Designer ist, die Referenzen aus Printmedien, Architektur und Produktfotografie nutzen.

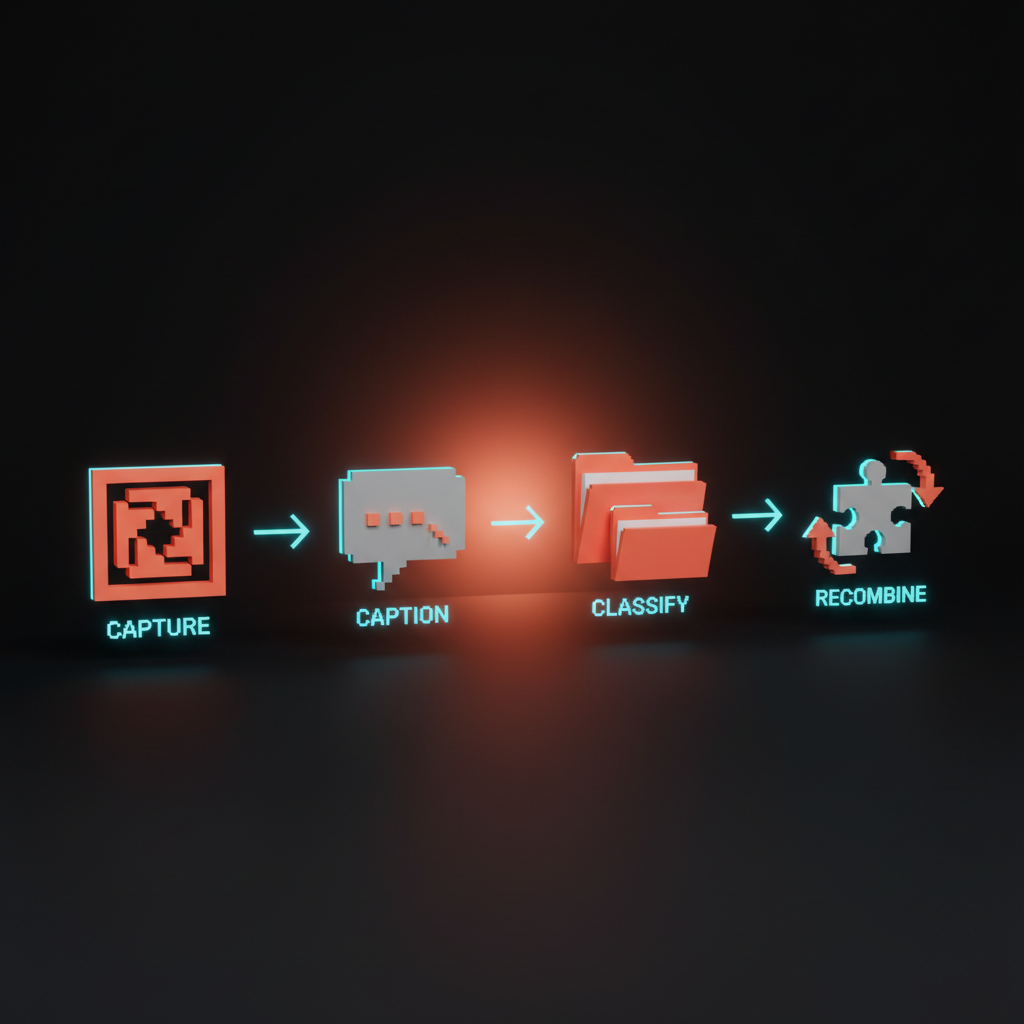

Die Vier-Schritte-Methode

Erfassen, beschriften, klassifizieren, neu kombinieren. Vier Schritte, immer in dieser Reihenfolge. Die Methode ist obligatorisch.

Teams, die den Schritt der Beschriftung auslassen, erhalten eine Screenshot-Bibliothek, die sie nicht durchsuchen können. Teams, die die Klassifizierung auslassen, erstellen eine Bibliothek, der sie nicht vertrauen können. Teams, die die Rekombination auslassen, kopieren am Ende, anstatt zu gestalten. Jeder Schritt hat seinen Sinn und trägt zum Gesamtergebnis bei.

Das Aufnehmen ist der eher langweilige Teil. Verwenden Sie immer dasselbe Werkzeug, dieselbe Namenskonvention, denselben Ansichtsbereich und dieselben Zuschneideregeln, damit sowohl Sie als auch zukünftige KI die Bibliothek nachvollziehen können.

Die Bildunterschrift ist der Punkt, an dem die meisten Designer den entscheidenden Unterschied machen. Jeder Screenshot erhält einen von Ihnen verfassten Satz Text, nicht vom Modell, der beschreibt, was Sie speichern und warum. Das „Warum“ macht die Bibliothek durchsuchbar.

Die Klassifizierung bedeutet, jeden Screenshot einer kleinen Anzahl von Kategorien zuzuordnen, die Ihrer tatsächlichen Designweise entsprechen. Layout, Typografie, Farbe, Bewegung, leerer Zustand, Hero-Bereich, Preisgestaltung, Fußzeile, Onboarding. Wählen Sie fünfzehn Kategorien aus und bleiben Sie dabei.

Die Rekombination ist der einzige Schritt, der Ergebnisse liefert. Sie wählen drei bis fünf Screenshots aus der Bibliothek aus, fügen sie in ein KI-Tool ein und lassen das Modell daraus etwas Neues generieren. Die Synthese gehört Ihnen, die Referenz dem Tool.

Wie man einen Screenshot in einer Spezifikation verwendet

Der größte Vorteil von screenshotbasiertem Design liegt in der Verwendung von Screenshots direkt in der Spezifikation. Eine herkömmliche Spezifikation ist eine Seite mit Text, Links und eventuell einem eingebetteten Element.

Eine screenshotbasierte Spezifikation ist eine Seite, auf der jeder Abschnitt mit dem Referenz-Screenshot beginnt, die von Ihnen verfasste Bildunterschrift enthält und mit der KI-generierten Musteranalyse endet. Der Screenshot übernimmt die Funktion, die früher der Text hatte.

Die Vorlage ist kurz. Fügen Sie für jede Komponente oder jeden Bildschirm, den die Spezifikation abdeckt, den Inspirations-Screenshot, die KI-Analyse der Inspiration, die Constraint-Liste, die Variationsregeln und den Link zum erfassten Playwright-Skript hinzu, das den Screenshot im nächsten Monat aktualisiert.

Die Constraint-Liste ist das Einzige, was der Designer in seiner eigenen Sprache verfasst. Alles andere sind Referenzdaten plus Modellausgabe, übersichtlich organisiert. Der Vorteil zeigt sich bei der Übergabe. Entwickler müssen nicht mehr raten, was die Spezifikation bedeutet.

Sie klicken auf den Screenshot, sehen den Quellcode, lesen die Aufschlüsselung und liefern Code, der der Intention entspricht, da diese sichtbar ist. Der Screenshot vermittelt den Ton. Der Screenshot ist die Spezifikation. Die Spezifikation ist die Build-Reihenfolge.

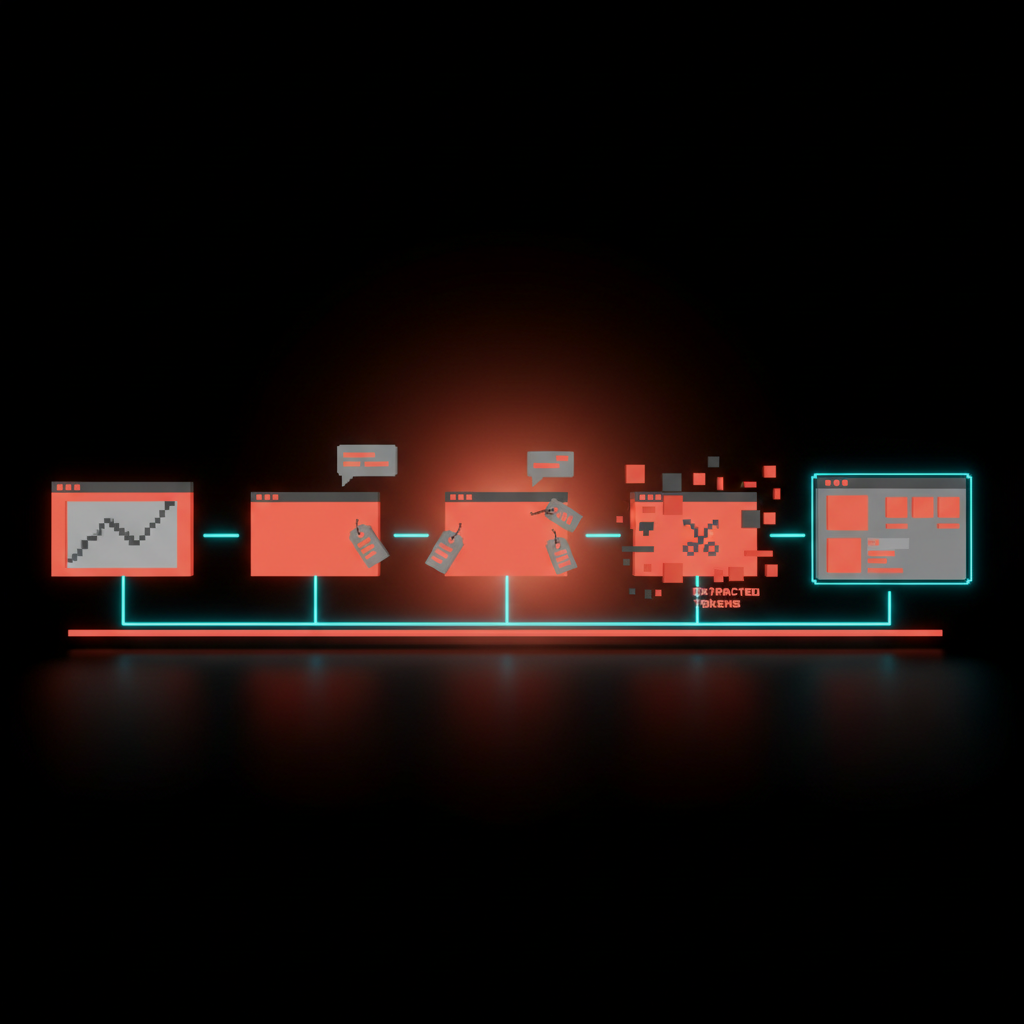

Wie man Design-Tokens aus einem Screenshot extrahiert

Design-Tokens stammten früher aus einer Figma-Bibliothek und einem ausführlichen Gespräch zwischen Design und Entwicklung. Im Jahr 2026 ist der schnellste Weg zu einem funktionierenden Token-Set, einen Screenshot in ein KI-Tool einzufügen und es abzufragen.

Das Modell liefert Ihnen die Farbwerte, den Abstandsmaßstab, die Typografie-Rampe, die Radien und die Schattenstapelung – und das zu 90 % direkt. Die restlichen 10 % sind Geschmackssache.

Die Eingabeaufforderung ist der Schlüssel zum Erfolg. Sie fordern das Modell nicht auf, Tokens zu extrahieren. Stattdessen lässt es den Screenshot analysieren und ein JSON-Objekt mit benannten Token-Kategorien, sinnvollen Standardwerten und einem Konfidenzwert pro Kategorie sowie einer kurzen Begründung für jeden Wert erstellen.

Diese Struktur zwingt das Modell zur Präzision. Der Konfidenzwert ermöglicht es Ihnen, die Tokens zu priorisieren, die einer genaueren Betrachtung bedürfen. Die Begründung erlaubt es Ihnen, das Modell bei Fehlern zu korrigieren.

Die Ausgabe wird direkt an die Design-Tools weitergeleitet, die Tokens verarbeiten: Style Dictionary, Figma Tokens und Tailwind-Konfiguration. Dasselbe JSON-Objekt kann alle drei steuern. Ein screenshotbasiertes Designteam kann so innerhalb von 15 Minuten aus einem einzelnen Referenz-Screenshot einen funktionierenden Token-Export erstellen.

So organisieren Sie Ihre persönliche Screenshot-Bibliothek

Eine Screenshot-Bibliothek ist ein wertvolles Gut, und wie jedes wertvolle Gut ist sie wertlos, wenn sie nicht organisiert ist. Beide Arten des Scheiterns sind gleichermaßen problematisch: Ein unstrukturierter Ordner mit 3000 unbenannten PNGs ist ein unübersichtliches Durcheinander.

Eine tief verschachtelte Taxonomie mit 60 Kategorien ist ein Labyrinth. Die richtige Struktur ist flach, benannt und mit einer Bildunterschrift versehen. Außerdem befindet sie sich an einem Ort, der von überall aus durchsuchbar ist.

Die für die meisten Designer bewährte Bibliothek besteht aus drei Ebenen. Die oberste Ebene ist ein einzelner Ordner pro Quellprodukt, benannt nach dem jeweiligen Produkt. In jedem Produktordner sind die Screenshots nach einem Muster benannt, das Datum, Seite und Komponente enthält.

Jeder Screenshot hat eine separate Bildunterschrift im selben Ordner. Diese wird als einfache Textdatei gespeichert und enthält einen Satz, der erklärt, warum der Screenshot gespeichert wurde. Drei Ebenen. Zwei Dateien pro Screenshot. Nicht mehr.

Die Speicherung ist der einfache Teil. iCloud Drive, Dropbox, Notion oder ein lokaler Ordner, der mit einem Cloud-Dienst synchronisiert wird, funktionieren alle. Die Herausforderung besteht darin, die Bibliothek für Ihre KI-Tools auffindbar zu machen. Das bedeutet, sie an einem Ort zu platzieren, auf den Ihr Editor zugreifen kann.

Der Cursor kann einen lokalen Ordner lesen. Claude kann auf ein Drive zeigen. Die Bibliothek ist nur so gut wie die Fähigkeit des Modells, sie bei Bedarf zu lesen. Diese Einrichtungsentscheidung sollte frühzeitig getroffen werden.

Lernen statt stehlen

Die größte Herausforderung beim screenshotbasierten Design ist die Gratwanderung zwischen dem Studium einer Referenz und dem Kopieren. Der Workflow macht beides erschreckend einfach, und genau dieser Unterschied unterscheidet einen Designer von einem Content-Dieb.

Diese Grenze ist nicht rechtlich, sondern eine Frage des Handwerks. Und genau dieses Handwerk unterscheidet ein Team, das ein eigenes Produkt entwickelt, von einem, das das Produkt eines anderen mit veränderten Farben weitergibt.

Die Regel ist einfach: Ein Screenshot ist Studienmaterial, keine Quelle. Sie können jedes öffentliche Produkt erfassen, beschriften, kategorisieren und referenzieren. Sie dürfen den Screenshot jedoch nicht in Version 0 einfügen, das Ergebnis unverändert übernehmen und es als Ihr eigenes veröffentlichen.

Der Syntheseschritt in der Methodik dient speziell dazu, sicherzustellen, dass Sie Muster und nicht Pixel extrahieren. Wenn Ihre Arbeit mit der Referenz verwechselt werden könnte, haben Sie die Rekombination übersprungen.

Auch die rechtlichen Rahmenbedingungen spielen eine Rolle. Markenrechte, urheberrechtlich geschützte Illustrationen, Markenzeichen und Layouts sind aus gutem Grund geschützt. Sie zu kopieren ist Diebstahl, egal wie einfach es KI auch machen mag.

Die gute Nachricht: Die Methode – Erfassen, Beschriften, Klassifizieren, Wiederzusammenfügen – macht Urheberrechtsverletzungen von vornherein nahezu unmöglich. Bei korrekter Anwendung des Workflows befindet sich das Original in Ihrer Bibliothek und Ihre Ausgabe in Ihrem Produkt. Die Trennung zwischen beiden ist so groß, dass Verwechslungen ausgeschlossen sind.

Der Workshop, den Sie noch heute durchführen können

Der schnellste Weg, screenshotbasiertes Design in einem Team zu etablieren, ist ein 90-minütiger Workshop, in dem die Teilnehmer den gesamten Prozess anhand eines realen Produkts durchlaufen. Wählen Sie eine Funktion, die Ihr Team nächsten Monat veröffentlicht. Planen Sie diese Woche einen Termin ein.

Bringen Sie die Laptops, die Aufnahmetools und eine KI-Oberfläche mit, auf die alle Zugriff haben. Führen Sie die Teilnehmer die folgenden Schritte nacheinander durch:

-

Sammeln Sie 15 Minuten lang Referenzmaterial. Jeder Teilnehmer erstellt fünf Screenshots von Produkten, die ein ähnliches Problem wie die Funktion lösen.

-

Beschriften Sie die Screenshots 10 Minuten lang. Jede Person schreibt pro Screenshot einen Satz, der das Muster beschreibt.

-

Zwanzig Minuten Einarbeitung. Jede Person fügt ihre fünf Screenshots in die KI-Oberfläche ein und bittet um ein Synthese-Briefing.

-

Zwanzig Minuten Designphase. Jede Person erstellt anhand des Synthese-Briefings einen ersten Entwurf des Features.

-

Fünfzehn Minuten Überprüfung. Die ersten Entwürfe werden im Raum miteinander verglichen.

-

Zehn Minuten Dokumentation. Das Team notiert die Regeln, die es für seinen eigenen Workflow entwickelt hat.

Das Ergebnis sind zwei Dinge: Ein funktionsfähiger erster Entwurf des Features, der an sich schon nützlich ist, und ein schriftlicher Hausstil für screenshotbasiertes Design, den das Team für jedes zukünftige Projekt verwenden kann. Der Workshop ist keine einmalige Übung. Er ist der Einstieg in eine neue Arbeitsweise.

| Workflow | Geschwindigkeit | Genauigkeit | KI-gesteuert | Ideal für |

|---|---|---|---|---|

| Moodboard-basiert | Langsam | Niedrig | Mangelhaft | Markenstrategie, frühe Ideenfindung |

Wireframe-basiert | Mittel | Mittel | Mittel | Struktur, Ablauf, Barrierefreiheit |

Screenshot-basiert | Schnell | Hoch | Exzellent | Produktdesign, KI-gestützte Teams |

Wohin die Reise geht

Screenshot-basiertes Design ist kein Endzustand, sondern ein Übergang. Das Ziel ist eine Welt, in der der Screenshot selbst verschwindet und die Referenz zu einer dynamischen, abfragbaren Darstellung jedes Produkts im Internet wird. Diese steht den KI-Tools von Designern zur Verfügung, ähnlich wie die Bibliotheken von Figma heute.

Playwright zeigt uns bereits die Form dieses Ziels. Die generierten Screenshots sind keine Momentaufnahmen. Sie sind der erste Frame eines Feeds, den jedes Produktteam abonnieren kann.

In den nächsten zwölf Monaten wird sich die Screenshot-Bibliothek von Ordnern zu Vektordatenbanken, von manuellen Bildunterschriften zu automatisierten Tags und von Drag & Drop in KI-Tools zu nativen Abfragen innerhalb der Designoberfläche entwickeln. Die Designer, die dieser Entwicklung einen Schritt voraus sind, sind diejenigen, die sich jetzt die nötigen Fähigkeiten aneignen – mit einem umfassenden Screenshot-System, einer Bibliothek mit Bildunterschriften und den vorgegebenen Mustern, die aus einem Bild eine Designentscheidung machen.

Die Methodik wird die Werkzeuge überdauern. Der größte Wandel liegt jedoch in der Veränderung des Geschmacks. Wenn jeder Designer innerhalb von Sekunden auf jede verfügbare Referenz zugreifen kann, ist der entscheidende Faktor nicht mehr der Zugriff, sondern das Urteilsvermögen.

Zu wissen, welche Screenshots man speichert. Zu wissen, welche Muster man kombiniert. Zu erkennen, wann das Modell mit einem Muster falsch liegt und man selbst richtig. Der Screenshot ist das neue Skizzenbuch, und die Entscheidung liegt weiterhin bei einem selbst.

Want help installing a screenshot-driven design system inside your team, with the capture stack, the prompt library, and the spec templates wired in? Brainy ships the workflow as a sprint, not a slide deck.

Get Started